Foundry Local GA Oldu: Bulut Olmadan Yerel AI

Şunu açık söyleyeyim: Ben uzun süre “her şey bulutta olsun” tarafındaydım. Azure üstüne kurduğum kariyer, sertifikalar, müşteri işleri — hepsi bulut ekseninde döndü. Ama son bir yılda tablo biraz kaydı. Müşterilerden gelen isteklerin neredeyse yarısı artık “bunu buluta çıkmadan yapabilir mıyız?” diye başlıyor. Sağlık var, finans var, savunma var… Veri dışarı gitmesin istiyorlar. Gecikme olmasın diyorlar. Token maliyeti de can sıkıyor, açık konuşayım. İşte tam burada Microsoft’un Foundry Local’i GA (General Availability) olarak duyurması beni şaşırtmadı; sadece zamanlaması baya yerindeydi.

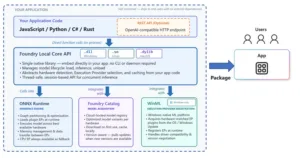

Size bir şey söyleyeyim, Foundry Local ne mi? Microsoft’un yerelde çalışan AI çözümü bu. Buluta bağımlılık yok denecek kadar az, hatta pratikte sıfır diyebilirim. Windows’ta çalışıyor, macOS’ta çalışıyor, Linux’ta da çalışıyor; Android tarafını da atlamamışlar. Chat var, ses tanıma var, yanı işin günlük kullanım tarafını boş geçmemişler. En hoşuma giden kısmıysa şu: Uygulama yükleyicisinin içine gömülebilecek kadar küçük olması. Küçük dedim ama yanlış anlaşılmasın, bazen küçük paketler işi daha rahat çözüyor.

Neden Yerel AI? Bulut Yetmiyor mu?

Bakın, bulut iyi hoş. Ben de Azure tarafını yıllardır savunurum, yanı öyle “bulut bitti” diyecek biri değilim. Ama işin aslı şu: her senaryoda bulut kullanmak biraz zorlamaya kaçıyor. Geçen ay İstanbul’da küçük bir ekip olan bir sağlık yazılımı firmasıyla oturduk, adam bana net söyledi: “Aşkın bey, hasta verisini ABD’deki bir sunucuya göndermem mümkün değil. KVKK bizi yakar.” Haklıydı, lafı gevelemeden söyleyeyim.

Daha açık söyleyeyim, peki neden? Gecikme yüzünden. Masaüstü uygulamada kullanıcı 200ms beklemeyi pek sevmiyor, hatta bazen 100ms bile batıyor. Modeli buluta yolla, inferans yaptır, sonucu geri al derken iş uzuyor; fiber hattınız olsa bile 300-500ms bandına çıkabiliyor, yerelde işe çoğu zaman 50ms altını görüyorsunuz. Fark var mı? Var tabiî, hem de baya hissediliyor.

Ha bir de maliyet tarafı var tabi (yanlış duymadınız). Token başına ödeme modeli prototipte idare eder,. Ürün canlıya çıkınca işler değişiyor; özellikle yüksek hacimli kullanımda fatura bir anda şişebiliyor. Bir müşterimizde aylık Azure OpenAI faturası 4.500 dolara çıkmıştı, sadece iç kullanım için. Yerel modelde bu kalem yoktu. Sıfır! Şaşırdım açıkçası.

Foundry Local, bulutun alternatifi değil — tamamlayıcısı. Microsoft’un vizyonu zaten bu: buluttan edge’e kadar uzanan bir AI yelpazesi. Frontier modeller bulutta, hafif modeller cihazda.

Foundry Local Nasıl Çalışıyor?

Mimariyi anlamak zor değil, çünkü Microsoft işi gereksiz yere dallandırıp budaklandırmamış. SDK’yı projeye ekliyorsunuz, build sırasında Foundry Local Core ile ONNX Runtime ikilisi uygulamanın içine giriyor, sonra da kullanıcı tarafında ekstra kurulum istemeden çalışıyor; yanı sız uygulamayı veriyorsunuz, AI kısmı da onunla birlikte geliyor. Güzel tarafı bu.

Çok konuştum, örnekle göstereyim.

Kurulum: Dört Satır Kod

# JavaScript

npm install foundry-local-sdk

# Python

pip install foundry-local-sdk

# C#

dotnet add package Microsoft.AI.Foundry.Local

# Rust

cargo add foundry-local-sdkİşin garibi, Dört farklı dil için SDK var. Ben Python ve C# tarafını denedim, açık konuşayım Python hızlı prototip çıkarırken baya iş görüyor, C# işe.NET masaüstü uygulamalarına gömmek için daha rahat geliyor; bir de Rust desteği var ki, hani performansın biraz can sıkıcı derecede önemli olduğu edge senaryolarında fena durmuyor. JavaScript tarafına henüz fazla kurcalamadım, ama Electron işlerinde aklımda dürüyor.

Model Yönetimi: Akıllıca Tasarlanmış

İlk çalıştırmada model Foundry Catalog’dan indiriliyor. Ama burada küçük bir sürpriz var — model cihazın donanımına göre otomatik uyarlanıyor, yanı GPU’lu makinede başka bir yol izliyor, sadece CPU olan sistemde başka bir versiyon devreye giriyor; sonra da işler yerel cache üzerinden dönüyor ve internet bağlantısı olmadan devam edebiliyorsunuz. Kısacası ilk indirme var, sonrası sakın.

Windows tarafında WinML (Windows ML) entegrasyonu kullanılıyor. Bu ne demek? Donanım sürücüsü uyumu Windows Update üzerinden kendi kendine toparlanıyor; son kullanıcı CUDA mı kuracak, DirectML mi uğraşacak diye kafa yormuyor (en azından benim deneyimim böyle). macOS cephesinde işe Apple Silicon GPU’yu Metal API üzerinden kullanıyor, yanı M1, M2 ve M3 çiplerde doğrudan çalışıyor. Evet, olay bu kadar sade görünüyor.

Türkiye’deki Şirketler İçin Ne Anlama Geliyor?

Bunu Türkiye tarafında düşünelim biraz. Kurumsal müşterilerimde son altı ayda şunu net gördüm: yerel AI’a ilgi bir anda arttı. Sebep de aslında çok net, yanı KVKK baskısı var, dolar bazlı bulut faturası can sıkıyor, bir de açık konuşayım, bazı bölgelerde internet hâlâ naz yapıyor.

Hmm, bunu nasıl anlatsamdı…

Vallahi, Bir bankacılık işinde doküman sınıflandırma yapıyorduk. İlk niyet Azure AI Services kullanmaktı. Hani ne farkı var diyorsunuz, değil mi? Sonra bilgi güvenliği ekibi çıkıp “müşteri belgeleri buluta çıkamaz” dedi, iş orada iki ay takıldı; Foundry Local gibi bir seçenek o gün elimizde olsaydı, büyük ihtimalle proje bu kadar beklemezdi.

Şimdi maliyet kısmına gelelim. Azure OpenAI’da GPT-4o kullanırken input için milyon token başına yaklaşık 2.50 dolar, output için de 10 dolar civarı bir rakam görüyorsunuz. Ayda 50 milyon token yiyen bir uygulama düşünün; sadece API faturası 500-600 dolar bandına geliyor, TL ile bakınca da bugünkü kurla 20.000 TL’nın üstü oluyor. Foundry Local tarafında bu kalem sıfır, ama dur bir saniye — model daha küçük. Kapasite de doğal olarak sınırlı; yine de çoğu use case için baya iş görüyor.

Peki neden?

| Kriter | Azure OpenAI (Bulut) | Foundry Local (Cihaz) |

|---|---|---|

| Gecikme | 200-800ms | 20-80ms |

| Token maliyeti | Kullanım başına ücret | Sıfır |

| Veri gizliliği | Veri buluta çıkar | Veri cihazda kalır |

| İnternet gereksinimi | Zorunlu | Sadece ilk model indirme |

| Model kapasitesi | Frontier modeller (GPT-4o, o3) | Küçük/orta SLM’ler |

| Platform desteği | Her platform (API üzerinden) | Windows, macOS, Linux, Android |

| Çevrimdışı çalışma | Hayır | Evet |

Evet.

Garip gelecek ama, Bence asıl mesele şu: Türkiye’de her senaryo buluta uygun değil. Bazı işler için merkezî (belki yanılıyorum ama) servisler gayet yeterli olurken, bazıları için veriyi cihazda tutmak daha mantıklı geliyor; hele regülasyon, gecikme ve maliyet aynı masaya oturunca tablo biraz değişiyor. Sız ne dersiniz? Daha fazla bilgi için Copilot CLI’da Auto Model Seçimi: Ne İşe Yarıyor? yazımıza bakabilirsiniz. Bu konuyla ilgili MSVC 14.51 RC Çıktı: Derleyici Tarafında Neler Var? yazımıza da göz atmanızı tavsiye ederim.

Durun, bir saniye. Azure DevOps Server Nisan Yaması: Ne Geldi, Ne Yapmalı? yazımızda bu konuya da değinmiştik.

Neyse, çok dağıtmadan söyleyeyim: Foundry Local her şeyi çözen sihirli kutu değil. Mantıklı değil mi? Ama çevrimdışı çalışma ihtiyacı varsa, veri dışarı çıkmasın deniyorsa ya da maliyetin hesabı çok sıkı tutuluyorsa, ciddi şekilde değerlendirilmeyi hak ediyor.

Tam da öyle.

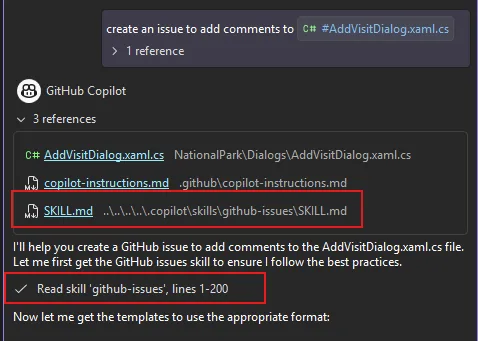

OpenAI Uyumlu API: Geçiş Acısız

Foundry Local’in bence en akıllı tarafı burası. API formatı, OpenAI request/response yapısıyla uyumlu geliyor; chat completions, ses transkripsiyon ve Open Responses API desteği de var. Bu ne anlama geliyor? Mevcut uygulamanız Azure OpenAI ya da direkt OpenAI API’si kullanıyorsa, çoğu zaman endpoint’i değiştirmeniz yetiyor. Kod tarafı da baya az oynuyor. Daha fazla bilgi için Azure iPaaS’ta 8. Liderlik: Ne Anlama Geliyor? yazımıza bakabilirsiniz.

2024 sonlarında bir müşterimizde — telekom tarafında büyükçe bir firmaydı — Azure OpenAI üzerinde çalışan bir chatbot vardı. “Acaba bunu hibrit yapabilir mıyız?” diye uzun uzun konuşmuştuk. Basit sorular yerelde çözülsün, zor sorular buluta gitsin istiyorduk; o günlerde bu iş biraz uğraştırıcı görünüyordu, çünkü routing mantığını oturtmak için epey ince ayar gerekiyordu. Şimdi işe Foundry Local ile tablo değişti. Aynı API formatı sayesinde bu geçiş, birkaç satırlık yönlendirme koduyla halledilebiliyor.

Ha bu arada, Azure Local ve Armada: Edge’de Egemen AI Dönemi yazımda edge computing vizyonundan bahsetmiştim. Foundry Local da o çizginin devamı gibi dürüyor; hatta biraz daha ileri gidip cihaz seviyesine kadar iniyor artık (ki bu çoğu kişinin gözünden kaçıyor). Evet, tam da orası.

Küçük Ekip mi, Büyük Kurum mu? Senaryolara Göre Değerlendirme

Startup / Küçük Ekip Senaryosu

3-5 kişilik bir ekipseniz, masaüstü uygulamanıza AI eklemek de aklınızdaysa, Foundry Local baya iş görüyor. Neden? Bulut altyapısı kurmuyorsunuz, API key peşinde koşmuyorsunuz, fatura kontrolüyle uğraşmıyorsunuz. SDK’yı ekliyorsunuz, modeli seçiyorsunuz, uygulamayı paketliyorsunuz. Bitti. CI/CD pipeline’ınız da gereksiz yere şişmiyor; çünkü dependency’ler hafif kalıyor.

Bir arkadaşım küçük bir not alma uygulaması yapıyor. İçine sesli not özelliği koymak istedi, yanı konuşmayı metne çevirme işi. Whisper API kullanıyordu ve ayda 80-90 dolar ödüyordu. Sonra Foundry Local’in ses transkripsiyon desteğini denedi; maliyet sıfıra indi. Tabiî model biraz daha az doğru çıktı — özellikle Türkçe’de — ama İngilizce için idare eder dedi (ki bu çoğu kişinin gözünden kaçıyor)

Çok konuştum, örnekle göstereyim.

Evet.

Enterprise / Büyük Kurum Senaryosu

Büyük kurumsal yapılarda tablo biraz değişiyor. Burada genelde hibrit yaklaşım daha mantıklı geliyor; hassas veriler yerelde işleniyor, ağır analizler buluta gidiyor (işin aslı bu dengeyi tutturmak bazen ayrı dert), Foundry Local’i Azure Foundry ile birlikte kullanmak da enterprise tarafında fena olmayan bir strateji oluyor (ilk duyduğumda inanamadım)

Ama dur bir saniye — burada iş bitmiyor. Enterprise’da model yönetimi var, güncelleme dağıtımı var, cihaz envanteri var. 10.000 masaüstüne Foundry Local dağıtmak öyle “kur gitsin” işi değil. SCCM ya da Intune üzerinden model güncelleme stratejisini düşünmeniz gerekiyor; Microsoft bu kısmı henüz çok açmadı, biraz daha pişmesi lazım bence.

Peki neden?

Bu arada Foundry Fine-Tuning Nisan Güncellemesi: RFT Artık Ucuz yazıma da bakmanızı öneririm. Bulut tarafında fine-tuning maliyetleri düşerken, yerel tarafta önceden optimize edilmiş modeller geliyor. Iki taraf birbirini tamamlıyor gibi dürüyor, hatta açık konuşayım bu ikili yaklaşım ileride daha da anlam kazanacak. Bu konuyla ilgili Kubernetes Image Promoter Yeniden Yazıldı: Sessiz Devrim yazımıza da göz atmanızı tavsiye ederim.

Bilmem anlatabiliyor muyum, Tam da öyle.

İlk Deneyimlerim ve Birkaç Hayal Kırıklığı

Dürüst olayım, Foundry Local’i ilk kurcaladığımda işler pek pürüzsüz gitmedi. Python SDK’sını pip ile kurdum, o kısım sıkıntısızdı. Ilk model indirmesinde bir timeout — kendi adıma konuşayım — patladı, sonra baktım ki sebep baya basitmiş: şirket VPN’i Foundry Catalog’a giden yolu kesiyormuş. VPN’i kapattım, model indi. Sonra tekrar açtım, cache’den devam etti. Güzel tarafı bu, ama enterprise tarafta proxy ve firewall arkasında dağıtacaksanız, bunu en baştan hesaba katmanız gerekiyor.

Doğrusu, Bir de şu boyut meselesi var, hani herkesin atladığı kısım. “Uygulama yükleyicisine gömecek kadar küçük” deniyor ya, evet SDK gerçekten küçük kalıyor; ama iş model dosyalarına gelince tablo değişiyor, çünkü kullandığınız modele göre 1-4 GB arasında bir indirme yapıyorsunuz ve ilk çalıştırmada kullanıcı buna mecburen bekliyor. Açık konuşayım, bu noktada UX tarafını biraz akıllı kurmak lazım, yoksa insan daha başlamadan homurdanıyor.

Performans kısmı işe beni şaşırttı açıkçası. M3 MacBook Pro’mda chat completions neredeyse anlık geldi; Windows tarafında RTX 3060’lı bir makinede de fena değildi. Ama eski bir Intel iGPU’lu laptopta… şey… orası biraz başka hikâye. Evet, çalışıyor; ama “hızlı” demem zor. O senaryoda CPU-only moda düşüyor ve response süresi 2-3 saniyeye çıkabiliyor, yanı idare eder ama insanın sabrı da sınanıyor.

Pratik Adımlar: Nereden Başlamalı?

Nereden başlayacağım diye düşünüyorsanız, haklısınız. İlk bakışta biraz dağınık dürüyor, ama işin aslı o kadar da karmaşık değil; küçük bir kurulumla girip, sonra adım adım ilerlemek daha mantıklı oluyor.

Denemek istiyorsanız, şu adımları izleyin:

- SDK’yı kurun — Hangi dilde çalışıyorsanız, ilgili paketi ekleyin. Python genelde en rahat başlangıç oluyor, ama elinizde başka bir stack varsa önü da zorlamayın, önce ayağa kalksın yeter.

- Foundry Catalog’a göz atın — Hangi modeller var, hangisi sizin use case’inize uyuyor, bir bakın. Hepsine aynı anda yüklenmeye gerek yok; bazen sade bir model, beklediğinizden daha iyi iş görüyor.

- Küçük bir PoC yapın — Var olan OpenAI entegrasyonunuzu alın, endpoint’i Foundry Local’e çevirin, farkı görün. Burada amaç büyük mimarı kurmak değil; ufak bir testle nerede tıkandığını anlamak.

- Donanım testlerini yapın — Hedef cihazlarda performansı ölçün. Her makine aynı tepkiyi vermiyor, hatta bazen kağıt üstünde iyi duran sistem sahada biraz naz yapabiliyor.

- Hibrit strateji planlayın — Hangi senaryolar yerel kalacak, hangileri buluta gidecek, bunu baştan belirleyin. Sonradan karar değiştirmek mümkün tabiî, ama en başta çizmek işleri baya rahatlatıyor.

Ha, şunu da ekleyeyim: Eğer Azure DevOps Güvenlik Taraması: Tek Tıkla Başlıyor yazısındaki gibi CI/CD pipeline’ınızda güvenlik taramaları yapıyorsanız, Foundry Local’in dependency’lerini de o sürece dahil etmeyi unutmayın. Yeni bir bağımlılık ekliyorsunuz sonuçta; küçük gibi dürüyor ama sonra sürpriz çıkmasın diye baştan kontrol etmek iyi oluyor.

Kağıt Üstünde Süper, Pratikte Göreceğiz

Vallahi, Foundry Local’in GA’ya çıkması, açık konuşayım, önemli bir eşik — bence çok yerinde bir karar —. Microsoft’un “AI her yerde” fikrinin elle tutulur tarafı da bu işte. Ama hemen sevinip geçmeyelim. Model çeşitliliği yeterli mi? Türkçe tarafı nasıl dürüyor? Enterprise yönetim araçları ne zaman gelir? Cihaz uyumluluk matrisi biraz daha açılır mı?

Bence yön doğru. Fena değil yanı. Ama hâlâ erken aşama kokusu alıyorum,. Üretim ortamına girmeden önce işi sıkı tutmak gerekiyor (özellikle hedef donanımlarda performans benchmark’ları almak, sonra da küçük bir pilotla başlamak bence daha mantıklı). Sonra genişletirsiniz. Yoksa kağıt üstünde güzel duran şey, sahada biraz tökezleyebiliyor.

Neyse, çok dağıtmayayım. Denemekten zarar gelmez — SDK’yı kurun, kurcalayın, bakın ne çıkıyor. Sonuçta ücretsiz. Evet.

Sıkça Sorulan Sorular

Foundry Local internet olmadan çalışır mı?

Evet, model bir kez indirildikten sonra tamamen çevrimdışı çalışıyor. Dosya cihazın yerel cache’ine kaydediliyor ve sonraki seferlerde internet bağlantısına hiç gerek kalmıyor.

Foundry Local hangi programlama dillerini destekliyor?

Kendi deneyimimden konuşuyorum, Şu an için Python, JavaScript (Node.js), C# (.NET) ve Rust için resmî SDK’lar var. Aslında API formatı OpenAI uyumlu olduğundan, diğer dillerde de HTTP üzerinden rahatlıkla kullanabilirsiniz.

Foundry Local ile Azure OpenAI arasında geçiş yapmak zor mu?

Açıkçası, hiç zor değil. İkisi de aynı OpenAI request/response formatını kullanıyor. Çoğu durumda yanı sadece endpoint URL’ını değiştirmek yetiyor — kod tarafında ciddi bir şey değiştirmenize gerek kalmıyor.

Foundry Local’de Türkçe dil desteği var mı?

Bu biraz modelin yeteneklerine bağlı. Chat modellerinde Türkçe desteği mevcut, ama bence İngilizce kadar güçlü değil henüz. Ses transkripsiyon tarafında işe Türkçe performansı hâlâ sınırlı — bu konuda iyileştirme bekliyorum açıkçası.

Foundry Local ücretsiz mi?

Aslında, SDK ve runtime tamamen ücretsiz. Token başına ya da kullanım başına herhangi bir ücret yok (kendi tecrübem). Tek maliyet, hani çalıştırdığınız donanımın kendi maliyeti. Bulut faturası sıfır.

Kaynaklar ve İleri Okuma

Foundry Local GA Duyurusu — Microsoft Developer Blog

Microsoft Foundry Resmî Dokümantasyonu

Foundry Local SDK — GitHub Repository

Bu içerik işinize yaradı mı?

Benzer içerikleri kaçırmamak için beni sosyal medyada takip edin.

2 comments