Azure Local ve Armada: Edge’de Egemen AI Dönemi

Eh, Geçen ay bir savunma sanayi firmasıyla toplantıdaydım. Adam masaya oturur oturmaz “Bulut güzel de, biz veriyi Türkiye dışına çıkaramayız, bağlantı da genelde garanti değil” dedi. Ben de içimden “İşte tam da bu yüzden edge computing konuşmamız lazım” dedim. Sonra Microsoft’un Armada ile yaptığı iş birliğini anlattım — adamın gözleri parladı. Bu ne anlama geliyor? Bugün tam olarak bunu yazacağım.

Şunu söyleyeyim, Bakın şimdi, bulut dediğimiz şey fena değil. Ama her yerde, her koşulda çalışmıyor; özellikle savunma, enerji ve kilit altyapı tarafında, verinin üretildiği yere yakın işlenmesi gerekiyor (yoksa bağlantı gider, işler de biraz saçmalar) (en azından benim deneyimim böyle). İnternetin kesik kesik olduğu, hatta bazen hiç olmadığı ortamlar var… İşte Microsoft ile Armada’nın birlikte duyurduğu çözüm tam da bu boşluğu dolduruyor.

Egemenlik Meselesi: Neden Bu Kadar Önemli?

Dijital egemenlik, yanı sovereign cloud, Türkiye’de artık daha sık konuşuluyor. KVKK var, BDDK’nın bankacılık verileriyle ilgili kuralları var, bir de savunma tarafındaki gizlilik hassasiyeti var; bunları yan yana koyunca, verinin nerede durduğu işi “olsa iyi olur” seviyesinden çıkıp direkt “tamam, bunu çözmemiz lazım” noktasına geliyor (bizzat test ettim)

Ve işler burada ilginçleşiyor.

Hani şöyle düşünün: Bir enerji şirketi Doğu Anadolu’daki bir rüzgâr santralinde edge AI çalıştırmak istiyor, ama orada fiber yok, uydu bağlantısı var (o da bazen gelip bazen gidiyor), dolayısıyla klasik Azure senaryosu her zaman oturmuyor. Peki ne yapacak? İşte burada Azure Local devreye giriyor.

2023’te bir kamu kurumunda benzer bir durumla uğraşmıştık (yanlış duymadınız). Kurum sahadan veri topluyordu ama bu veriler büyük ihtimalle yurt dışına çıkmamalıydı; üstüne bir de internet bağlantısı güven vermiyordu, yanı işin içine hem regülasyon hem de saha gerçekleri girince tablo biraz karışmıştı. O zaman Azure Stack HCI kullanmıştık ama disconnected senaryolarda açık konuşayım epey zorlanmıştık; şimdi bu yeni yapıyla o dertlerin çoğu azalmış gibi dürüyor, en azından ilk bakışta.

Azure Local Nedir, Ne Değildir?

Azure Local’ı duymayanlar için kısa keseyim. Eskiden Azure Stack HCI diye bildiğimiz yapının biraz evrilmiş hali bu, yanı Microsoft tarafında on-premises çalışan bir bulut yaklaşımı diyebiliriz; ama işin ilginç yanı, disconnected ve sovereign senaryolarda da gayet yol alıyor.

Ve işler burada ilginçleşiyor.

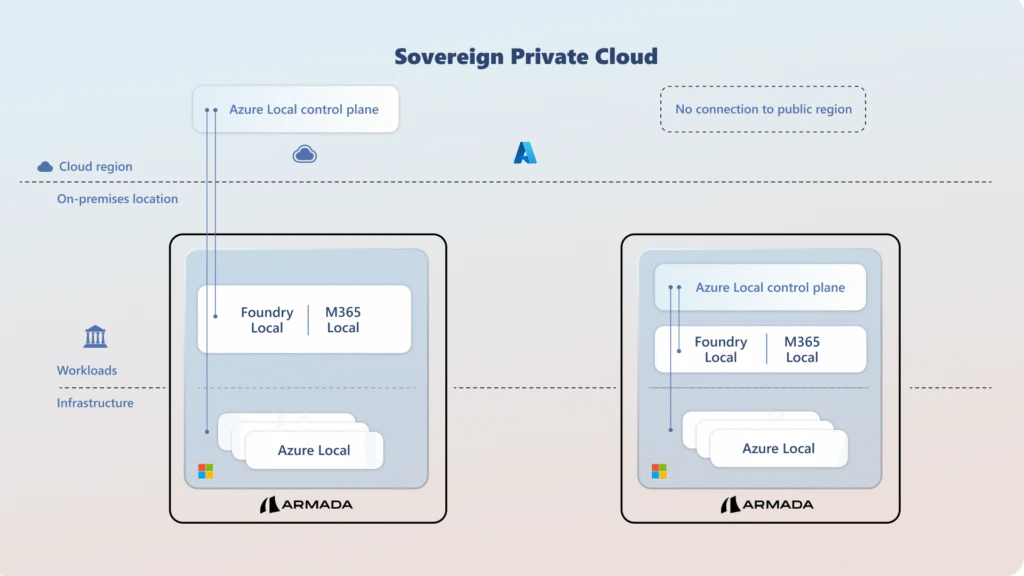

Peki ne fark ediyor? Azure’un kontrol düzlemi, yönetim araçları ve güvenlik modeli sizin veri merkezinizde ya da sahada dönüyor, buluta bağlı kalmadan iş görüyor, bağlanırsanız tamamdır ama bağlanamazsanız da sistem “ben buradayım” deyip çalışmayı sürdürüyor. Evet.

Armada Galleon MDC: Taşınabilir Veri Merkezî

Armada’nın Galleon modüler veri merkezleri (MDC) işe işin daha fiziksel, daha elle tutulur tarafı. Bunları konteyner boyutunda, taşınabilir ve hızlı kurulabilen mini veri merkezleri gibi düşünün; askeri operasyonlar, afet bölgeleri, uzak enerji tesisleri… yanı nereye lazım olursa oraya gidiyor.

Armada Edge Platform (AEP) de bu donanımın üstüne oturan yazılım katmanı olarak geliyor (inanın bana). Uydu, LTE/5G, RF ve SD-WAN gibi çoklu ağ bağlantısını destekliyor; bir hat giderse öteki devreye giriyor (şey, kulağa basit geliyor ama sahada baya fark yaratıyor), çünkü Türkiye’deki saha koşullarında tek bağlantı noktasına yaslanmak açık konuşayım pek akıllıca değil.

Teknik Mimarı: İçeride Ne Var?

Dur bir saniye, biraz tekniğe girelim. Çünkü “sovereign edge AI” demek güzel de, altında ne var önü bilmek lazım.

| Bileşen | Açıklama | Faydası |

|---|---|---|

| Azure Local Control Plane | On-prem çalışan Azure yönetim katmanı | Bağlantısız ortamda bile Azure deneyimi |

| Galleon MDC | Modüler, taşınabilir veri merkezî donanımı | Hızlı kurulum, zorlu ortamlara dayanıklılık |

| Armada Edge Platform (AEP) | Çoklu ağ bağlantısı ve orkestrasyon | Uydu, 5G, RF arası otomatik geçiş |

| Foundry Local | Edge’de AI model dağıtımı ve yönetimi | Tamamen yerelde çalışan AI inference |

| Multi-rack Scalability | Birden fazla rack ile ölçeklendirme | Küçük başla, ihtiyaca göre büyüt |

| Hyperconverged + SAN Storage | Esnek depolama mimarileri | İş yüküne göre depolama seçimi |

Burada dikkat çekmek istediğim nokta şu: multi-rack scalability desteği var. Yanı tek bir Galleon ile başlayıp, ihtiyaç büyüdükçe ek rackler ekleyebiliyorsunuz. Bu, özellikle bütçesi kısıtlı ama büyüme potansiyeli olan projeler için çok değerli. Bir anda büyük yatırım yapmak yerine adım adım ilerleyebiliyorsunuz.

Depolama Esnekliği

Bence, Hyperconverged ve SAN-backed deployment seçeneklerinin ikisini de desteklemesi güzel bir detay. Hani bazı müşterilerimiz “biz zaten SAN altyapımızı kurduk, önü kullanmak istiyoruz” diyor. Bazıları işe sıfırdan başlıyor ve hyperconverged daha mantıklı oluyor. İkisini de desteklemek — akıllıca.

Edge’de AI: Foundry Local ile Neler Mümkün?

Ha bu arada, asıl heyecan verici taraf AI kısmı. Foundry Local — daha önce Foundry Fine-Tuning Nisan Güncellemesi: RFT Artık Ucuz yazısında fine-tuning tarafına değinmiştik — şimdi işi bayağı edge’e,. Yerelde çalışan AI inference’a getiriyor. Kulağa sade geliyor, ama işin içinde baya hayatı farklar var.

Foundry Local ile AI modellerini doğrudan Galleon MDC üzerinde çalıştırabiliyorsunuz. Veri dışarı çıkmıyor, model yerelde kalıyor. Bu ne demek? Mesela bir savunma uygulamasında görüntü analizi yapıyorsunuz; drone görüntülerini anlık işlemek zorundasınız,. O veriyi buluta yollamak istemiyorsunuz. Tam burada devreye giriyor işte. Peki neden? Çünkü bazen gecikme kabul etmiyor, bazen de mevzuat yüzünden tek seçenek bu oluyor.

İşte tam da bu noktada devreye giriyor.

Egemen AI’ın özü şu: Modeliniz sizin kontrolünüzde, veriniz sizin toprağınızda, çıkarım (inference) sizin donanımınızda. Buluta hiçbir şey gitmek zorunda değil.

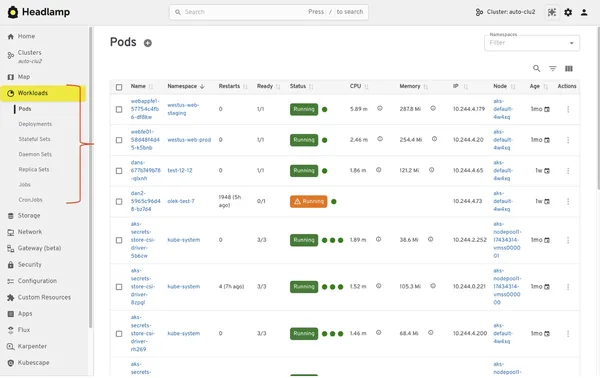

Vallahi, Ama açık konuşayım — bu teknolojinin oturması biraz vakit alacak gibi dürüyor (yanlış duymadınız). İlk deneyimlerimde Azure Stack HCI üzerinde AI workload’ları çalıştırırken GPU driver uyumsuzlukları, Kubernetes sürümüyle ilgili ufak tefek dertler ve garip davranan bileşenler yüzünden epey uğraşmıştık; hatta 2024 başında bir enerji müşterisinde AKS (Azure Kubernetes Service) on Azure Local kurulumunda tam 3 gün driver sorunu çözmeye gömülmüştük. Armada’nın bu tarz sıkıntıları referans mimaride ne kadar toparladığını görmemiz lazım, çünkü şu an için ben de net konuşamıyorum.

Türkiye Perspektifi: Kimler İçin Mantıklı?

Şimdi asıl yere gelelim. Bu iş Türkiye’deki şirketler için ne anlama geliyor, hani orası biraz kritik.

Bence en büyük fırsat savunma tarafında dürüyor. Türkiye’nın savunma sanayii son 10 yılda baya büyüdü; Baykar, ASELSAN, HAVELSAN gibi firmalar edge computing ve AI entegrasyonunu sürekli yokluyor, bir de NATO uyumluluğu işi var ki o kısım ayrı bir dert. Azure Local ile Armada’nın birlikte kullanımı, tam bu ihtiyaçlara cevap verebilecek gibi dürüyor. VS Live! Las Vegas 2026: İzlenmesi Gereken 20 Oturum yazımızda bu konuya da değinmiştik. Bu konuyla ilgili Claude Opus 4.7 Copilot’a Geldi: İlk İzlenimler yazımıza da göz atmanızı tavsiye ederim.

Bir de enerji sektörü var tabiî. Türkiye’de yenilenebilir yatırımlar hız kesmeden artıyor. Rüzgâr çiftlikleri, güneş santralleri, yanı çoğu tesis şehirden uzak yerde; veri de orada doğuyor zaten. Edge AI ile predictive maintenance yapmak, arızayı daha olmadan koklamak, şey, baya işe yarıyor. Geçen ay Logosoft’ta bir enerji müşterimizle konuşuyorduk; adam net söyledi: “Biz sahada veri topluyoruz. Analiz için İstanbul’a göndermek zorunda kalıyoruz, gecikme çok fazla.” İşte bu çözüm o beklemeyi azaltıyor.

Enterprise vs Küçük Ekip Karşılaştırması

Büyük kurumsal taraftaysanız — mesela banka, telekom operatörü ya da savunma firması — bu opsiyonu kenara not etmek lazım. Bütçe var, ekip var (en azından çoğu zaman), compliance baskısı da sizi zaten bu tarafa itiyor.

İlginç olan şu ki, Ama küçük bir startup’sanız ya da orta ölçekli bir firmaysanız? Hmm, burada biraz frene basarım açık konuşayım. Galleon MDC’nın maliyeti henüz net değil ama modüler veri merkezî dediğimiz şey ucuz olmaz; olursa şaşırırım. Küçük ekipseniz Azure IoT Edge veya Azure Arc ile elinizdeki donanımı kullanmak daha mantıklı olabilir. Hatta bazı senaryolarda Raspberry Pi üstünde edge inference bile iş görüyor — evet, abartı gibi geliyor. Bazen yetiyor.

Bağlantısız Ortam Desteği: Gerçekten Çalışıyor mu?

Disconnected, yanı tamamen bağlantısız ortam desteği, bu çözümün en kritik iddialarından biri. Ama açık konuşayım, kağıt üstünde kolay duran şey, sahada bambaşka bir hikâye oluyor.

2019’da, henüz Azure Stack HCI bile ortada düzgün oturmamışken, bir müşteride tamamen offline çalışan bir küme kurmuştuk. İlk kurulumda her şey yolundaydı, hatta ekip biraz rahatlamıştı; ama güncelleme vakti gelince iş tersine döndü, firmware yamaları, güvenlik düzeltmeleri ve sertifika yenilemeleri derken hepsini USB ile taşıdık, bir güncelleme döngüsü de tam 2 hafta sürdü.

Şimdi Azure Local’ın disconnected modda bunu nasıl ele aldığını merak ediyorum. Microsoft dokümanında “intermittently connected”. “fully disconnected” senaryolarını ayrı ayrı anlatıyor; aralıklı bağlantı varsa güncelleme pencerelerinde senkronizasyon yapabiliyorsunuz, ama tamamen bağlantısız tarafta… hmm, hâlâ manuel dokunuş gerekiyor gibi dürüyor. Bu kısım biraz daha olgunlaşmalı bence.

Kısa bir not düşeyim buraya. Bu konuyla ilgili GitHub Rule Insights Dashboard: Kural Yönetimi Kolaylaştı yazımıza da göz atmanızı tavsiye ederim.

Bak şimdi, Armada’nın çoklu ağ bağlantısı desteği burada devreye giriyor; uydu, 5G, RF ve SD-WAN seçenekleriyle tamamen offline kalmak yerine arada bir bağlantı yakalayabiliyorsanız, iş baya değişiyor. Uydu tarafı da fena değil artık — özellikle Starlink gibi LEO servisleriyle uzak lokasyonlarda erişim mümkün oluyor — böylece “fully disconnected” senaryosu çoğu zaman “intermittently connected”a dönüyor, ki yönetmesi çok daha rahat bir tablo (bu beni çok şaşırttı) GitHub CLI ile Agent Skill Yönetimi: Tam Rehber yazımızda bu konuya da değinmiştik.

Güvenlik ve Uyumluluk: Kâğıt Üstünde Süper, Pratikte?

Güvenlik tarafında Microsoft’un sovereign cloud yaklaşımı bayağı geniş. Veri şifreleme, yanı at rest ve in transit, RBAC, Azure Policy, Defender for Cloud entegrasyonu… Tahmin eder mısınız? Bunların hepsi Azure Local üzerinde çalışıyor, en azından kağıt üstünde iş güzel görünüyor.

Ama sahada iş biraz değişiyor. Güvenlik ayaru ne kadar dallı budaklıysa, edge ortamında o kadar çok sürpriz çıkıyor; bir finans kuruluşunda Azure Local kurulumunda Defender for Cloud agent’ının disconnected modda telemetri biriktirip bağlantı gelince göndermesini ayarlamak tam 4 saat sürmüştü, küçük bir detay gibi dürüyor. Orada çalışan teknisyen için baya can sıkıcı oluyor.

Kısacası, i̇lginç olan şu ki, Gel gelelim, Armada’nın “hardening” yaklaşımı — yanı sistemi güvenlik açısından sertleştirmesi — askeri ve devlet projelerinde ciddi bir ihtiyaç. STIG (Security Technical Implementation Guide) uyumluluğu, FIPS 140-2/3 kriptografi standartları (yanlış duymadınız). Bunlar Türkiye’deki savunma projelerinde de karşınıza çıkıyor; Azure MCP Server 2.0: Kendi Sunucunuzda Ajan Otomasyonu yazısında ajan otomasyonundan bahsetmiştik ya, işte bu tip otomasyonlar güvenlik yönetimini edge tarafında da biraz nefes aldırıyor.

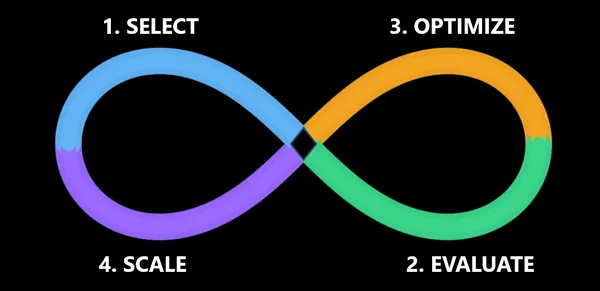

İlk Adımlar: Ne Yapmalı?

Eğer bu konu ilgini çektiyse, dur hemen Galleon MDC sipariş etmeye çalışma. Önce biraz yere basan iş yap, sonra karar ver:

- Azure Local’ı bir lab ortamında dene. Elinde uygun donanım varsa (en az 2 node, her biri minimum 64GB RAM), Azure Local kurulumu yapıp bir bakabilirsin. Disconnected modda nasıl davrandığını görmek de iyi fikir; bazen kağıt üstünde tamam duran şey, sahada biraz farklı çıkıyor.

- İş yüklerini analiz et. Hangi workload’lar gerçekten edge’de kalmak zorunda? Hangilerini public cloud tarafında bırakmak daha mantıklı? Bu ayrımı netleştirmeden para gömmek bence erken olur, çünkü her uygulama edge için koşmuyor.

- Maliyet modelini çıkar. Azure Local lisanslama, donanım ve operasyonel maliyetleri birlikte düşünmek lazım (sahadaki personel, enerji, soğutma gibi kalemler de cabası). Sonra bunu public cloud maliyetiyle yan yana koy; rakamlar bazen insanı şaşırtıyor açık konuşayım.

- Microsoft partner ağını kullan. Türkiye’de Azure Local kurulumu yapabilen partnerler var — Logosoft da bunlardan biri. Referans mimariler ve PoC (Proof of Concept) desteği almak işini baya kolaylaştırabilir, hele ilk kurulumda tek başına uğraşmak istemiyorsan fena değil.

Size bir şey söyleyeyim, Ha, neredeyse unutuyordum: Kubernetes 1.36 Ön İzleme: Neler Geliyor, Neler Gidiyor? yazısında Kubernetes’in yeni özelliklerinden bahsetmiştik. Azure Local üzerinde AKS kullanacaksan bu güncellemeleri takip etmen önemli; edge ortamında Kubernetes sürüm uyumsuzluğu insanın başını gerçekten ağrıtıyor.

Son Söz: Doğru Yönde Ama Daha Yolun Başı

Microsoft ile Armada’nın bu işi, bence doğru tarafa atılmış sağlam bir adım. Edge computing. Sovereign AI artık kenarda köşede duran bir başlık değil; hele jeopolitik gerilimler artınca, veri egemenliği resmen stratejik meseleye dönüyor.

Aslında — hayır dur, daha doğrusu, Ama dur, burada frene basmak lazım. Referans mimarı fena değil, vaat de öyle; yine de sahada, özellikle Türkiye koşullarında ne çıkacak, bunu zaman gösterecek (ben iyimserim ama gözüm de açık), çünkü bu işte “demo’da çalışıyor” ile “production’da çalışıyor” arasında bazen bildiğin uçurum oluyor.

Yanı, 2025’in ikinci yarısında edge AI projelerinde artış görürüz gibi geliyor. Hazırlıklı olmakta fayda var.

Sıkça Sorulan Sorular

Azure Local ile Azure Stack HCI arasında ne fark var?

Garip gelecek ama, Azure Local, aslında Azure Stack HCI’ın geliştirilmiş versiyonu. En önemli fark şu: bağlantısız ortamlarda çalışabilmesi (en azından benim deneyimim böyle). Sovereign cloud özelliklerinin doğrudan içine entegre edilmesi. Yanı sadece işim değişikliği değil — özellikle kontrol düzlemi tarafında ciddi mimarı iyileştirmeler de geliyor.

Armada Galleon MDC’yi Türkiye’den temin edebilir mıyız?

Şu an için Armada’nın Türkiye’de doğrudan bir satış kanalı yok. Ama Microsoft partner ağı üzerinden temin etmek mümkün. Savunma ve kamu projeleri için özel tedarik süreçleri işliyor. Bence en sağlıklısı Microsoft Türkiye veya yetkili partnerlerden biri ile direkt iletişime geçmek — detayları onlar en iyi şekilde aktarır.

Durun, bir saniye.

Edge’de AI çalıştırmak için ne kadar GPU gerekiyor?

Açıkçası bu tamamen iş yüküne bağlı. Mesela basit bir görüntü sınıflandırma senaryosu için tek bir NVIDIA T4 gayet yeterli olabiliyor. Ama daha karmaşık LLM inference işleri için A100 ya da H100 seviyesine çıkmanız gerekiyor (bizzat test ettim). Galleon MDC GPU ayarunda esnek — yanı ihtiyacınıza göre şekillendirebiliyorsunuz,. Maliyet de buna paralel olarak artıyor tabiî.

Tamamen bağlantısız ortamda güncellemeler nasıl oluyor?

Fully disconnected modda güncellemeler fiziksel medya ile taşınıyor — hani USB ya da taşınabilir disk gibi. Azure Local’ın update management özelliği paketleri hazırlayıp offline transfer için uygun hâle getiriyor (eh, fena değil). Ama tecrübeme göre bu süreç hâlâ biraz zahmetli (ki bu çoğu kişinin gözünden kaçıyor). Eğer seçenek varsa, intermittently connected senaryoda işler çok daha kolay ilerliyor.

Bu çözümün aylık maliyeti ne kadar tutuyor?

Kesin bir rakam vermek zor. Donanım konfigürasyonu, lisanslama modeli ve operasyonel maliyetler çok değişken çünkü. Kabaca bir fikir vermek gerekirse: 3 node’lük bir Azure Local kümesi için lisanslama maliyeti aylık 2.000-5.000 USD civarında. Peki bunu neden söylüyorum? Galleon MDC donanımı işe yüz binlerce dolar seviyesinde bir yatırım gerektiriyor — yanı bence küçük ölçekli projeler için pek uygun bir seçenek değil.

Kaynaklar ve İleri Okuma

Building sovereign AI at the edge: Microsoft and Armada collaboration — Azure Blog

Bakın, Azure Local Resmî Dokümantasyonu — Microsoft Learn

Microsoft Sovereign Cloud Overview — Microsoft Learn

Bu içerik işinize yaradı mı?

Benzer içerikleri kaçırmamak için beni sosyal medyada takip edin.

2 comments