Copilot CLI’da Auto Model Seçimi: Ne İşe Yarıyor?

Terminal başında çalışırken “hangi AI modelini seçsem” diye düşündüğünüz öldü mu? Ben düşündüm (ciddiyim). Hatta geçen ay bir müşteride DevOps pipeline’ı optimize ederken Copilot CLI’ı açtım, model seçimi konusunda tam 5 dakika kararsız kaldım. GPT-5.4 mü, Sonnet 4.6 — kendi adıma konuşayım — mı, yoksa Codex mi? Hangisi bu iş için daha verimli? İşte GitHub tam da bu derdin üstüne gidiyor — Copilot CLI artık “auto” model seçimini destekliyor. Bu özellik tüm planlarda GA öldü.

Açık konuşayım, bu küçük görünen değişiklik aslında bayağı önemli. Çünkü model seçimi meselesi, özellikle premium request kotanızı yönetirken ciddi bir karar noktası. Yanlış model seçerseniz ya kotanızı gereksiz harcıyorsunuz — ki bu tartışılır — ya da ihtiyacınızdan düşük bir modelle vakit kaybediyorsunuz. Auto mod tam burada devreye giriyor.

Auto Model Seçimi Tam Olarak Ne Yapıyor?

Basit düşünün. Sız terminalde Copilot CLI’a bir soru soruyorsunuz, ya da bir komut yardımı istiyorsunuz; normalde hangi modelin cevap vereceğini sız seçiyordunuz, şimdi işe “auto” diyorsunuz. Gerisini Copilot toparlıyor. Arka planda GPT-5.4, GPT-5.3-Codex, Sonnet 4.6 (buna dikkat edin). Haiku 4.5 gibi modeller arasında, planınıza ve organizasyon politikalarına göre en uygun olanı seçiyor.

Ha, bir de şu var — bu routing statik değil. Bugün şu modele gidiyor diye yarın da aynı yolu izleyecek diye bir kural yok (evet, doğru duydunuz). GitHub zamanla bu havuza yeni modeller ekleyebilir, bazılarını da çıkarabilir; yanı yapı biraz canlı, biraz da kafa karıştırıcı. İyi tarafı var tabiî, kötü tarafı da var; ona birazdan geleceğim.

Benim hoşuma giden kısım şu: rate limit sıkıntısını azaltmaya çalışıyor. Hani bazen yoğun saatte bir modele istek atarsınız, yavaşlar ya da limit yer ya — auto mod bunu dengelemeye çalışıyor. Favori modeliniz meşgulse veya limite yaklaşmışsanız, başka bir modele kaydırıyor; trafik yönetimi gibi düşünün.

Şeffaflık Meselesi

Bir şeyi takdir etmem gerekiyor. GitHub, auto modun hangi modeli seçtiğini CLI çıktısında gösteriyor; yanı kör kutu değil bu iş. Cevabı aldığınızda “bu cevap GPT-5.4’ten geldi” bilgisini görebiliyorsunuz. Bu önemli. — dur bir saniye — kurumsal ortamlarda hangi modelin kullanıldığını bilmek compliance açısından hayatı oluyor; özellikle finans tarafında çalışan müşterilerimde bu soru her toplantıda çıkıyor: “Verilerimiz hangi modelden geçti?”

Durun, bir saniye.

Premium Request ve %10 İndirim Hikâyesi

Hani, Gelelim paranın döndüğü yere. Auto mod şu an 0x ile 1x çarpan arasındaki modellere yön veriyor, yanı pahalı modelleri kendi kendine seçmiyor; en azından bugünlük durum bu. Ama işin hoş tarafı başka: auto kullanınca, hangi model çarpanı gelirse gelsin, %10 indirim alıyorsunuz.

Hemen örnekleyeyim:

| Kullanım Şekli | Model Çarpanı | Harcanan Premium Request |

|---|---|---|

| Manuel model seçimi (1x model) | 1x | 1.0 |

| Auto mod (1x model seçildiğinde) | 1x × 0.9 | 0.9 |

| Manuel model seçimi (0.5x model) | 0.5x | 0.5 |

| Auto mod (0.5x model seçildiğinde) | 0.5x × 0.9 | 0.45 |

İşin garibi, İlk bakışta %10 öyle aman aman bir indirim gibi durmuyor. Ama bir durun — ayda 300 premium request hakkınız varsa. Hepsini auto ile tüketiyorsanız, 30 request cebinizde kalıyor; küçük görünüyor ama ay sonuna bakınca baya iş görüyor. Bir nevi toplu alım indirimi gibi düşünün, hani markette ikinci ürüne küçük bir indirim olur ya, mantık biraz ona benziyor.

Neyse, burada asıl niyet de belli aslında: GitHub sizi auto moda itiyor. Bu sayede altyapı tarafında yükü daha dengeli dağıtabiliyorlar. Peki neden? Çünkü herkes aynı anda en pahalı modele abanırsa işler karışıyor, sistem de nefes almak istiyor tabiî.

2026 başında bir e-ticaret şirketine Copilot Business planı kurduk, ekip 45 kişiydi ve premium request kotaları ay ortasında bitiyordu sürekli. O zaman bu auto mod yoktu; herkes GPT-5.4 seçiyordu, çünkü kafada hep şu var: “en iyisi bu olsun.” Ama işin aslı öyle değil; birçok basit CLI sorgusunda Haiku 4.5 gayet yeterli oluyor, hatta bazen insan şaşırıyor açıkçası (evet, doğru duydunuz). Auto mod olsaydı, büyük ihtimalle kotayı ay sonuna kadar taşımaları daha kolay olurdu (ki bu çoğu kişinin gözünden kaçıyor)

Auto mod sadece kolaylık değil, aynı zamanda bir maliyet optimizasyon aracı. Mesela büyük ekiplerde premium request bütçesini yönetmek için ciddi bir avantaj sağlıyor.

Türkiye’deki Ekipler İçin Gerçekçi Değerlendirme

Şimdi bakın, Türkiye’de GitHub Copilot kullanan ekiplerin çoğu — en azından benim gördüğüm tablo bu — Individual ya da Business planında dönüyor. Enterprise tarafı hâlâ az. Copilot CLI’ı aktif kullanan geliştirici sayısı da, açık konuşayım, beklediğimden düşük; çoğu kişi VS Code ya da JetBrains entegrasyonuna yaslanıyor, CLI’a pek dokunmuyor.

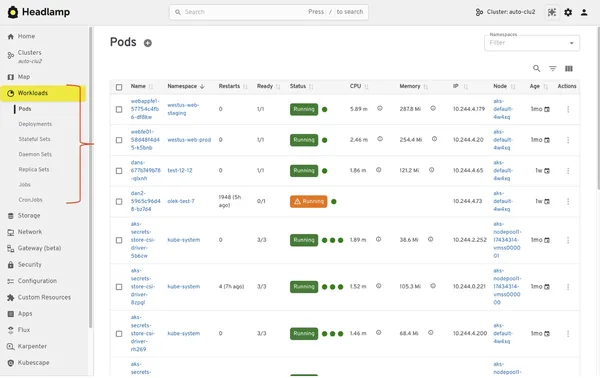

Ama CLI’ın asıl olayı başka: otomasyon. CI/CD pipeline’larınızda, script’lerinizde, cron job’larınızda Copilot CLI’ı çağırabiliyorsunuz. Mesela bir deployment script’ının ortasında “bu Kubernetes manifest’ını analiz et” diye sorabilirsiniz. Tam burada auto mod baya iş görüyor çünkü script’in içine “hangi model seçilsin” kararını gömmek istemezsiniz; Auto diyorsunuz, o an uygun olan model neyse o cevaplıyor. Basit gibi dürüyor. Değil aslında.

Kısa bir not düşeyim buraya. Bu konuyla ilgili MSVC 14.51 RC Çıktı: Derleyici Tarafında Neler Var? yazımıza da göz atmanızı tavsiye ederim.

Maliyet tarafına gelince… Copilot Business planı kişi başı aylık 19 dolar. TL bazında düşününce (Nisan 2026 kuruyla yaklaşık 720 TL civarı) bu, küçük ekipler için hafife alınacak bir kalem değil. 10 kişilik bir ekipte ayda 7.200 TL yapıyor. O yüzden premium request’leri verimli kullanmak Türkiye’deki ekipler için daha da kilit hâle geliyor. Auto modun sağladığı %10 indirim de fena değil; 45 kişilik bir ekipte ayda 4-5 request × 45 kişi = yaklaşık 200 request tasarruf demek. Mantıklı değil mi? Küçümsenecek rakam değil.

Startup mı Enterprise mı: Farklı Stratejiler

Küçük bir startup ekibiyseniz — hani 3-5 kişilik bir geliştirici kadronuz varsa — auto modu açıp geçebilirsiniz, kafa yormaya pek gerek yok. Zaten model seçimiyle oyalanacak vaktiniz olmaz, auto işinizi görür. Premium request kotanız da muhtemelen yeterli gelir.

Kısa bir not düşeyim buraya.

Ama enterprise seviyede, 100+ geliştirici olan bir organizasyonda iş biraz değişiyor. Orada admin politikaları devreye giriyor. Belki bazı modelleri güvenlik nedeniyle kısıtlamışsınızdır, olur böyle şeyler. Auto mod bu politikaları “respect ediyor” diyor GitHub — yanı admin’in yasakladığı bir modele yönlendirme yapmıyor. Güzel tarafı bu. Yine de enterprise müşterilerime şunu söylüyorum: önce küçük bir pilot grupla deneyin, auto’nun hangi modellere yönlendirdiğini izleyin, sonra genele açın. Yoksa sonradan uğraştırabilir.

Kontrolü Elden Bırakmak mı: Endişeler ve Gerçekler

Hmm, bir durayım. Bu konuda içime tam sinmeyen bir şey var aslında. Auto mod “dinamik” diye geçiyor, routing de zamanla değişebiliyor; peki bugün Haiku 4.5’e giden sorgu yarın başka bir modele kayarsa ne olacak? Cevap aynı kalır mı, pek sanmıyorum.

Size bir şey söyleyeyim, Az önce “fena değil” dedim ama burada küçük bir risk var, önü da kenara atmayalım (kendi tecrübem). Bilhassa deterministik sonuç beklediğiniz senaryolarda — mesela bir script çıktısını parse ediyorsanız ya da JSON formatına güveniyorsanız — model değişince çıktı biçimi de oynayabiliyor, hatta bazen ufak bir detay bütün akışı bozuyor. Bu konuda %100 emin değilim ama GitHub tarafında “routing tutarlılığı” diye sıkı bir garanti yok gibi dürüyor; yanı aynı promptu iki kere yolladığınızda farklı modellere düşmesi gayet mümkün. Bu konuyla ilgili .NET 11 Preview 3: Gelen Yenilikler ve Sahadan Notlar yazımıza da göz atmanızı tavsiye ederim.

Aslında, Neyse uzatmayayım: kritik pipeline’larda auto yerine doğrudan spesifik model seçmek daha mantıklı geliyor. Auto’yu daha çok interaktif kullanımda ve günlük geliştirme işlerinde bırakın; orada esneklik iş görüyor. Geçiş yapmak da zaten zor değil.

Bir de sahadan örnek vereyim; geçen ay Logosoft’ta bir bankacılık projesinde Copilot CLI’ı DevOps workflow’una entegre ediyorduk. Geliştiricilerden biri auto modu denedi, CLI çıktısında modelin Sonnet 4.6 olduğunu gördü; aynı sorguyu 10 dakika sonra tekrar gönderince bu kez GPT-5.3-Codex geldi. İkisini yan yana koyunca fark hissediliyordu: Sonnet daha dolu dolu anlatmıştı, Codex işe kod önerisini daha net vermişti. Hangisi daha iyi? Şeye bağlı biraz. Ama tutarsızlık bazı ekiplerin canını sıkabilir, bunu da açık konuşayım.

Pratik Kurulum ve Kullanım

Copilot CLI kuruluysa, auto moda geçmek baya kolay. Daha önce GitHub Copilot CLI Nedir ve Nasıl Kurulur: İlk Adımlar yazımda kurulum kısmını zaten didik didik anlatmıştım. Kurulum tamamsa, model seçimi de şöyle akıyor: Kubernetes Image Promoter Yeniden Yazıldı: Sessiz Devrim yazımızda bu konuya da değinmiştik.

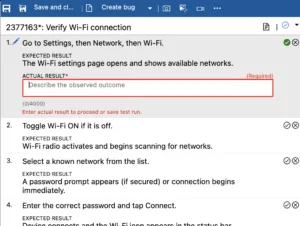

# Auto model seçimini aktif etmek için:

gh copilot config set model auto

# Mevcut model ayarınızı kontrol etmek için:

gh copilot config get model

# Spesifik bir modele geri dönmek için:

gh copilot config set model gpt-5.4

# Bir sorgu gönderip hangi modelin kullanıldığını görmek için:

gh copilot explain "kubectl get pods -n production --field-selector status.phase=Failed"

# Çıktıda kullanılan model bilgisi görünecekBu kadar. Cidden bu kadar. Ortada karmaşık bir konfigürasyon yok, ekstra bir kurulum da istemiyor. Ama bir nokta var, önü es geçmeyin — organizasyon seviyesinde admin’ınızın model politikalarını kontrol etmesi gerekiyor, çünkü bazı modeller disabled yapılmışsa auto onları zaten seçmiyor.

Ha bu arada, Copilot CLI Metrikleri Artık Birleşik: Ne Değişti? yazısında bahsettiğim birleşik metrik sistemi de auto mod ile birlikte daha anlamlı hâle geliyor. Artık hangi modelin ne kadar kullanıldığını, auto’nun ne sıklıkla hangi modele yönlendirdiğini tek panelden görebiliyorsunuz; güzel tarafı burada,. Dur bir saniye — işin izleme kısmı da baya toparlanmış oluyor.

Rakiplerle Karşılaştırma ve Büyük Resim

Bakın şimdi, bu “otomatik model routing” işi GitHub’a özgü değil. OpenAI’ın kendi API’sinde de benzer bir mekanizma var, Amazon CodeWhisperer tarafında da arka planda model seçimi yapılıyor ama kullanıcıya pek anlatılmıyor; GitHub’ın farkı işe biraz daha şeffaf davranması ve kullanılan modeli göstermesi (ciddiyim). Bir de politika uyumu var, hani kurumsal tarafta bazen asıl farkı zaten bu iki detay yaratıyor. Azure DevOps Server Nisan Yaması: Ne Geldi, Ne Yapmalı? yazımızda bu konuya da değinmiştik.

Bir dakika — bununla bitmedi. Daha fazla bilgi için Azure iPaaS’ta 8. Liderlik: Ne Anlama Geliyor? yazımıza bakabilirsiniz.

Dürüst olmak gerekirse, Bence doğru yönde bir adım. Ama dur bir saniye — hâlâ eksik kalan şey, kullanıcıya “neden bu model seçildi” bilgisinin verilmemesi. Sadece sonucu görüyorsunuz, yanı “GPT-5.4 seçildi” yazıyor ama neden Sonnet 4.6 değil de GPT-5.4? Rate limit mi etkiledi, sorgu tipi mi, plan mı devreye girdi? Bu bilgi olmayınca auto mod biraz kara kutu gibi kalıyor, açık konuşayım; belki ileride verbose bir mod gelir, kim bilir.

Bir de şunu gözlemliyorum: AI destekli geliştirme araçlarında “model agnostik” yaklaşım yavaş yavaş normalleşiyor. Eskiden “ben sadece GPT kullanırım” diyen geliştiriciler vardı, şimdi çoğu kişi “en iyi sonucu veren neyse önü kullanayım” kafasına geçti (kendi tecrübem). Auto seçimi de bunun doğal uzantısı işte. Yukarıda bahsettiğim o konu var ya, GitHub’ın Claude Opus 4.7 Copilot’a Geldi: İlk İzlenimler yazımda da değinmiştim; Copilot artık tek modelle yürüyen bir araç değil, baya çoklu model destekleyen bir platforma dönüyor. Hani ne farkı var diyorsunuz, değil mi? Auto mod da bunun mantıklı devamı.

Benim Tavsiyem

Eğer Copilot CLI kullanıyorsanız, ki kullanmıyorsanız da bir kurcalayın derim, auto modu varsayılan yapın. Günlük işte çoğu zaman fark etmiyorsunuz; arka planda uygun modeli seçiyor, bir de üstüne %10 indirim alıyorsunuz. Kritik otomasyonlarda işe işi şansa bırakmayın, spesifik modeli pin’leyin (yanlış duymadınız)

İlk iş olarak şunları yapın:

- Copilot CLI’ınızı güncelleyin (

gh extension upgrade gh-copilot) gh copilot config set model autoile auto modu açın- Birkaç gün normal kullanın, CLI çıktısında hangi modellerin seçildiğine bakın

- Eğer organizasyondaysanız, admin’inizle model politikalarını gözden geçirin

- Premium request kullanımınızı haftalık takip edin — auto ile gerçekten tasarruf ediyor musunuz, önü ölçün

Maalesef, bu özelliğin henüz VS Code ya da IDE entegrasyonlarında aynı şekilde çalışıp çalışmadığı net değil. Şimdilik CLI’a özel gibi dürüyor. Ama tahminim, o tarafa da benzer bir routing yakında gelir.

Sıkça Sorulan Sorular

Copilot CLI’da auto model seçimi ücretsiz mi?

İlginç olan şu ki, Auto özelliğinin kendisi için ekstra bir ücret ödemiyorsunuz,. Tüm Copilot planlarında kullanabiliyorsunuz. Ama premium request harcaması yine de seçilen modelin çarpanına göre işliyor. Aslında güzel bir farkı var: auto kullandığınızda %10 indirim geliyor otomatik olarak.

Auto mod admin politikalarını geçersiz kılabilir mi?

Hayır, kesinlikle kılamaz. Organizasyon admin’ının kapattığı modellere auto hiç yönlendirme yapmıyor. Admin kuralları çoğu zaman önce geliyor. Bence bu enterprise ortamlar için çok önemli bir detay — güvenle kullanabilirsiniz.

Auto modda hangi modelin kullanıldığını nasıl görebilirim?

Copilot CLI çıktısında direk görüyorsunuz hangi modelin kullanıldığını. Ayrıca bir şey yapmanıza gerek yok — sorgunuzun cevabıyla birlikte model adı da çıkıyor zaten. Baya pratik, açıkçası.

Auto ile spesifik model arasında ne zaman geçiş yapmalıyım?

Günlük interaktif kullanımda auto’yu tercih edin. Ama CI/CD pipeline’larında veya otomasyon script’lerinde, hani deterministik bir çıktı beklediğiniz durumlarda spesifik model belirlemeniz daha sağlıklı. Tecrübeme göre otomasyon tarafında belirsizlik istemiyorsunuz. Neyse ki geçiş tek komutla oluyor, karmaşık bir şey değil.

Auto mod gelecekte daha pahalı modellere de yönlendirir mi?

Şu an auto sadece 0x-1x çarpan aralığındaki modellere yönlendiriyor. GitHub ileride bunu değiştirebilir tabiî ama şimdilik bütçenizi beklenmedik şekilde eritme riski düşük görünüyor. Yine de bence premium request kullanımınızı ara ara takip etmekte fayda var.

Kaynaklar ve İleri Okuma

GitHub Blog: Copilot CLI Auto Model Selection Changelog

Peki, i̇lginç olan şu ki, GitHub Docs: Managing Copilot Policies in Your Organization

GitHub Docs: Using GitHub Copilot in the Command Line

Bu içerik işinize yaradı mı?

Benzer içerikleri kaçırmamak için beni sosyal medyada takip edin.

2 comments