AI Maliyet Optimizasyonu: ROI’yi Gerçekten Artırmanın Yolu

Şöyle söyleyeyim, Geçen ay bir finans kuruluşunda FinOps toplantısındaydım. CTO masaya bir grafik koydu — Azure OpenAI harcamaları son 4 ayda %340 artmış. O an oda bir tuhaf öldü. Herkes birbirine baktı. “AI kullanıyoruz, süper” dönemi bitti artık. Şimdi herkes aynı şeyi soruyor: “Peki bu harcamanın karşılığını alıyor muyuz?”

İnanın, Açık konuşayım, bu soru Türkiye’deki neredeyse her kurumsal müşterimde karşıma çıkıyor. Startup’ından holdingine kadar, fark etmiyor; tablo çoğu yerde benzer, biraz büyütülmüş hâliyle aynı hikâye dönüyor ve işin can sıkıcı tarafı şu: cevap çoğu zaman “bilmiyoruz” oluyor — itiraf edeyim, beklentimin üstündeydi —. İşte tam da bu yüzden AI maliyet iyileştirmeu, klasik bulut maliyet yönetiminden bambaşka bir hayvan (ciddiyim)

AI Maliyeti Neden Bu Kadar Farklı Bir Canavar?

Bakın şimdi, klasik bulut optimize etmeunu az çok biliyoruz. VM’i kapatırız, reserved instance alırız, storage tier’ı düşürürüz; tamam, konu büyük ölçüde kapanır. Ama AI tarafında iş öyle yürümüyor. Hiç yürümüyor.

Bir GPT-4o modeline attığınız her API çağrısı token bazlı faturalanıyor; kullanıcı prompt’u uzadıkça fatura da şişiyor, bu kadar net. Eğitim (training) çalıştırıyorsanız GPU saatleri hızla yukarı gidiyor. Fine-tuning yapıyorsanız compute var, storage var, data pipeline var (bir de bunların yan etkileri var). Inference tarafında işe throughput, latency. Concurrency dengesini tutturmak gerekiyor; yanı mesele sadece “bu ay ne kadar harcadık” değil — asıl soru şu: bu harcamanın hangi kısmı gerçekten iş değeri üretiyor?

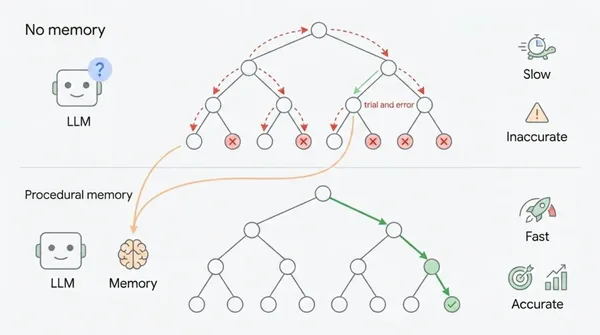

Şöyle ki, 2024 başında bir telekomda Copilot pilot projesi yürüttük. İlk ay herkes baya hevesliydi, kullanım da patladı. İkinci ay fatura geldi — beklentinin 2.5 katıydı. Neden? Çünkü kimse kullanım pattern’lerini önceden modellememişti; geliştiriciler deneme yanılma yapıyordu, bazıları aynı prompt’u 15 kere çalıştırıyordu, bazıları gereksiz yere büyük context window kullanıyordu, governance işe neredeyse yok gibiydi.

Şimdi gelelim işin can alıcı noktasına.

AI Maliyetini Şekillendiren 5 Ana Faktör

| Maliyet Faktörü | Klasik Bulut | AI İş Yükleri |

|---|---|---|

| Compute | Sabit/öngörülebilir | Token/inference bazlı, çok değişken |

| Fiyatlandırma | Saat/GB bazlı | Token, GPU saati, throughput unit karışımı |

| Ölçekleme | Autoscale kuralları net | Kullanıcı davranışına bağlı, tahmin zor |

| Optimizasyon | RI, Savings Plan, tier değişikliği | Model seçimi, prompt engineering, caching |

| Governance | Tag, budget alert yeterli | Kullanım politikası, rate limiting, chargeback şart |

Bu tabloyu bir müşterime gösterdiğimde “Biz henüz sol taraftayız” demişti. Maalesef çoğu kurum tam da orada dürüyor. AI harcamalarını klasik bulut bütçesinin içine gömüp ayrıştıramıyorlar bile.

ROI Hesabını Kafadan Yapmak Mümkün mü?

Bakın, Kısa cevap: Hayır. Uzun cevap biraz daha karışık, hatta yer yer can sıkıcı.

Tuhaf ama, AI ROI’si hesaplamak için önce şu soruyu netleştirmek lazım — AI tam olarak neyi çözüyor? Eğer bir chatbot müşteri hizmetleri yükünü %30 azaltıyorsa, tamam, burada iş kolay; tasarruf edilen insan-saat ile AI maliyetini yan yana koyarsınız. Somut. Ölçülebilir. Ama “çalışanlarımız daha verimli öldü” demek… hmm, dur bir saniye… bunu ölçmek öyle kafadan olacak iş değil. Verimlilik artışını nasıl ayıracaksınız? Copilot kullanan developer gerçekten %40 daha hızlı mı yazıyor, yoksa sadece daha çok kod mu üretiyor; işin aslı biraz orada düğümleniyor.

Bunu yaşayan biri olarak söyleyeyim, Logosoft’ta bir bankacılık müşterimiz için şöyle bir framework çıkardık:

- Doğrudan maliyet tasarrufu: AI’ın doğrudan azalttığı operasyonel giderler (insan-saat, manuel süreç maliyeti) (bu kritik)

- Gelir etkisi: AI sayesinde artan satış, cross-sell oranı, müşteri memnuniyeti (bu kritik)

- Risk azaltma: Fraud detection, anomaly detection gibi alanlarda önlenen kayıplar

- Hız kazanımı: Time-to-market kısalması, karar alma hızı

Bu dört boyutu ayrı ayrı ölçtüğünüzde, yatırımın gerçek karşılığı yavaş yavaş ortaya çıkıyor. Ama burada küçük bir pürüz var: her use case aynı hızda değer üretmiyor. Bir RAG tabanlı bilgi bankası iki haftada sonuç verebilir,. Özel bir fine-tuned model belki 6 ay sonra kendini amorti eder; yanı aynı sepete atınca kafa karışıyor.

Vallahi, Evet.

AI yatırımının ROI’sını tek bir metrikle ölçmeye çalışmak, bir restoranı sadece kira maliyetine bakarak değerlendirmek gibidir. Menüyü, müşteri deneyimini, lokasyonu, markayı — hepsini birlikte düşünmek gerekir.

Bilmem anlatabiliyor muyum, Neyse, çok dağıtmadan söyleyeyim: ROI hesabında en büyük hata tek rakama aşırı güvenmek oluyor. Bak şimdi, bazen proje kağıt üstünde düşük görünür ama risk azaltma tarafında baya iş görür; bazen de tam tersi olur ve ilk bakışta parlak duran senaryo içeride pek tutmaz. Sız ne dersiniz?

Açık konuşayım, ben bu tip hesaplarda önce “hangi metrik gerçekten paraya dönüyor?” diye başlarım. Sonra geri kalan kısmı temizlerim. Çünkü her fayda aynı değil; bazıları hemen kasaya yansır, bazıları işe sessizce gelir ve ancak birkaç ay sonra fark edilir.

Tam da öyle.

Türkiye’de AI Maliyet Yönetimi: Sahadan Gözlemler

Bakın, Şimdi işin Türkiye tarafına gelelim. Durum biraz karışık, hatta birkaç yerden aynı anda sıkıştırıyor.

Birincisi kur riski. Azure faturası dolar bazlı geliyor, TL ile bütçe yapan şirket için bu başlı başına bir muamma. 2024’te bir müşterimiz yıllık AI bütçesini iki milyon TL diye planlamıştı; sonra kur oynadı, kullanım da arttı, yıl sonunda rakam 3.4 milyon TL’ye çıktı. Mantıklı değil mi? Kimse sevinmedi.

İkincisi, FinOps kültürü burada hâlâ yeni sayılır. Büyük holdinglerde bile çoğu zaman dedicated FinOps ekibi yok, şey gibi düşünülüyor: Cloud Cost Management sanki IT’nın yan işiymiş gibi. Ama AI harcaması öyle durmuyor ki, haftalık takip yetmiyor bazen günlük bakmak gerekiyor.

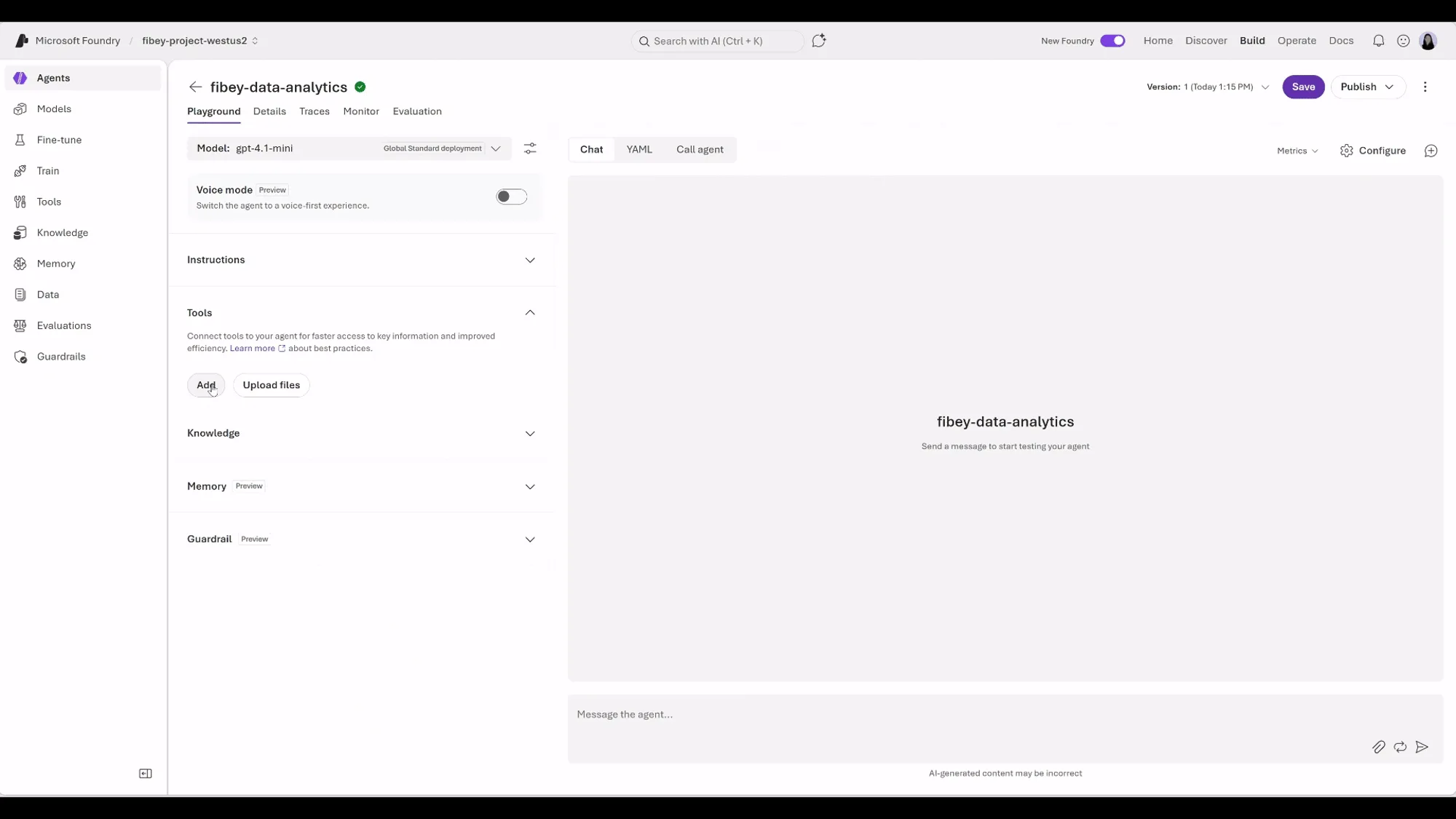

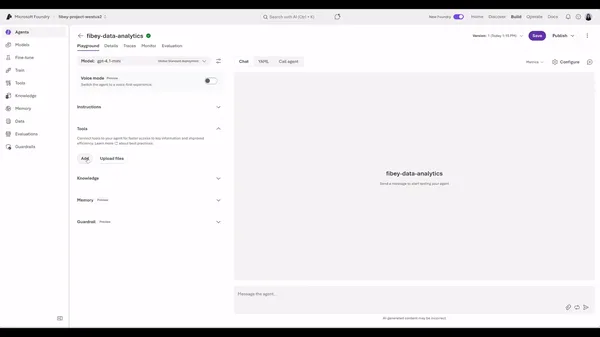

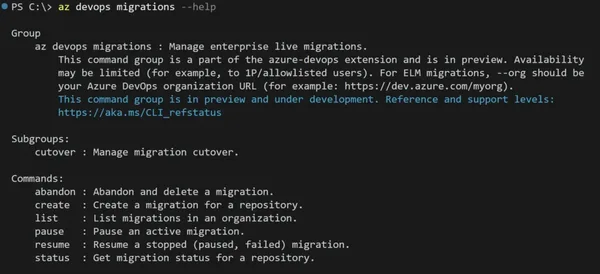

Bir de şu var — küçük ekipseniz. Bütçe de dar işe, Azure OpenAI yerine Foundry Local GA Öldü: Bulut Olmadan Yerel AI yazımda anlattığım gibi yerel model çalıştırmayı düşünebilirsiniz. Her şeyi bulutta çözmek zorunda değilsiniz. Hele bir de development ve test ortamlarında local inference baya iş görüyor, açık konuşayım.

Evet.

Enterprise vs Startup: Farklı Stratejiler

Büyük kurumsal taraftaysanız Azure’un Provisioned Throughput Units (PTU) modeli size fena olmayan bir tasarruf sağlayabiliyor. Sabit bir throughput kapasitesi alıyorsunuz, token bazlı ödeme yerine daha öngörülebilir bir maliyet görüyorsunuz; ama işte burada kritik nokta şu: kullanım hacmi yeterli olacak. Çok zıplamayacak. Düşük hacimde PTU almak para yakmaya dönüyor, lafı gevelemeden söyleyeyim (buna dikkat edin)

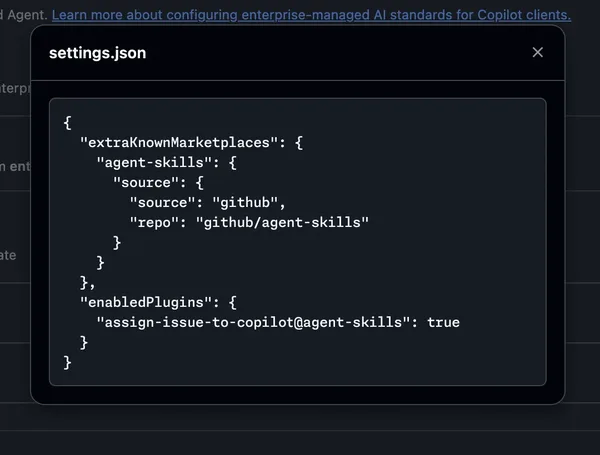

Startup ya da küçük ekip olarak başlıyorsanız pay-as-you-go modelde kalın. Rate limiting koyun, budget alert’ler tanımlayın ve — bunu özellikle söylüyorum — prompt caching mekanizmasını kullanın. Aynı ya da benzer prompt’larda cache hit oranınız yükselirse token maliyeti ciddi biçimde aşağı iniyor.

İnanın, Bak şimdi, burada küçük ama etkili bir detay var: bazen insanlar modeli ucuzlatmaya uğraşıyor, ama asıl kazanç israfı kesince geliyor.

AI Yaşam Döngüsü Boyunca Maliyet Kontrolü

AI projelerinde maliyeti tek bir yerde tutup “tamamdır” diyemezsiniz (en azından benim deneyimim böyle). İş orada bitmiyor. Yaşam döngüsünün her aşamasında ayrı bir kaçak çıkıyor, ayrı bir tasarruf kapısı da açılıyor; yanı mesele sadece fatura değil, hangi noktada neyi seçtiğiniz de baya belirleyici oluyor. Bunu 3 ana aşamada düşünmek lazım (bizzat test ettim)

1. Tasarım ve Prototipleme

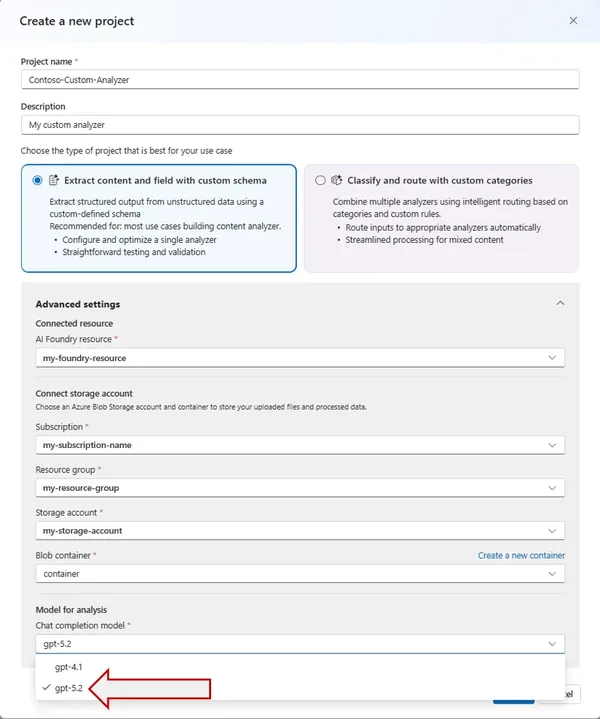

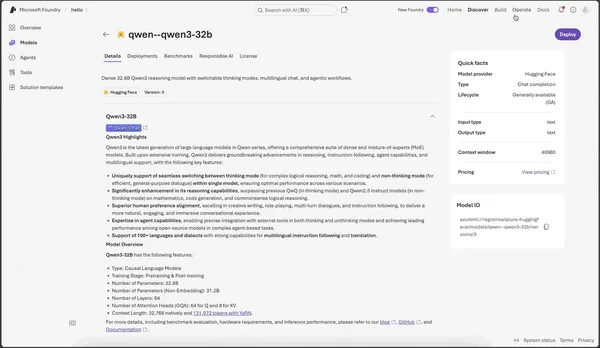

Burası çoğu hatanın yapıldığı yer. Herkes en sağlam modelle başlamak istiyor — GPT-4o, Claude Opus falan. Dur bir saniye. Gerçekten o modele ihtiyacınız var mı? Belki GPT-4o mini veya hatta GPT-3.5 Turbo işinizi görür; geçen hafta bir müşteride basit bir sınıflandırma görevi için GPT-4o kullanıyorlardı, modeli GPT-4o mini’ye düşürdük, doğruluk oranı %2 düştü ama maliyet %80 azaldı, açık konuşayım bu use case için o fark gayet kabul edilebilirdi. Bulut Maliyet Optimizasyonu: Hâlâ Geçerli Prensipler yazımızda bu konuya da değinmiştik.

Şöyle söyleyeyim, Az önce “en dayanıklı modeli seçin” gibi bir şey ıma ettim. Aslında tam tersi doğru — en küçük yeterli modeli seçin. Bu prensip altın değerinde değil, daha çok sessiz sedasız para kurtarıyor; hani ilk bakışta heyecan vermiyor. Ay sonunda tabloyu görünce insanın fikri değişiyor.

2. Geliştirme ve Test

Development ortamında production seviyesinde kaynak ayırmayın. Bunu söylemek kolay, uygulamak zor. Çünkü geliştiriciler “ama test sonuçları farklı çıkar” diyor; haklılar, fakat dev ortamında A/B test yapmıyorsunuz ki, burada iş biraz daha sade ilerliyor ve mock response’lar, cached response’lar ile küçük model deployment’ları baya iş görüyor.

Peki neden?

Ha bu arada, Bulut Maliyet Optimizasyonu: Hâlâ Geçerli Prensipler yazımda anlattığım genel bulut iyileştirme prensipleri AI ortamları için de geçerli. Tag’leme, resource group izolasyonu, budget policy’ler — bunlar AI workload’ları için de olmazsa olmaz gibi dürüyor. Asıl mesele disiplin; şey yanı, etiket koyup geçmek yetmiyor, düzeni de korumanız gerekiyor.

3. Production ve Ölçekleme

Production’a geçtikten sonra asıl iş başlıyor. Monitöring şart. Azure Cost Management + Billing üzerinden AI servislerini ayrı bir scope’ta izleyin; token consumption dashboard’u oluşturun çünkü hangi departman ne kadar tüketiyor, hangi endpoint en çok çağrılıyor bunları bilmeden optimize etme yapamazsınız.

Kısa bir not düşeyim buraya. Bu konuyla ilgili SQL MCP Server: Veritabanını Ajanlara Açmanın Yolu yazımıza da göz atmanızı tavsiye ederim.

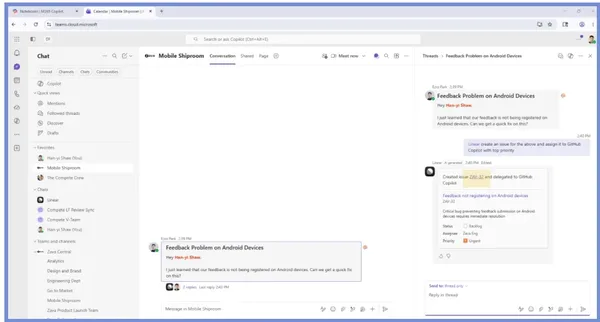

Bir de şunu söyleyeyim — production’da model versiyonu takibi kritik. OpenAI sürekli yeni versiyon çıkarıyor. Bazen yeni versiyon hem daha hızlı hem daha ucuz oluyor; bazen de beklentiniz kadar parlak çıkmıyor, evet öyle durum da var ama sız eski versiyonda takılı kalıyorsanız hem performans hem maliyet kaybediyorsunuz. Foundry Fine-Tuning Nisan Güncellemesi: RFT Artık Ucuz yazımda bu konuya değinmiştim — model güncellemeleri ciddi maliyet fırsatları sunuyor. Foundry Agent’a MCP ile Özel Araç Bağlamak yazımızda bu konuya da değinmiştik.

Microsoft’un Sunduğu Araçlar: İşe Yarıyor mu?

Açık konuşayım, Microsoft bu tarafa bayağı yatırım yapıyor. Peki, azure Cost Management var, Azure Advisor var, bir de yeni gelen AI odaklı öneriler çıkmış; fena değil aslında. Ama yetiyor mu? Hmm.

Azure Advisor’ın AI workload önerileri henüz biraz ham dürüyor. “Kullanılmayan deployment’ları silin” diyor, tamam güzel, ama bunu zaten çoğu ekip biliyor. Bana asıl şunu söylesin: “Bu model yerine şu modeli kullanırsan %35 tasarruf edersin, doğruluk kaybın da %1.2 olur.” Henüz o noktada değil, açıkçası. Yine de yön doğruya dönmüş, sadece tempo biraz ağır gidiyor. Bu konuyla ilgili Kubernetes AI Gateway WG: AI Trafiği Artık Standart yazımıza da göz atmanızı tavsiye ederim.

Microsoft Cost Optimization workbook’u ve Well-Architected Framework’ün AI lens’i işe daha işe yarar geliyor. Mesela kurumsal müşterilerde WAF AI assessment’ı iyi bir başlangıç noktası oluyor; hani ilk bakışta çok süslü görünmüyor. Işi toparlıyor. Biz Logosoft’ta birkaç müşteride bu assessment’ı uyguladık. Her birinde en az %15-20 maliyet azaltma fırsatı gördük, bazen beklediğimizden daha net çıktı sonuçlar.

Pratik Adımlar: Yarın Sabah Ne Yapmalısınız?

Lafı çok uzattım, şimdi somut işlere geçelim. Eğer AI harcamalarını biraz olsun dizginlemek istiyorsanız, yarın sabah ilk iş olarak şunlara bakın; çünkü işin aslı, bütçe kaçıran şey çoğu zaman model değil, kontrolsüz kullanım oluyor.

- AI harcamalarını ayrıştırın: Genel bulut bütçesinin içine gömmeyin. Ayrı resource group açın, ayrı tag kullanın, raporu da ayrı tutun; yoksa ay sonunda nereden patladığını anlamak zorlaşıyor. (bu kritik)

- Model-maliyet matrisi oluşturun: Her use case için hangi modeli kullandığınızı yazın, token maliyetini yanına koyun, bir de alternatif model ne olurdu diye ekleyin. Basit bir tablo gibi dürüyor ama insan bazen tam burada şaşırıyor.

- Rate limiting ve quota yönetimi kurun: Her departman ya da proje için token kotası belirleyin. Sınırsız kullanım var sanıyorsanız, fatura tarafı da sınırsız geliyor; hoş değil. (bence en önemlisi)

- Haftalık maliyet review toplantısı başlatın: Evet, haftalık. Aylık bakınca bazı dalgalanmalar gözden kaçıyor, çünkü AI maliyetleri bazen sessizce yükseliyor ve sonra bir bakmışsınız rakamlar hop diye yukarı çıkmış.

- Prompt engineering eğitimi verin: Kullanıcılara verimli prompt yazmayı öğretin. Kısa, net ve structured prompt’lar hem daha iyi sonuç veriyor hem de daha az token yakıyor; yanı iki tarafta da nefes aldırıyor.

Bu 5 adımı uygulayan müşterilerde ortalama %25-30 maliyet düşüşü gördüm. Abartmıyorum. Hatta bazen sorun teknoloji bile olmuyor; mesele doğrudan governance eksikliği çıkıyor, yanı kim neyi ne kadar kullandı sorusunun cevabı havada kalınca faturayı toparlamak da zorlaşıyor.

Evet.

Son Söz: AI Yatırımı Bir Maraton

Hani, AI maliyet iyileştirmeu tek seferlik bir iş değil. Sürekli dönen bir çark gibi, durmuyor; model fiyatları oynuyor, yeni modeller geliyor, kullanım şekilleri değişiyor, iş tarafı da başka yere kayıyor (doğal olarak), yanı bugün kurduğunuz yapı üç ay sonra yeniden bakılmak istiyor (buna dikkat edin). Kısacası, iş bitmiyor.

Bence burada en sık yapılan hata şu: AI maliyetini sadece IT’nın sırtına bırakmak. Pek öyle yürümüyor. Bu bir iş kararı, hem de öyle kenardan bakılıp geçilecek türden değil; CFO, CTO ve iş birimi yöneticileri aynı masaya oturmalı, çünkü FinOps yaklaşımını AI’a taşımadan bu iş biraz havada kalıyor, hatta AI için ayrı bir FinOps çerçevesi düşünmek daha mantıklı dürüyor.

AZ-305 sınavına hazırlanırken maliyet iyileştirmeu sorularına bakıp “hmm, fena değil ama biraz yüzeyde kalmış” dediğimi hatırlıyorum. Sonra AI workload’ları devreye girince tablo değişti; mevzu bir anda genişledi, çünkü artık sadece altyapı değil, model seçimi, çağrı sayısı, token tüketimi ve kullanım davranışı da masaya geliyor. Sertifika dünyası bunu henüz tam yakalamış olmayabilir ama sektör boş durmuyor (buna dikkat edin)

Neyse, çok dağıtmayayım. Eğer bu konuda yardıma ihtiyacınız varsa ya da kendi deneyiminizi paylaşmak isterseniz, blog üzerinden bana ulaşabilirsiniz. Bu alanı herkes adım adım öğreniyor; ben de dahil. Evet.

Sıkça Sorulan Sorular

AI maliyet optimize etmeu ile klasik bulut maliyet iyileştirmeu arasındaki fark ne?

Klasik bulut iyileştirmeunda compute, storage, network gibi sabit kaynakları yönetiyorsunuz. AI tarafında işe iş çok daha karmaşık — hani token tüketimi, model seçimi, inference sıklığı, training döngüleri derken maliyet faktörleri sürekli değişiyor. Aslında bu yüzden AI optimizasyonu bambaşka araçlar, metrikler ve governance yaklaşımı gerektiriyor.

Azure OpenAI’da maliyeti en hızlı nasıl düşürebilirim?

Bence en hızlı etkiyi model seçiminden alıyorsunuz. Her şey için en güçlü modeli kullanmak yerine, yeterli performansı veren en küçük modeli tercih edin. Mesela GPT-4o yerine GPT-4o mini’ye geçmek çoğu senaryoda %60-80 arası maliyet düşüşü sağlıyor — açıkçası bu rakam şaşırtıcı. Neden önemli bu? Sonraki adım olarak da prompt caching’i aktifleştirin.

AI ROI’sını nasıl ölçeyim?

Tek bir metrikle ölçmeye çalışmayın. Tecrübeme göre en sağlıklı yöntem şu: doğrudan maliyet tasarrufu, gelir etkisi, risk azaltma. Hız kazanımı olmak üzere 4 boyutta değerlendirmek. Her AI use case’i için bu 4 boyutta somut KPI’lar tanımlayın, yanı soyut hedefler koymayın. En az çeyreklik bazda da takip edin.

Küçük bütçeli bir ekibiz, AI maliyetlerini nasıl kontrol altında tutarız?

Pay-as-you-go modelde kalın. Rate limiting ve token kotası uygulayın. Mümkünse development ortamında yerel model çalıştırın — hani Foundry Local gibi seçenekler burada işe yarıyor. Bir de budget alert’leri agresif ayarlayın; bütçenin %50’sine ulaşınca bile uyarı gelsin, böylece müdahale için zamanınız olur.

Ve işler burada ilginçleşiyor.

PTU (Provisioned Throughput Units) ne zaman mantıklı oluyor?

Eh, Stabil ve yüksek hacimli production workload’larınız varsa PTU düşünmeye değer. Yanı genel kural şu: aylık token tüketiminiz belirli bir eşiğin üzerindeyse. Kullanım düzeniniz öngörülebiliyorsa PTU modeli pay-as-you-go’dan daha ekonomik çıkıyor. Ama düşük ya da dalgalı hacimde PTU almak açıkçası para kaybettiriyor — bence bu konuda aceleci davranmamak lazım.

Kaynaklar ve İleri Okuma

Cloud Cost Optimization: How to maximize ROI from AI — Microsoft Azure Blog

Azure Cost Management and Billing — Microsoft Learn

Küçük bir detay: Azure Well-Architected Framework: Cost Optimization Pillar

Bu içerik işinize yaradı mı?

Benzer içerikleri kaçırmamak için beni sosyal medyada takip edin.

4 comments