Microsoft Fabric ve SQLCon 2026: Gerçekten Tek Platformda Tüm Verinin Peşinde

Konferanslarda Dalgalanan Duygular: FabCon 2026 & SQLCon Notlarım

İyi, lafı dolandırmadan giriyorum olaya: Atlanta’da bu seneki FabCon ve yepyeni SQLCon, kuru bir duyuru olmaktan çok öteye geçti. Hani öyle sıradan bir etkinlik deyip geçemezsiniz… Baktığınızda sekiz bin kişiyle salon cidden balık istifi öldü; ama bana sorarsanız olay sadece kalabalık değil. Esas bomba ne derseniz — veriyi tek yerde toplama hayali lafta kalmaktan çıkıyor gibi! Microsoft Fabric’in o “her derde deva” veri platformu günlerdir masada konuşuluyordu da, pratikte iş hep yama sistemiyle dönüyordu. Şimdi işe tablo biraz değişiyor sanki.

Şahsen, Geçen yılın sonunda Logosoft’ta bankacılık sektöründeki kurumsal göç projesinde başımıza geleni anlatayım… O kadar farklı kaynaktan veri geliyor ki aklımız karıştı resmen: hem on-prem SQL Server’lar, hem bulutta Cosmos DB’ler, aralara sıkıştırılmış envai çeşit analiz uygulaması… İşin içinden çıkamıyorsun yanı. Microsoft’un bu karmaşayı adam etmek için attığı adımlar baya radikal geldi bana (evet, doğru duydunuz)

Veri platformları yıllardır ya operasyonu es geçti ya analitiği ihmal etti; ikisini birleştirmeyi dişe dokunur biçimde başarabilene ilk kez şahit oluyorum.

– Sen Aşkın KILIÇ

Söz tamam da asıl kritik olan şu soru kafamı kurcaladı hep — peki ekosistemi kökünden nasıl değiştirir? Yıllardır sahadayım; yeni teknoloji gösterişli olmak zorunda değil benim için, elle tutulur çözüm üretsin yeterli.

Peki Database Hub Gerçekten “Tek Kapıdan Her Veri Kaynağı” mı?

Bir-iki sene önce ortam tam şenlikti aslında… Her şirketin veri varlığı karmakarışık olurdu (hani şu meşhur data estate muhabbeti). Orada Azure SQL takılıyordu, kenarda PostgreSQL kurulmuştu (arada Mongo bile görürdüm), üstüne blob deposunu yapıştır… Hepsi ayrı telden çalıyordu! Şimdi Database Hub devreye girdiğinde neler oluyor dersiniz? Fabric portalının sade görünüşüne kanmayın — ilişkisel veya NoSQL diyorsan ne varsa buradan görebiliyorsun artık. Bir tür AVM gibi düşün… Ne istersen elinin altında!

İşin garibi, Bizzat Mart ayında büyükçe bir perakende firmasında PoC sunumu yaptığımda faydasını hissettim diyebilirim. Farklı kaynaklara iki-üç hamlede bağlandık izledik derken süreç inanılmaz rahatladı. Tabiî burada her şey güllük gülistanlık demek isterdim ama yok (ki bu çoğu kişinin gözünden kaçıyor). Bazı eski sistemlere denk gelince garip sürpriz hatalar fırlıyor ortaya.

Tamam, Dağınıklığa Güle Güle Diyebilecek mıyız?

Kendimizi kandırmayalım hemen! Hayat toz pembe değil. Esas mesele burada başlıyor bence – farklı lokasyonlardaki kocaman verileri tek panelden izlemek kulağa şahane gelirken küçük tefek aksilikler can sıkabiliyor.

- Kısıtlı API desteği: Mesela eski MySQL versiyonlarında anlık izleme pek oturmamış hâlâ.

- Karmaşık rol yönetimi: RBAC dağıtımı denilen olay hâlâ epey manuel uğraştırıyor.

- Konsolide backup/restore süreçleri: Bu alanda yapılacak işler daha bitmedi açıkçası.

Microsoft Fabric’in “tek platform” vaadi, özellikle Database Hub ile veri kaynaklarını tek panelde toplama fikri üzerinden değerlendiriliyor; hibrit senaryolarda hız kazandırırken bazı beta kısıtları öne çıkıyor.

| Özellik | Beklenti / Vaad | Gerçekleşen Durum |

|---|---|---|

| Tek platform yaklaşımı | Veriyi tek yerde birleştirme | Fabric portalında ilişkisel ve NoSQL kaynaklar görünür |

| Database Hub (veri erişimi) | “Tek kapıdan her veri kaynağı” | Hibrit/çoklu bulutta PoC’lerde süreç hızlanıyor (beta) |

| Bağlantı ve uç senaryolar | Her kaynağa sorunsuz erişim | Uç durumlarda bağlantılar tıkanabiliyor |

| Operasyonel uyum | Eski sistemlerle sorunsuz entegrasyon | Eski sistemlerde sürpriz hatalar ve kısıtlar görülebiliyor |

Not: En büyük değer, karmaşık data estate’i tek panelde yönetmeye çalışırken hibrit senaryolarda zaman kazandırması; ancak beta/entegrasyon kısıtları göz önünde tutulmalı.

A’dan Z’ye AI’ya Uygun Temiz Veri Katmanı Konusu

Dönüp kendi kendine soruyor insan — “Bu AI işleri için önce düzgün data var mı elimizde?” Vallahi yoksa hiç bulaşmayın! LLM mucizesi filan bekliyorsanız öncelikle doğru düzgün normalize edilmiş ham veri lazım size; Fabric’in de temel iddiası bu noktada kendini belli ediyor zaten… Sadece depolamak yetmez dedim defalarca; mevzuya anlam yükleyebiliyorsan kazanırsın!

Bitti mi? Power BI ile Fabric IQ Kombosu Var Daha!

Bence, Meseleyi şöyle hayal edin — departmanlardan gelen onlarca tabloyu hop diye Power BI’a taşıyorsunuz sonra da Fabric IQ ile tüm sayısal ilişkiler otomatik olarak semantik modele dönüşüyor… Buradaki AI katmanı bence en ilginç kırılım öldü doğrusu!

- Anlamlandırma: Sayıları göstermek kolay da onları açıklayan şeyi sistem anlıyor resmen!

- Sorgu hızlandırma: Canlı analizlerde ciddi performans artışı gördüğümü söylemeden geçmem (DP-203’e hazırlanırken test ortamında net fark ettim).

- Tahmin modelleri entegrasyonu: Eskiden tahmine dayalı işler saatler sürerdi şimdi kod miktarı üçte bire indi desem abartmış olmam.

Gerçekten bazen düşünüyorum… Bir zamanlar Power BI’ın amacı sadece grafik çizmekti diye hafifçe tebessüm ediyorum!

Büyük Konsolidasyon Hikâyesi — OneLake Bize Ne Vaat Ediyor?

Eminim birkaç okuyucu huzursuzlanmaya başladı bile – “İyi hoş diyorsun ama nedir bu OneLake?” Basitleştirerek yazıyorum; çoğu şirkette on tane ayrı data lake görürsün ve hepsi başka havadan çalar (işletmesi apayrı derdi tabiî). OneLake dediğin hepsini ortak platformda toparlama niyetinde – hani şu ‘bir taşla kuş sürüsü vurmak’ mantığıyla geliyor diyebilirim. .NET MAUI Geliştirme Sürecinde Yapay Zekâ Ajanlarıyla Hız Artışı: Gerçekten Fark Yaratıyor mu? yazımızda da bu konuya değinmiştik. .NET ve OpenAI ile Gerçek Zamanlı Sesli Çoklu Ajan: RT.Assistant’a Dair Sahici Notlar yazımızda da bu konuya değinmiştik.

Ama biraz beklemekte yarar var çünkü bazı çocuk hastalıkları devam ediyor – geçen hafta örneğin canlı query’lerden biri transferde timeout attı, düzelttiler mi dersen henüz ses yok ama yol haritasına almışlar diyor ekip…

Sahadaki Gerçek Hikâye Nasıl?

Nisan ayındaki holding migration çalışmamız aklıma geldi bak şimdi… SAP BW’den eski verileri OneLake’e atarken neredeyse boğulduk iş yoğunluğundan! Ama işlemler hallolunca geriye kalan dashboard’u hazırlamak sudan ucuz hâle geldi — orası kesin! Demek istediğim acısını çekiyorsunuz evet fakat finalde ödülünü almak güzelmiş (en azından benim deneyimim böyle)

Misyon Kritik Uygulamalara Yeni Geliştirici Alanları Açılıyor mu?

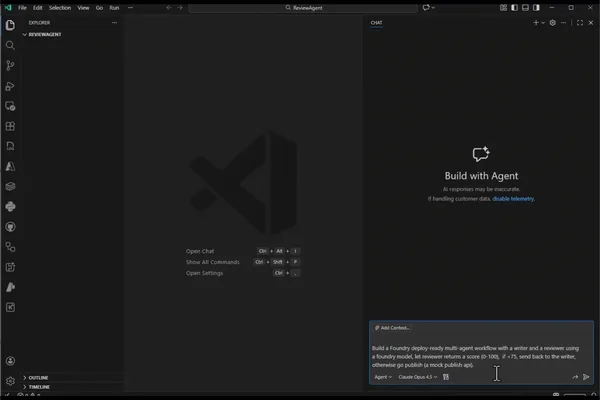

Dürüst olacağım yine… Geçmişte kritik projelerde sürekli araç değiştirmekten koddan nefret edecek hâle geliyorduk! Sonradan Fabric üstünde API bazlı geliştirme işi gözle görülür şekilde hızlandı ve CI/CD adaptasyonu cidden zamandan tasarruf sağladı (Microsoft Foundry’de Azure DevOps Remote MCP Server’a göz atabilirsiniz, tam bu konuyu yaşadım) (yanlış duymadınız)

- C# veya Python ile hızlı prototiplemek mümkünleşti – hackathon maratonlarında epey işe yaradığını gördüm,

- Migrasyon otomasyon araçlarının çoğalması sayesinde eskisi kadar endişe duymuyorum,

- Zorlu validasyon kontrollerinde işe insan eli gerekiyor hâlâ – burada Copilot’tan beklentim yüksek!

Denge Nerede? Ekşi Taraflara Samimi Bakış…

Açık konuşmak gerekirse yüksek beklenti genelde minik düş kırıklıkları doğuruyor maalesef! Örneğin fabric ekibinin dilinden düşmeyen entegre güvenlik mekanizmaları teoride ballandıra ballandıra anlatılıyor fakat pratikte legacy yapılarla karşılaşınca tutukluk yapıyor bazen.

- Bazı connector’ların hâlâ public preview’da olması yüzünden stabilite konusunda oynaklık yaşadığımız öldü,

- SAP veya Oracle tarzındaki dış kaynaklarla bağlantıda fire veren örneklerle karşılaşıldı,

- Kritik migration sırasında batch limiti aşınca belki beş dakikan gidiyor ve yeterince rehber/döküman yok ortalarda!

Her özelliği tek potada eritme fikri cazip olabilir—ama fazla aceleciliğe kapılırsak kalite ayağa dolanmaya başlıyor…

Nihayet Final Yorumu & Pratik Tavsiyeler — Pembe Hayallere Kapılır mıyız?

- Tavsiyelerim şunlar olurdu:

- Büyük sisteme direk dalmak yerine mini PoC’lerle başlayın,

- Migrasyona girişmeden evvel mapping tablolarınızı mutlaka çıkarın,

- Sistem güncellemeleri gelsin diye boşuna beklemeyin—geri bildirimlerinizi gönderin çünkü dikkate alan ekip gerçekten mevcut,

- Kodcular kadar iş kullanıcılarını sürecin içine alın derim zira son dakika koşuşturması böylece azalıyor,

- Daha bugünden Copilot agent yatırımı yapmak iyi fikir—yakında data-driven bot’suz iş olmaz olacak (ilgili yazıda detayı var merak edenlere bırakıyorum))

Kaynak:

FabCon and SQLCon 2026: Unifying databases and Fabric on a single data platform.

Sıkça Sorulan Sorular

Microsoft Fabric “tek platformda tüm veri” iddiasını pratikte nasıl karşılıyor?

Fabric’in vaadi, farklı kaynaklardan veriyi tek bir çatı altında toplamak ve hem analitik hem de veri işleme tarafında işleri kolaylaştırmak. Ama pratikte her şey sihirli şekilde otomatik olmuyor; entegrasyonun kalitesi ve kaynakların uyumluluğu çok belirleyici. Benim gördüğüm en büyük fark, doğru kurguyla yama mantığını azaltıp süreci daha yönetilebilir hâle getirmesi.

Database Hub gerçekten “tek kapıdan her veri kaynağı” mı, yoksa sınırlamaları var mı?

Database Hub konsepti gerçekten “tek panelden erişim” fikrini güçlendiriyor; ilişkisel ve NoSQL kaynakları görüntülemek daha merkezî hâle geliyor. Ancak yazıda da geçtiği gibi beta aşamasında bazı eksikler olabiliyor; özellikle uç senaryolarda bağlantılar tıkanabiliyor. Mart ayında yaptığım PoC’de hibrit kaynaklarda hız kazandırdığını net hissettim ama bazı eski sistemlerde beklenmedik sürpriz hatalar çıkabiliyor.

SQLCon 2026 gibi etkinlikler Microsoft Fabric tarafındaki teknik değişimi ne kadar yansıtıyor?

SQLCon ve benzeri etkinlikler, “duyuru”dan çok gerçek kullanım senaryolarını ve yaklaşım değişimini öne çıkarıyor. Fabric’in veri tarafında birleştirici rolü daha somut konuşulmaya başlıyor; bu da mimarı kararları etkiliyor. Yanı konuşulan şeyler genelde ürünün nereye evrildiğini gösteriyor.

Fabric’te hibrit veya çoklu bulut senaryolarında en çok hangi konular can sıkabiliyor?

En sık karşılaşılan başlıklar kısıtlı API desteği ve karmaşık rol/erişim yönetimi gibi durumlar oluyor. Farklı lokasyonlardaki büyük veri setlerini tek panelden görmek çok cazip ama küçük uyumsuzluklar süreçte gecikme yaratabiliyor. Bu yüzden ilk kurulumda kaynak uyumluluğunu ve güvenlik/RBAC gereksinimlerini baştan netleştirmek önemli.

Kaynaklar ve İleri Okuma

Microsoft Fabric Resmî Dokümantasyonu

Microsoft Fabric Duyurusu – Azure Blog

Database Hub Hakkında Bilgilendirme

Microsoft Fabric Örnekleri – GitHub

Bu içerik işinize yaradı mı?

Benzer içerikleri kaçırmamak için beni sosyal medyada takip edin.

Yorum gönder