Foundry Local 1.1: Mikrofondan Canlı Transkripsiyon Geldi

Bulutsuz AI meselesi son bir yılda gündemden hiç düşmedi. Veri egemenliği, gecikme, token başına faturalar… derken Microsoft, Foundry Local’in 1.1 sürümünü sessiz sedasız yayınladı. Ben de hafta sonu kurcalayınca fark ettim ki — bu sürüm aslında göründüğünden çok daha önemli.

İlginç olan şu ki, Açık konuşayım: 1.0 çıktığında biraz mesafeli yaklaşmıştım. “Lokalde model çalıştırmak güzel de, gerçek senaryolarda nereye oturacak?” diye düşünüyordum. Cevap 1.1 ile gelmiş gibi dürüyor. Üç kilit özellik eklenmiş: canlı transkripsiyon, embeddings ve Responses API. Üçü de pratikte işimize yarayan şeyler. Hani sırf “biz de yaptık” demek için eklenmiş feature’lar değil.

Şimdi gelelim detaylara — ama önce bir parantez açayım.

Foundry Local Aslında Ne İşe Yarıyor?

Kısaca söyleyeyim: Microsoft’un cross-platform yerel AI çözümü bu. Yanı modeli kullanıcının makinesinde, sizin sunucunuzda, edge cihazda — kısacası epey farklı yerde koşturabiliyorsunuz. Bulut bağımlılığı yok, ağ gecikmesi yok, token başına ücret yok; kulağa rahat geliyor, çünkü gerçekten öyle bir tarafı var.

Kulağa süper geliyor değil mi? Geliyor tabiî. Ama gerçek hayatta birkaç pürüz var, onlara da geleceğim; önce yeniliklere bakalım, sonra işin can sıkıcı tarafını da masaya koyarız.

“Foundry Local 1.1, lokalde AI çalıştırmayı ‘demo’ olmaktan çıkarıp ‘production’ senaryolarına yaklaştıran ilk sürüm. Hâlâ eksikler var ama yön doğru.”

Canlı Transkripsiyon API’si: En Heyecan Verici Kısım

Garip gelecek ama, Bu özelliği görünce ilk aklıma gelen şey, geçen yıl bir sigorta şirketinde yaptığımız çağrı merkezî projesi öldü. Müşteri real-time transkripsiyon istiyordu ama veriler dışarı çıkamıyordu; regülasyon yüzünden ipler biraz sıkıydı açıkçası. Biz de Azure Speech yerine on-premise bir yol ararken epey uğraşmıştık.

Eh, Şimdi Foundry Local ile aynı işi neredeyse out-of-the-box yapabiliyorsunuz. Mikrofondan ham PCM ses verisi gönderiyorsunuz, transkripsiyon sonuçları stream olarak geliyor; üstüne bir de is_final markerları var — yanı interim sonuçlarla finalize edilmiş sonuçları ayırabiliyorsunuz. Bu küçük detay var ya, UX tarafında baya iş görüyor.

Session-Based Pattern Nasıl Çalışıyor?

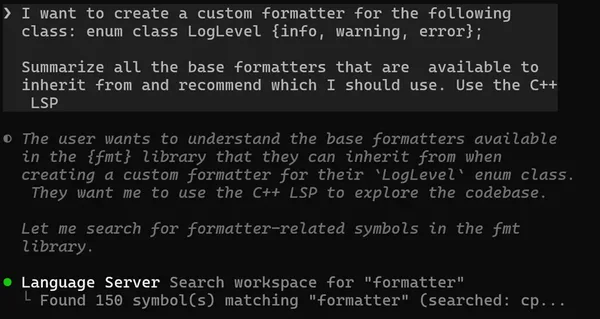

API tasarımı temiz sayılır. Akış kabaca şöyle gidiyor: katalogdan bir streaming speech modeli seçiyorsunuz (mesela nemotron-speech-streaming-en-0.6b), sonra sample rate. Kanal sayısı gibi ayarlarla live transcription session açıyorsunuz; ardından session’ı başlatıp ses verisini yolluyor ve async stream üzerinden sonucu topluyorsunuz.

- Katalogdan bir streaming speech modeli yüklüyorsunuz (örneğin nemotron-speech-streaming-en-0.6b)

- Bir live transcription session oluşturuyorsunuz — sample rate, kanal sayısı, dil gibi ayarlarla

- Session’ı başlatıp ses verisi göndermeye başlıyorsunuz

- Async stream üzerinden sonuçları tüketiyorsunuz

Python tarafından bakınca kod şöyle bir şey:

import threading

import pyaudio

from foundry_local_sdk import Configuration, FoundryLocalManager

config = Configuration(app_name="meeting_transcriber")

FoundryLocalManager.initialize(config)

manager = FoundryLocalManager.instance

model = manager.catalog.get_model("nemotron-speech-streaming-en-0.6b")

if not model.is_cached:

model.download(lambda p: print(f"İndiriliyor: {p:.1f}%"))

session = model.create_live_transcription_session(

sample_rate=16000,

channels=1,

language="en"

)

# Async stream'i ayrı bir thread'de dinle

def consume_results():

for result in session.results():

marker = "[FINAL]" if result.is_final else "[...]"

print(f"{marker} {result.text}")

threading.Thread(target=consume_results, daemon=True).start()

session.start()Python dışında JavaScript, C#. Rust binding’leri de var; SDK API’si dört dilde de tutarlı tutulmuş olması hoşuma gitti açıkçası. Bir ekipte üç farklı dil kullanılıyorsa kimse yeniden keşif yapmak zorunda kalmıyor, bu da gereksiz sürtünmeyi azaltıyor (en azından benim deneyimim böyle)

Türkçe Desteği Meselesi

Burası biraz tatsız ama söylemem lazım: Şu an katalogdaki streaming speech modelleri ağırlıklı İngilizce geliyor. Türkçe için doğrudan bir streaming model henüz yok — en azından ben bulamadım; Whisper-large modellerini Foundry üzerinde batch olarak çalıştırabiliyorsunuz. Gerçek-zamanlı Türkçe transkripsiyon için bekleyeceğiz gibi dürüyor.

Ve işler burada ilginçleşiyor.

Hani, Eğer bugün bir banka projesinde Türkçe çağrı transkripsiyonu yapmak zorunda kalsaydım yine Azure AI Speech’e dönerdim; en azından Foundry Local tarafında Türkçe streaming modeli gelene kadar durum bu olurdu sanırım. Microsoft tarafına da feedback bıraktım — bakalım ne çıkacak. Daha fazla bilgi için Azure’ın Avrupa Yatırımları: Egemen Bulut ve AI Genişlemesi yazımıza bakabilirsiniz. Kubernetes v1.36: Volume Group Snapshots Sonunda GA Oldu yazımızda bu konuya da değinmiştik.

Text Embeddings: RAG İçin Lokal Çözüm

Bence en kritik ekleme embeddings desteği olmuş olabilir; çünkü kurumsal müşterilerin büyük kısmı şu anda RAG peşinde koşuyor. Hemen herkes aynı soruyu dönüp dolaşıp soruyor: “Verimi dışarı çıkarmadan bunu yapabilir mıyım?” Peki neden bu kadar takılıyorlar? Çünkü veri hassasiyeti deyince konu bir anda teknik olmaktan çıkıp hukuk ve güvenlik tarafına kayıyor.

Cevap artık netleşiyor gibi: Evet, yapabilirsiniz! Foundry Local üzerinden lokalde embedding üretip lokal bir vector store’a (Qdrant, Chroma ya da PostgreSQL pgvector) basabiliyorsunuz; veri makineden çıkmıyor. Bu kısım özellikle iç rahatlatıyor.

Bunu daha derin anlattığım Azure SQL’de AI_GENERATE_EMBEDDINGS GA: T-SQL ile Vektör Devri yazısında Azure tarafını işlemiştim zaten; Foundry Local işe bunun on-premise karşılığı gibi düşünebilirsiniz ama burada kontrol sizde biraz daha fazla oluyor. mssql-python’a Apache Arrow Desteği: SQL Server için Yeni Devir yazımızda bu konuya da değinmiştik.

Pratik Senaryo: Hukuk Firmasında RAG

Tam burada aklıma geçen ay yaptığımız POC geldi; bir hukuk bürosu için çalıştık. Içeride yaklaşık 40 bin içtihat dökümanı vardı, hiçbiri buluta gidemiyordu çünkü müşterinin çizgisi netti (ve açık konuşayım haklıydılar). Avukatlar doğal dille soru sorup ilgili kararları bulmak istiyordu; yanı klasik arama kutusu yetmiyor artık.

- Dökümanlar chunk’lara bölündü (yaklaşık 800 token’lık parçalar)

- Foundry Local’in embedding modeli ile her chunk vektörize edildi

- Vektörler Qdrant’a yazıldı — hepsi müşterinin kendi sunucusunda

- Sorgu geldiğinde soru da aynı modelle embed ediliyor ve semantic search yapılıyor

- Sadece ilgili chunk’lar küçük bir lokal LLM’e context olarak veriliyor

Sonuç? Aylık fatura sıfır TL token maliyeti öldü; sadece donanım amortismanı kaldı ki o da başka hesap tabiî. Müşteri memnun kaldı mı? Kaldı diyebilirim ben de fena şaşırmadım açıkçası.

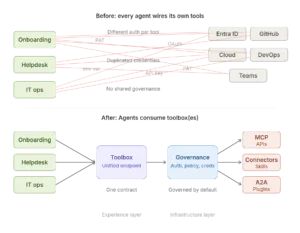

Responses API: Agentic Senaryolar İçin

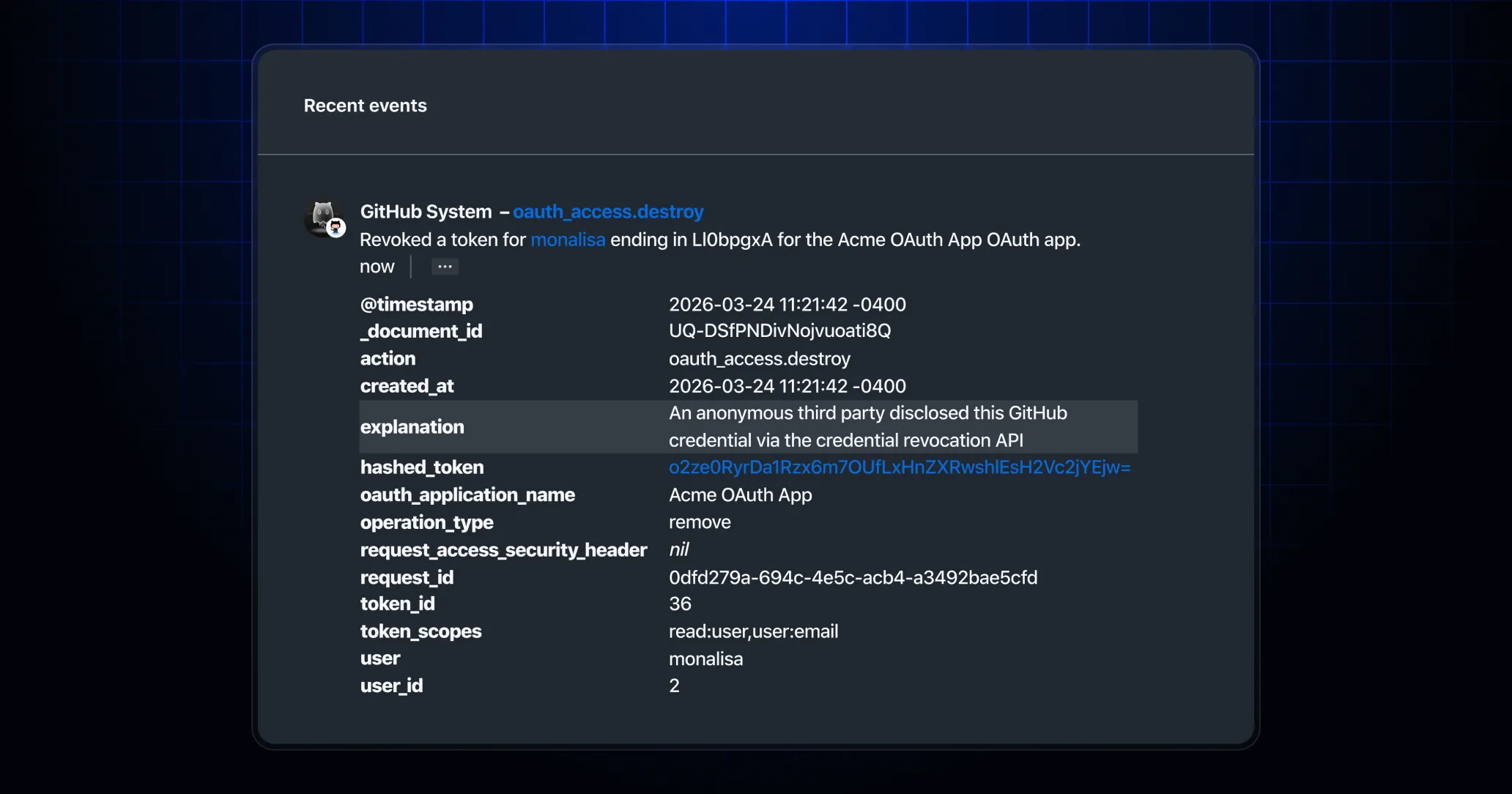

Laf arasında söyleyeyim: 1.1’in üçüncü büyük yeniliği Responses API desteği olmuş durumda. Bu kısım bana biraz ham geliyor şu an — dürüst olayım. Yine de yapılabilen şeyler boş değil; tool calling var, multimodal vision-language input var, structured agentic interactions var… yanı lokalde küçük ajanlar koşturabiliyorsunuz işte. Bu konuyla ilgili Red Hat Summit 2026: Azure OpenShift ile AI Üretime Geçti yazımıza da göz atmanızı tavsiye ederim.

Ama gerçekçi olalım şimdi. Lokalde 7B-13B parametrelik bir modelle GPT-4 seviyesinde tool-calling beklemeyin; orada beklentiyi fazla şişirmek kafa karıştırır yalnızca. Pratikte nerede işe yarıyor derseniz dar kapsamlı ve deterministik ajanlarda baya idare ediyor; mesela IT helpdesk’te “kullanıcı şunu istedi, şu API’yi çağır ve sonucu özetle” tarzı görevlerde gayet kullanılabilir dürüyor.

- — ciddi fark yaratıyor

!

Paketleme ve Performans İyileştirmeleri

Embeddings ve sık kullanılan ufak modeller Foundry Local’de kalıyor.

Ağır LLM ihtiyaçları için Azure OpenAI kullanılıyor.

Böylece veri hassas kısımlar lokalde dürüyor,

kompleks reasoning için cloud’a çıkılıyor.

Açıkçası denge fena olmuyor.

Sıkça Sorulan Sorular

Foundry Local Windows dışında da çalışıyor mu?

Tuhaf ama, Evet, cross-platform yanı farklı sistemlerde çalışıyor. Windows, macOS ve Linux destekleniyor. Apple Silicon (M1/M2/M3) üzerinde Metal Performance Shaders ile, NVIDIA GPU’larda CUDA ile, ARM cihazlarda işe NPU desteğiyle çalışıyor. Ben mesela MacBook Pro M2’de geliştirme yaparken aslında yeterli performansı alıyorum, çoğu zaman sıkıntı olmuyor. Cosmos Conf 2026: AI Çağında Veritabanı Mimarisi Nereye Gidiyor? yazımızda bu konuya da değinmiştik.

Şimdi gelelim işin can alıcı noktasına.

Foundry Local kullanırken Microsoft’a veri gidiyor mu?

Hayır, inference tamamen lokalde kalıyor. Yanı dışarıya bir şey gitmiyor. Sadece model indirirken Microsoft’un katalog endpoint’lerine bağlantı kuruluyor, o kadar. Modeli bir kez indirdin mi, tamamen offline çalıştırabiliyorsun. Hatta air-gapped ortamlar için model dosyalarını elle transfer etmek de mümkün (en azından benim deneyimim böyle)

Hangi modeller live transcription destekliyor?

Şu an katalogda Nemotron-speech-streaming serisi var, özellikle nemotron-speech-streaming-en-0.6b. Ağırlıklı olarak İngilizce. Whisper türevleri de mevcut ama onlar batch mod için, yanı gerçek zamanlı streaming için seçenek aslında oldukça sınırlı (evet, doğru duydunuz). Sız ne dersiniz? Çoklu dil desteği için Microsoft’un yol haritasını takip etmek gerekiyor, bence bu taraf biraz zaman alacak.

Foundry Local ile Ollama arasındaki fark nedir?

Ollama daha geliştirici odaklı, hızlı bir şeyler denemek için süper. Foundry Local işe enterprise senaryolar için tasarlanmış: katalog yönetimi, SDK’lar (Python/JS/C#/Rust), Responses API gibi daha yapısal bir yaklaşım var. Bir de Microsoft ekosistemiyle entegrasyon, hani Azure AI Foundry. Agent Framework gibi şeyler, Ollama’da bu kadar net değil. Açıkçası ben production senaryoları için Foundry Local, hızlı prototipler için Ollama tercih ediyorum.

1.0’dan 1.1 sürümüne geçiş sorunsuz mu?

JavaScript SDK’da koffi FFI’dan native addon’a geçiş yapıldığı için bazı edge case’lerde build sorunlarıyla karşılaşabilirsiniz. C# tarafında işe lower framework targeting nedeniyle çoğu projede sorun çıkmıyor. Tecrübeme göre birkaç projemi upgrade ederken sadece WebGPU plugin’ını explicit olarak yüklemek dışında pek bir sıkıntı yaşamadım. Mantıklı değil mi? Yine de production öncesi mutlaka staging’de test edin, bence bu adımı atlamayın.

Hmm, bunu nasıl anlatsamdı…

Kaynaklar ve İleri Okuma

Bakın, Foundry Local 1.1.0 Release Announcement (Microsoft DevBlogs)

Bu içerik işinize yaradı mı?

Benzer içerikleri kaçırmamak için beni sosyal medyada takip edin.

Yorum gönder