.NET MAUI Geliştirme Sürecinde Yapay Zekâ Ajanlarıyla Hız Artışı: Gerçekten Fark Yaratıyor mu?

Başlangıçta Takılanlar:.NET MAUI Katkı Süreci Neden Bu Kadar Zordu?

Dürüst olalım, açık kaynaklı projelere destek vermek ilk başta kulağa hoş geliyor ama iş büyüdükçe insanın eli ayağına dolaşıyor. Hele ki Microsoft’un devasa framework’lerinde — az çekmedim. 2021’in sonu civarı Logosoft Bilişim’de bir müşteri için.NET MAUI’ye geçişi deneyince, ekibin ilk duvara tosladığı yer “daha kod satırına dokunamadan ortamı kurmak” öldü. O gün hissettiğim çaresizliği unutamam: Sandbox’u ayağa kaldırmaya çalışıyorsun, her platform başka türlü trip atıyor, test ortamı kurmak ayrı bir stres kaynağı… Zaman su gibi akıp gidiyor ve daha bugfix’i göremiyorsun bile! Bildiğin sıradan bir typo’yu düzeltmek bile koca günü yiyip bitiriyor. Hani bulut entegrasyonu falan derken olay tamamen dallanıp budaklanıyor ya, işte tam öyle.

Bak geçen ay bankacılık sektöründen yeni başlamış iki arkadaş “Abi ben üç saattir Windows build’iyle cebelleşiyorum!” diye isyan etti. İnan tek onlar değil; neredeyse tüm.NET MAUI topluluğu aynı dertten muzdarip.

Bu Sorunu Nasıl Aştılar? AI Ajansız Hayat Biraz Demode Kaldı

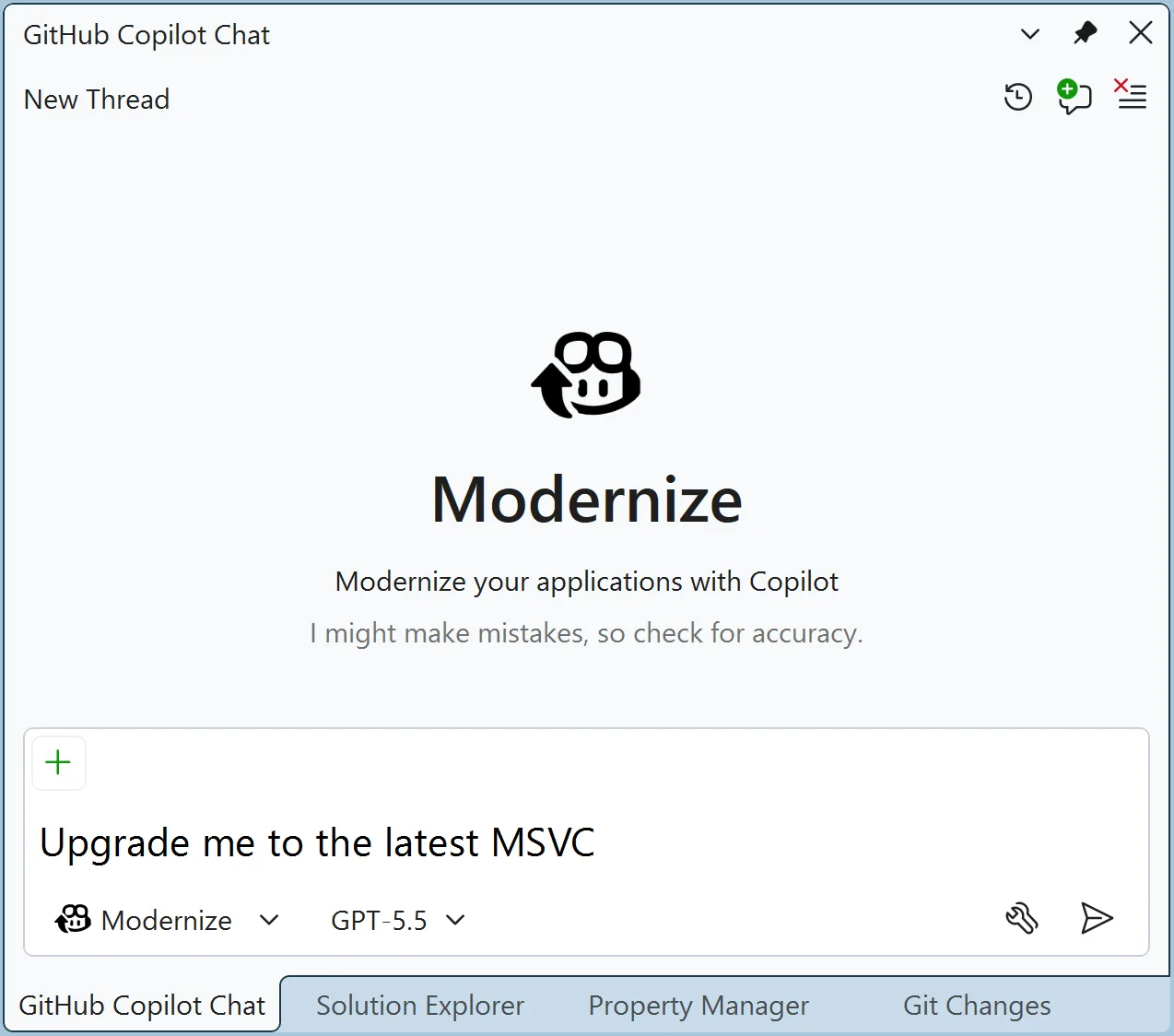

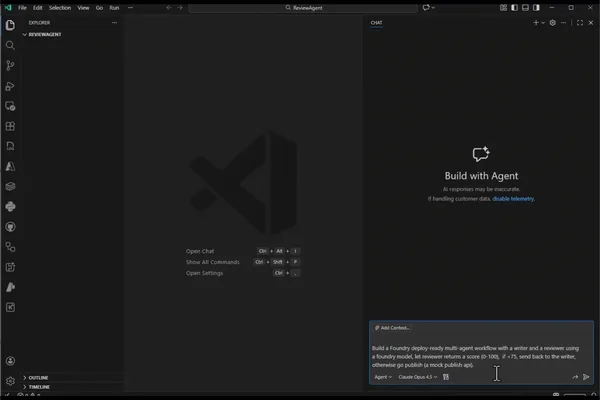

İşin garibi, Birkaç ay önce Syncfusion ekibinin paylaştığı çözüm kafamı fena hâlde kurcaladı: Özelleştirilmiş yapay zekâ ajanları! Gerçekten bu kadar havalı mıydı emin değildim; anlatıldığı gibi mi göreceğiz dedim ve denedim… Açık söyleyeyim, sonuçları görünce şaşırmadım desem yalan olurdu. Belki Copilot" data-glossary-term="GitHub Copilot">GitHub Copilot gibi AI developer asistanlarına denk gelmişsindir — burada olay farklı ama; bildiğin.NET MAUI’nın damarına özel biçimde tasarlanmış ajanlardan bahsediyoruz (şaşırtıcı ama gerçek)

İlk duyunca “Yapay zekâ testte-bug’da ne kadar işe yarar ki?” diye burun kıvırmıştım ama canlıda izleyince ciddi zaman kazancı aldığımız çok net.

Aklınızda canlansın diye örnek veriyorum; klasik katkıda bulunma adımlarını baştan aşağı hızlandırmayı hedefliyorlar:

- Sorunun yeniden üretilmesi: Platform sandbox’ünü hazırlamak… yok öyle hemen olacak iş değil (30 dakika desen hafif kalır!)

- Kök neden analizi: Handler hatası mı var? Yoksa direkt platforma özgü rezillik mi? Üç saat uğraşsan da bazen nafile!

- Düzeltme ve test aşaması: Diyelim kodu yazdın – testini yazmazsan PR açsan bile yüzüne bakan çıkmıyor.

- Kapsamlı test oluşturma: Büyür bakalım şimdi de upuzun kapsam dosyalarıyla cebelleş…

.NET MAUI’da platforma özgü kurulum/test süreçleri zorlayıcıyken, yapay zekâ ajanları bu adımları otomatikleştirerek katkı hızını artırmayı hedefliyor. Aşağıdaki tabloda “klasik süreç” ile “AI ajan” yaklaşımı özetleniyor.

| Özellik | Klasik.NET MAUI katkı süreci | AI ajanlarla hızlanan süreç |

|---|---|---|

| Sorunu yeniden üretme | Sandbox/CI kurulumuyla zaman kaybı | Hızlı hazırlanmış test ortamı hedeflenir |

| Kök neden analizi | Handler/platform ayrımı için uzun deneme-yanılma | Otomatik tarama ile olası hatayı öne çıkarma |

| Düzeltme + test | Test yazımı ve kapsam dosyaları elle yönetilir | Kapsamlı test oluşturma ve doğrulama akışını hızlandırır |

| PR/inceleme süreci | PR review aşamasında sürpriz hatalar görülebilir | pr-review skill ile ön kontrol ve daha doğru yönlendirme |

Not: Yazıda vurgulanan etki, özellikle “pre-flight analiz” ve “pr-review” gibi erken aşama otomasyonlarda net zaman kazancı.

pr-review Skill ve Diğer Akıllı Arkadaşlarıyla Tanışalım

Böl-Parçala-Yapıştır Zekâsı Değil, İş Bitiren Asistanlık

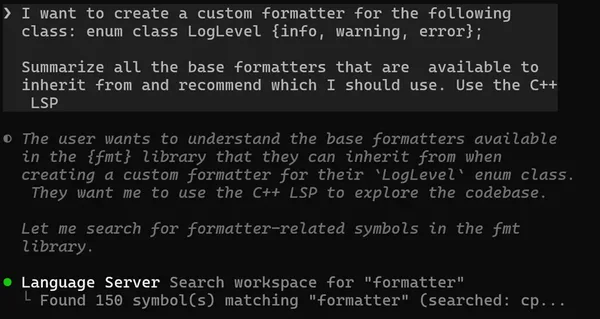

Syncfusion ve Microsoft takımı birkaç tane temel yetenek geliştirmiş — bunlara skill diyorlar. En can alıcı olan işe pr-review skill (ki bu çoğu kişinin gözünden kaçıyor). Bence klasik kod review mantığını ters yüz edecek güçte.

- Ana Analiz (Pre-Flight):

Ajan önce GitHub issue’şunu tarayıp ilgili kod parçalarını yakalıyor, hangi platformlarda sıkıntının patladığını belirliyor. Geçen hafta yaptığım bir denemede ajanın sadece dakikalar içinde Android’e özgü problemi bulması ekipte minik bir kutlama havası yarattı! Halbuki elde incelesek kaçacak detaydı yanı. - Sınav Kapısı (Gate-Test Verification):

Akıllıca düşünülmüş bir engel mekanizması var — eğer ilgili sorunun düzgün testi yoksa sana “Önce şurada testi hallet” diyor. Otomatikleştirmek istiyorsan başka skill sahneye çıkıyor (write-tests-agent mesela). - Dener-Dener-Bulur (Try-Fix):

Asıl eğlenceli yere geldik! Dört farklı model ile dört bağımsız düzeltme önerisi sunuyor ajan; ardından hepsinde testi koşturup sonuçları karşılaştırıyor.

Bir senaryo:

— İlk hamle handler seviyesinde ufak değişiklik → iOS tarafında sorun hallolmuş fakat Android hâlâ sorunlu

— İkinci yaklaşım platform modülüne el atmak → Tüm ortamlarda geçti gibi gözüküyor ama eski işlevlerden biri bozulmuş

— Üçüncü yol çekirdekte koruyucu katman → Her şey başarıyla geçti! Ekip bunu seçti.

Yanı artık saatler süren deneme-yanılmaları AI’ya devrediyoruz… Fena fikir değil doğrusu. - Bitiş Raporu (Report Generation):

Dört alternatif çözümün sonuçlarını tek raporda topluyor – kim neyi niye seçti anında belli oluyor; yöneticiye göstermelik süper özetler!

Peki Ya Dezavantajları?

Evet güzel şeyler söylüyoruz ama hiç mi pürüz yok? Tabiî ki eksikleri de mevcut.

Mesela kimi zaman önerilen çözümler fazla karmaşık ya da pratikte çalışmayan cinsten çıkabiliyor. Ocak ayında kendi side-project’ime baktığımda “AI’ın sunduğu fix’in compile dahi olmadığını” fark ettim mesela! Düzgün hâle getirmek yine bize kaldı.

Bir not daha bırakayım; final onayı hâlâ insanda olmak zorunda – aksi hâlde agent’ın yaptığı en küçük saçmalık prod’u çökertmeye yeter.

Maalesef.

Neler Kazandık? Kaybedilenler Var mı?

Burası önemli bak! Benim gördüğüm en büyük artısı hız öldü.

Klasik süreçlerde yeni başlayanların PR açma macerası günlere yayılırken artık birkaç saate inebiliyor.

Ama şahsen beni sevindiren nokta şu öldü – ekip içindeki iletişim gözle görülür biçimde berraklaşıyor; herkes konudan kopmadan ilerleyebiliyor.

Öte yandan hayal kırıklığı yaşadığım yer de var:

Bazı ince edge-case’lerde insan faktörünün yerini hiçbir yapay zekâ tutmuyor.

Nisan ayında Logosoft’taki müşteri projesinde AI agent’ın gözden kaçırdığı spesifik event zinciri ancak el yordamıyla debug yapınca ortaya çıktı.

O yüzden %100 otomasyon beklemek abartılı olur! Ama %60-70 civarı hızlanma fena mı Allah aşkına? .NET ve OpenAI ile Gerçek Zamanlı Sesli Çoklu Ajan: RT.Assistant’a Dair Sahici Notlar yazımızda da bu konuya değinmiştik. .NET Modernizasyonunda Yepyeni Bir Dönem: GitHub Copilot ile İstediğin Yerden yazımızda da bu konuya değinmiştik. .NET ve.NET Framework Mart 2026 Güncellemeleri: Gerçekten Güncelleme Yapmalı mıyız? yazımızda da bu konuya değinmiştik.

Ben mesela böyle sunumlarda en karamsar arkadaşı bile ikna edebildim.

Kendi Takımlarında Kullanmak İsteyenlere Pratik Tavsiyelerim

Düşünmeden Dalma!

Eğer bu tarz ajanlarla işleri hızlandırmaya niyetlendiyseniz lütfen acele etmeyin — öncelikle ufak pilot takım üzerinde deneyin nerede tökezleniyor görün derim.

Bir anda ana repo’ya salmayın yanı!

- Kendi CI/CD hattınıza entegre edin – ister Azure DevOps ister Actions" data-glossary-term="GitHub Actions">GitHub Actions kullan fark etmez.

- Tüm süreç boyunca agent loglarını mutlaka saklayın; geçmişe dönüp hangi noktada patlamış kolayca bulursunuz.

- Ajanların verdiği fixleri prod’a atmadan evvel dikkatlice review edin uyarıyorum!

- Eğer Azure altyapısı varsa role bazlı izinleri iyi yönetin — bazı işlemlerde ajanın fazladan erişime ihtiyacı olabilir çünkü.

- Maliyet hesabını unutmayın sakın! Bilhassa işlem yoğun repolarda CPU/saat masrafınız harbi hızlı tırmanabilir.

Microsoft Veritabanlarında Yapay Zekâ Ajanı Devrimi: Hibritten Buluta Geçişte Gerçek Fırsatlar‘nde FinOps açısından bolca ipucu paylaşmıştım zaten.

Sorular & Cevaplar Tadında Son Notlarım

- Ajanlara tamamen güvenilir mi?

Hayır!

Edge-case’lerde mutlaka insan müdahalesine ihtiyaç duyuluyor, güvenmeyin körü körüne. - Zaman kazandırıyor mu?

Net bir şekilde evet!

Sıkıcı tekrar eden işler söz konusuysa gerçekten uçurum yaratıyor… - Tüm bugfix tiplerine uygun mu?

Ne yazık ki hayır… Core framework hatalarında genelde gayet iyi,

üçüncü parti paketlerle didişirken hâlâ zorluk çıkarabiliyor.

Örneğini görmek istersen:

Terminalde AI Ajanlarını Koddan Teste Taşımak: azd ile Gerçekten Yerel Deneyim‘taki vaka tam buna örnek olmuştu.

Kapanış Yeri Burasıysa…

.NET MAUI ekosisteminde gerçek katkıya giden yol artık yalnızca uzmanlıkla değil,

doğru araçlarla akıllıca otomasyon yakalamaktan geçiyor bana sorarsanız.

Her zamanki tavsiye ile bitireyim:

Sağlam yapılandırılmış bir AI ajan sistemi sizi o gün kurtaran kişi ilan eder. Kötü planladıysanız üstünüze ekstra yükten başka pek işe yaramaz!

Bulut-mobil projelerde hayatımı kolaylaştırdığı kesin fakat tüm ipleri ona bırakmam –

sız de bırakmayın derim…

Beklentiyi makulde tutup zaman kazanırsanız tadından yenmez!

Kaynak:

Accelerating.NET MAUI Development with AI Agents

Sıkça Sorulan Sorular

.NET MAUI’da yapay zekâ ajanları gerçekten “test ortamı kurma” süresini kısaltıyor mu?

Evet, özellikle sandbox ve platform hazırlığı gibi tekrarlı adımlarda ciddi hız kazancı sağlıyor. Ajansal akışlar, sorunu yeniden üretme adımlarını daha hızlı netleştiriyor ve gereksiz deneme-yanılmayı azaltıyor. Benim deneyimimde en çok zaman kaybettiren “bu hata hangi platformda patlıyor?” kısmı daha çabuk çözüldü.

AI ajanları.NET MAUI’da kök neden analizini (root cause) nasıl hızlandırıyor?

Ajansal yaklaşım genelde issue açıklamasını ve ilgili kod parçalarını tarayıp olası kaynakları daraltıyor. Handler tarafında mı sorun var, yoksa platforma özgü bir uyumsuzluk mu diye daha hızlı bir çerçeve kuruyor. Böylece üç saat uğraştığın senaryoların bir kısmını daha baştan elemiş oluyorsun.

PR-review skill.NET MAUI katkı sürecinde neyi değiştiriyor?

PR-review skill, klasik “kod geldi, bekleyelim” akışından ziyade daha aktif bir ön inceleme yapıyor. Pre-flight adımında hangi değişikliklerin riskli olabileceğini ve hangi platformlarda tekrar test gerektiğini önden çıkarabiliyor. Ben bunu görünce “bu gerçekten review süresini kısaltır” hissini net aldım.

Yapay zekâ ajanlarıyla üretilen testler her zaman yeterli mi, yoksa yine de manuel test şart mı?

Genelde ajanlar hızlı bir temel test seti çıkarır ama her projede kapsam yine manuel kontrol ister. Özellikle UI akışları, cihaz/OS farklılıkları ve edge case’ler için testleri tamamlamak önemli. Pratikte ben, ajanın hazırladığı testleri “ilk güvenlik ağı” gibi görüyorum; sonra kritik akışları ayrıca doğruluyorum.

Bu yaklaşım GitHub issue ve PR iş akışına nasıl entegre ediliyor?

Akış genelde issue’yu tarayıp ilgili bileşenleri hedefleyerek başlıyor, ardından düzeltme ve test adımlarını planlıyor. PR aşamasında da ön inceleme ve risk tespiti gibi görevleri hızlandırıyor. Böylece hem katkı süreci daha düzenli ilerliyor hem de platform kaynaklı sürprizler azalıyor.

Kaynaklar ve İleri Okuma

GitHub -.NET MAUI Resmî Deposu

Azure Blog – AI Destekli.NET MAUI Geliştirici Araçları

Syncfusion Blog – Yapay Zekâ Ajanlarıyla.NET MAUI Hızlandırma

Bu içerik işinize yaradı mı?

Benzer içerikleri kaçırmamak için beni sosyal medyada takip edin.

Yorum gönder