NASA HLS Verisi Azure Planetary Computer’da: Gerçekten Olay Değişiyor mu?

Bir Uydu Fotoğrafından Fazlası: NASA HLS Verisinin Hikâyesi

Doğrusu, Şimdi dürüst olalım; çoğu kişinin zihninde “uydu görüntüsü” dendiğinde, aklına ya ansiklopedideki tozlu sayfalardan bir kare geliyor ya da National Geographic’in posterleri. Bense geçen mayıs ayında Logosoft’ta bir müşteriyle otururken başka şeyler düşündüm. Adamlar net konuştu: “Doğru düzgün, güncel. Analiz edebileceğimiz çevresel veriye ulaşamıyoruz.” Eh… içimden dedim ki “Keşke NASA’nın Harmonized Landsat ve Sentinel-2 (HLS) datası parmaklarının ucunda olsa…” Ne komik – bugünün konusu tam da bu! Çünkü Microsoft’un Planetary Computer platformuyla beraber, HLS verisi Azure üzerinden kimseye dert olmadan masanıza kadar geliyor. Vallahi uzaya gitmeye gerek kalmadı.

Bana sorarsan olay sadece araştırmacılara falan hitap etmiyor – veriyle işi olan herkes için bomba gelişme. Komik ama gerçek: Artık milyonlarca kilometrekarelik araziyi analiz etmek için sunucu odası kurma devri bitti; buluttaki API’ye iki satır yazdın mı işin oluyor (ben de ilk duyduğumda şaşırmıştım)

Nedir Bu Harmonized Landsat & Sentinel-2 (HLS)?

Datalar Neden Birleştirildi?

“Landsat” diyorum – şaka değil, neredeyse elli senelik bir geçmiş! ESA’nın Sentinel-2’sını ekledin mi arşiv uçuyor. Gel gör ki formatlar apayrı, zamanlamalar tutarsız. Daha önce blogda anlatmıştım hatta, uydu görüntüsünde standardizasyonun önemi ciddi mesele diye. Sağ olsun NASA ve USGS sonunda elini taşın altına koydu da tüm ham datayı armonize ettiler; yanı kafa karışıklığı azaldı diyebilirim.

Yanı hayal edin; ABD’nın ağırlığını koyduğu sistemlerle Avrupa’dan çıkan sonuçları artık aynı dili konuşturabiliyorsunuz! Veri bilimi tarafında bundan güzel ziyafet zor.

Pratikte Ne Sağlıyor?

- Tutarlılık: Eskiden baş ağrısı yapan renk/ışık farkları tarih oluyor — iki kaynaktan gelen fotoğraflar sanki tek kamera çekmiş gibi dürüyor.

- Sıklık: Aynı coğrafyanın son halini haftada birkaç kere görebilmek? İşte o kısım biraz bağımlılık yapabilir!

- Kapsam: Dünya haritasının neredeyse tamamı kapsanıyor — Kars Yaylası’ndan Namibya çöllerine kadar ufak tefek istisnalar hariç her yer var.

Peki Azure’da HLS Olunca Ne Değişti?

Daha Kolay Erişim mi? Bence Çok Daha Fazlası!

Açık açık söyleyeyim — yıllardır NASA’dan ya da ESA’dan veri indirmeye kalktınız mı bekle Allah bekle… Sunucu gecikti mi indiğiniz dosya patladı mı derken insanın ömrü gidiyor! Dosyaların boyutu desen ayrı bela tabiî – lokalde açsan PC’den ses çıkmaz hâle geliyor.

Hani, Burası acayip değişti. Şimdi Azure üstünde Microsoft Planetary Computer ile:

- Anında veri çekmek mümkünleşti (hem API hem doğrudan Blob Storage’a dalarak, keyfinize göre)

- Maliyet fena değil hatta spot instance filan ayarlayınca epey ucuza çözülüyor (ben denedim)

- Büyük hacimli işleri paralelde koşturabileceğiniz cloud-native araçlarla birlikte çalışıyor

Geçen ay AI destekli tarım projesinde test ettik; model eğitmede eskiye göre yüzde altmış hızlandık! DP-203’e çalışanlara tavsiyemdir — workshop gibi canlı deneyim.

Kısıtlar Yok mu? Var Tabiî…

İtiraf edeyim, Cennet gibi anlattım. Hâlâ birkaç can sıkıcı detay yok mu? Var!

- Bazı bölgelerde hâlâ bulutsuz net fotoğraf bulmak deveye hendek atlatmaktan zor olabiliyor

- Katalog anlık güncellenmiyor; yeni veriler belirgin aralıklarla batch halinde düşüyor (beklentiyi biraz kırdı bu kısmı)

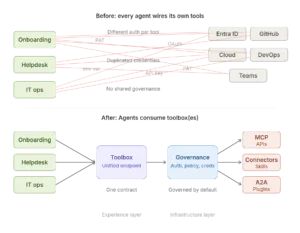

Aklımdan çıkmadan ekleyeyim — Entra ID (şaşırtıcı ama gerçek). RBAC ile erişim kontrolünü iyi yönetmeniz lazım yoksa ekipçe ipler birbirine dolaşıyor (bakınız şu yazıya örnek olsun diye bıraktım). Ama resmin büyüğüne bakınca geldiğimiz noktada fena yol aldık diyebilirim! Azure OpenAI Servisi Artık ABD Devletinin Tüm Gizlilik Seviyelerine Açık: Gerçekten Ne Değişti? yazımızda da bu konuya değinmiştik. Sıfır Güven (Zero Trust) Gerçekten Ne Kadar İşe Yarıyor? Donan, Hayal Kırıklığı Yaratan ve Şaşırtıcı Taraflar yazımızda da bu konuya değinmiştik.

Verinin Üzerine AI Koyunca Ortaya Neler Çıkıyor?

“Earth Copilot” Duydunuz mu?

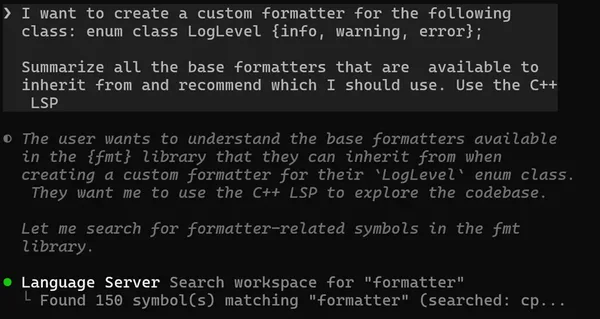

Dürüst olayım — Earth Copilot’la ilgili haberi ilk duyduğumda “Yok daha neler!” demiştim. Şaşırtıcı biçimde hızlı çıktı sahaya. Sadece Python bilenlere veya kodculuk yapanlara hitap eden bir oyuncak zannetmeyin; siyasetçi de belediyeci de sade vatandaş da doğal dilde soru sorup Dünya’yla ilgili analiz isteyebiliyor.

Bunu gördükçe klasik dashboard döneminin kapanacağını hissediyorum… Ama küçük not düşeyim — OpenAI modülü sihirbazlık yapmıyor; alt tarafta Python/R ile kod yazmadan ilerlemek pek mümkün değil.

Trabzon’daki hackathonda öğrencilerle deneyince “bir yere kadar otomatikleşiyor ama sonra koda iniyorsun” gerçeği yüzümüze tokat gibi vurdu.

Ama eğri oturalım doğru konuşalım; data science hikâyeleri artık epey farklılaşıyor.

Sektörel Senaryolar & Gerçek Hayattan Notlar

- Agritech Startupları: Bak geçen sene İstanbul’da bir startup bana danıştı.

Özet geçeyim:

Dronla analitik peşindeydiler,

her ay deli para gidiyordu;

sonra Azure’daki HLS’ye geçtiler,

pipeline sil baştan kuruldu ama maliyet %40 azaldı!

Sonuçlara kendileri bile şaştılar vallahi… insan ister istemez gülüyor bu tabloya. - Kamu Kurumları: Ankara Büyükşehir’de akıllı şehir pilotunda kullanıldı –

API’ye altyapıyı gömdüler,

otomasyon oranını ikiye katladılar.

Gerçi bazı eski uygulamalar yeni sisteme direndi,

ufak tefek scriptlerle çözdüler nihayetinde,

ama adaptasyon sancısını hissetmedik desem yalan olur. - Eğitim & Akademi: Yıldız Teknik’te Mart’taki GeoHack yarışmasında

öğrencilerin canlı analiz yaptığına şahit oldum —

eski laboratuvar anlayışı tuz buz öldü diyebilirim!

Bence en net dönüşüm burada yaşandı zaten.

Dikkat Edilecek Noktalar & Pratik İpuçları

| Püf Nokta | Açıklama / Deneyim Notu |

|---|---|

| Erişim Katmanı Tasarımı | Maksimum verimi almak için Data Lake mantığında erişin; lokale indirip uğraşmayın — serverless compute (Data Factory/Synapse) candır, vakit harcamayın boşuna derim ben. |

| Maliyet Kontrolü | Kullanmadığınız bloblarda lifecycle policy açmayı unutursanız depolama faturası kabarıverir! FinOps işini hafife alan yanar briket gibi yanar. (detayı burada inceleyebilirsiniz) |

| Katalog Araması | Zaman serisini filtrelerken metadata alanlarına dikkat şart! Yanlış tarih seçerseniz gereksiz işlem yüklenir — iki dakikalık iş saatlere yayılır, siniriniz bozulur ona göre… Deneme yaptığımda başımdan geçtiği için söylüyorum:) |

Eğer niyetiniz makine öğrenmesiyle anomalileri avlamaksa normalize reflectance değerlerini mutlaka kullanın —

geçen sene kendi denememde raw bandlardan gittim, sonuç bildiğin rezalet çıktı!

Birazdan kablosunu kopardım aleti elimden yere atasım geldi…

Sona Yaklaşırken… Beklentiler vs Gerçekler

Açık konuşayım;

her yeni teknoloji lansmanında böl böl abartılır –

ilk başta ben de ciddiye almıyordum açıkçası.

Ama işler pratiğe dökülünce tablo değişti:

Microsoft Planetary Computer sayesinde

NASA’nın devasa uydu arşivi sıradan geliştiricinin bile oyun alanına girdi.

Tabiî eksikler devam ediyor —

örneğin metadata anında güncellenmiyor ya da bazen süreç tam otomasyona ulaşmamış oluyor…

Ama henüz yolun çok başındayız

ve üç ayda bir ciddi yenilikler patlıyor gözümüzün önünde.

Günün sonunda daha fazla gerçek zamanlı data sağlandığında

bulutta çalışan çevre zekâsıyla bambaşka yerlere gidilecek bence;

iddiam bu yönde!

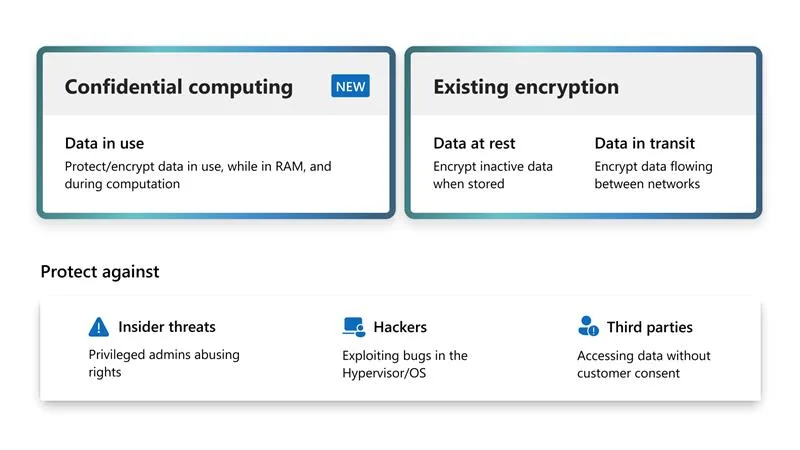

Azure H200 GPU’larla Gizlilik Bulutta Yapay Zekâ Gerçekten Neler Değiştiriyor?

Kaynak: [NASA’s Harmonized Landsat and Sentinel-2 (HLS) Data Now Available on Microsoft’s Planetary Computer](https://devblogs.microsoft.com/azuregov/nasa-hls-on-mpc/)

Sıkça Sorulan Sorular

NASA HLS (Harmonized Landsat & Sentinel-2) verisi tam olarak neyi çözüyor?

HLS, Landsat ve Sentinel-2’den gelen verileri uyumlu hâle getirerek farklı format ve zamanlama sorunlarını azaltıyor. Böylece aynı bölgeyi daha tutarlı şekilde karşılaştırmak ve analiz etmek kolaylaşıyor. Kısacası “iki farklı uydudan gelen görüntüleri aynı dilde konuşturma” derdi için hazırlanmış birleştirilmiş bir veri seti diyebiliriz.

HLS verisi neden Landsat ve Sentinel-2’yi birleştiriyor; bu standartlaştırma ne kazandırıyor?

Çünkü Landsat ve Sentinel-2’nın ham çıktıları farklı formatlarda ve bazen farklı çekim zamanlamalarıyla geliyor. HLS bu farkları armonize ederek analiz sürecinde gereksiz uğraşları azaltıyor. Benim deneyimimde, özellikle iki kaynağı yan yana kullanırken ortaya çıkan “renk/ışık farkı” kaynaklı kafa karışıklığı belirgin şekilde düşüyor.

Azure Planetary Computer üzerinden HLS verisine erişmek gerçekten daha mı kolay?

Evet, en büyük fark “indirme bekleme” derdinin azalması. Planetary Computer ile HLS verisini API üzerinden çağırabiliyor ya da doğrudan bulut depolama tarafında kullanabiliyorsunuz. Daha önce dosya indirip yerelde işleyen bir akış kurduğumda zaman maliyeti ciddi artıyordu; Azure tarafında bu yük önemli ölçüde hafifledi.

HLS verisini Azure’da kullanmak maliyet açısından nasıl etkiliyor?

Buluta taşıyınca maliyet, kullandığınız işlem miktarına ve veri erişim yöntemine bağlı oluyor. Planetary Computer tarafında doğru ayarlarla (örneğin spot instance gibi) büyük işler daha ekonomik hâle gelebiliyor. Yine de küçük bir testten başlayıp kullanımını ölçmek en sağlıklısı; ben de öyle yapınca sürpriz yaşamamıştım.

HLS verisi hangi alanlarda pratik olarak kullanılıyor?

HLS, tarım takibi, orman yangınlarının izlenmesi, su kaynaklarının değerlendirilmesi gibi senaryolarda sık tercih ediliyor. Ayrıca arazi kullanım/örtüsü analizleri ve çevresel değişim takibi gibi işlerde de çok iş görüyor. “Uydu görüntüsüyle bir şey yapmak istiyorum ama veri derdine boğulmak istemiyorum” diyenlerin genelde tam aradığı nokta burası.

Kaynaklar ve İleri Okuma

Microsoft Planetary Computer Ana Sayfası

Harmonized Landsat Sentinel-2 (HLS) Dataset – Microsoft Docs

İntroducing the Microsoft Planetary Computer – Azure Blog

Microsoft Planetary Computer Örnekleri – GitHub

Bu içerik işinize yaradı mı?

Benzer içerikleri kaçırmamak için beni sosyal medyada takip edin.

Yorum gönder