Geçen hafta bir müşterimizden acil bir çağrı geldi. Copilot Chat’te kullandıkları model bir anda çalışmayı kesmişti. Developer ekibi panik halinde — “Copilot bozuldu!” diye bağırıyorlar. Ben de baktım, durum gayet açık: GPT-5.1-Codex deprecate olmuş, adamlar habersiz. İşte tam da bu yüzden bu yazıyı yazıyorum. Çünkü model emeklilik duyuruları çoğu zaman gözden kaçıyor ama sonuçları fena halde acı verici olabiliyor.

1 Nisan 2026 itibarıyla GitHub, GPT-5.1-Codex ailesinin tamamını — yanı GPT-5.1-Codex, GPT-5.1-Codex-Mini ve GPT-5.1-Codex-Max — tüm Copilot deneyimlerinden çekti. Copilot Chat, inline edits, agent mode, code completions… Hepsi. Alternatif olarak GPT-5.3-Codex’e geçmeniz gerekiyor. Kulağa basit geliyor, değil mi? Ha işte, o kadar basit değil.

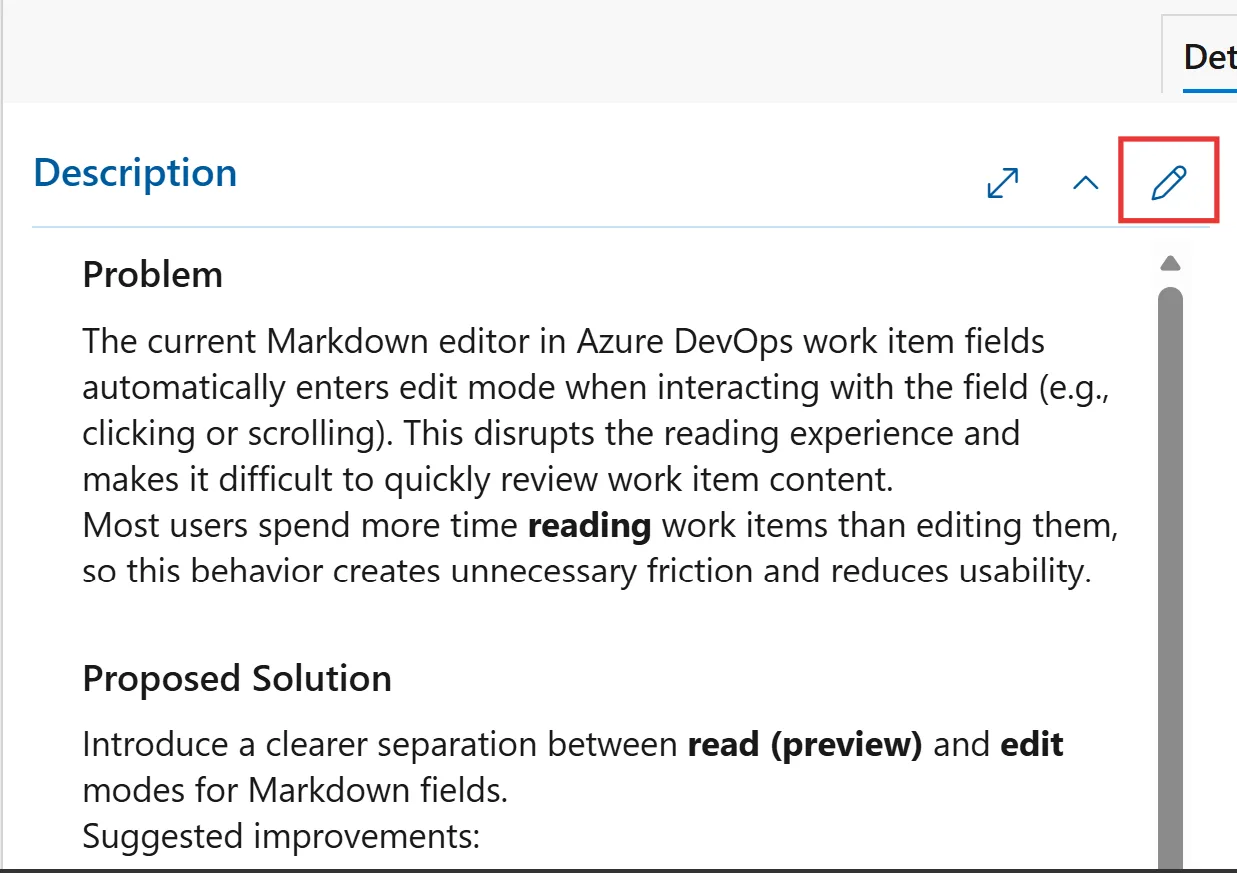

Çok konuştum, örnekle göstereyim.

Tam Olarak Ne Oldu ve Neden Önemli?

Önce şunu netleştirelim: GitHub, model deprecation’ları konusunda genelde makul bir süre veriyor. Ama bu sefer zamanlama biraz garip geldi bana. 1 Nisan — evet, şaka günü. İlk gördüğümde ben bile “Bu gerçek mi yoksa April Fools mı?” diye düşündüm (ben de ilk duyduğumda şaşırmıştım). Gerçekmiş.

Deprecate edilen üç model şöyle:

| Model | Emeklilik Tarihi | Önerilen Alternatif |

|---|---|---|

| GPT-5.1-Codex | 2026-04-01 | GPT-5.3-Codex |

| GPT-5.1-Codex-Mini | 2026-04-01 | GPT-5.3-Codex |

| GPT-5.1-Codex-Max | 2026-04-01 | GPT-5.3-Codex |

Dikkat ederseniz üçünün de alternatifi aynı: GPT-5.3-Codex (evet, doğru duydunuz). Mini için ayrı bir mini model yok, Max için ayrı bir max model yok. Hepsi tek bir modelde birleşiyor. Bu beni biraz düşündürdü açıkçası. Eskiden Mini’yi seçenler genelde hız ve maliyet için tercih ediyordu (evet, doğru duydunuz). Max’i seçenler işe daha derin analiz, daha geniş çaplı kod önerileri istiyordu. Şimdi herkese aynı modeli veriyorlar… Hmm. Belki GPT-5.3 ikisinin de işini görüyordur, belki de GitHub tiering stratejisini değiştirdi. Göreceğiz.

Bir de şunu söyleyeyim: deprecated modeller otomatik olarak kalkıyor (ciddiyim). Yanı sız bir şey yapmanıza gerek yok silme tarafında — zaten seçemiyorsunuz artık. Ama asıl mesele şu: eğer workflow’larınızda, CI/CD pipeline’larınızda veya custom entegrasyonlarınızda bu modelleri hardcode etmişseniz, işler bozulur. Sız hiç denediniz mi? Bozuldu da zaten, benim müşterimde bozulduğu gibi.

Kısa bir not düşeyim buraya.

Enterprise Yöneticileri İçin Yapılması Gerekenler

Bakın şimdi, bireysel kullanıcıysanız bu geçiş çok kolay. VS Code’da model selector’dan GPT-5.3-Codex’i seçiyorsunuz, bitti — Ama enterprise ortamında iş biraz daha karmaşık.

GitHub Copilot Enterprise kullanıyorsanız, yönetici olarak model policy’lerinizi kontrol etmeniz gerekiyor. Daha açık söyleyeyim, neden? Çünkü bazı organizasyonlarda belirli modeller policy seviyesinde kısıtlanmış olabiliyor. Mesela 2025 sonunda bir finans kuruluşunda Copilot kurulumu yaptık — hani güvenlik ekibi sadece belirli modellerin kullanılmasına izin vermişti. GPT-5.1-Codex-Mini ile sınırlamışlardı çünkü “daha az veri işliyor” diye düşünüyorlardı (ki bu tam doğru bir varsayım değildi. Neyse). Şimdi o model kalktı. Policy güncellenmezse developer’lar hiçbir modeli göremez hâle geliyor.

Adım Adım Kontrol Listesi

Bir şey dikkatimi çekti: Enterprise admin iseniz şunları yapın — lafı uzatmadan:

- Copilot Settings’e gidin — github.com üzerinden organizasyonunuzun ayarlarına. (bu kritik)

- Model Policies bölümünü açın — hangi modellerin aktif olduğunu kontrol edin.

- GPT-5.3-Codex’i enable edin — eğer zaten açık değilse. — ciddi fark yaratıyor

- Bireysel Copilot Settings’ten doğrulayın — VS Code’da veya github.com’da model selector’da görünüyor mu?

- Ekibinize duyurun — ciddiye alın bunu, çünkü çoğu developer changelog takip etmiyor.

GPT-5.3-Codex Gerçekten Daha İyi Mi?

Aslında, İşin aslı şu ki — ben henüz GPT-5.3-Codex’i yeterince uzun süreli test edemedim. Ama ilk izlenimlerim karışık. Bir haftalık kullanımda gördüklerim:

Kod tamamlama hızı baya iyi. GPT-5.1-Codex-Max’e kıyasla latency düşmüş gibi hissettiriyor. Ama — dur bir saniye, önce şunu söyleyeyim — “hissettiriyor” dedim çünkü bilimsel bir benchmark yapmadım henüz. Subjektif izlenim bu.

Inline edit önerilerinde kalite artmış gibi görünüyor. Mesela TypeScript ve Python’da daha tutarlı öneriler geliyor. C# tarafında işe… hmm, bir düşüneyim… Evet, biraz daha agresif refactoring önerileri yapıyor. Bu iyi bir şey mi? Bazen evet, bazen hayır. Geçen gün basit bir null check eklememi önerdi ama bunu yaparken metodun yarısını yeniden yazmaya kalktı. Abartma dostum, sadece null check istedim!

Şahsen, Agent mode’da işe fark edilir bir iyileşme var. Daha uzun context window’u var gibi — büyük dosyalarda kaybolmuyor artık. Bu kısım güzel.

Açık konuşayım: Model geçişleri her zaman bir adaptasyon süreci gerektirir. İlk birkaç gün “eskisi daha iyiydi” hissedebilirsiniz. Bu normal. Bir-iki hafta verin, prompt’larınızı ayarlayın, sonra karar verin.

Workflow ve Entegrasyonlarınızı Güncellemek

Eğer Copilot’u sadece VS Code’da chat olarak kullanıyorsanız, bir şey yapmanıza gerek yok (en azından benim deneyimim böyle). Model selector’dan yeni modeli seçin, devam edin. Ama eğer daha karmaşık entegrasyonlarınız varsa — mesela Copilot SDK üzerinden custom agent’lar yazdıysanız — işler değişiyor. Google Vids’e Gelen Yapay Zekâ Hamlesi: Ücretsiz Video Üretimi yazımızda bu konuya da değinmiştik.

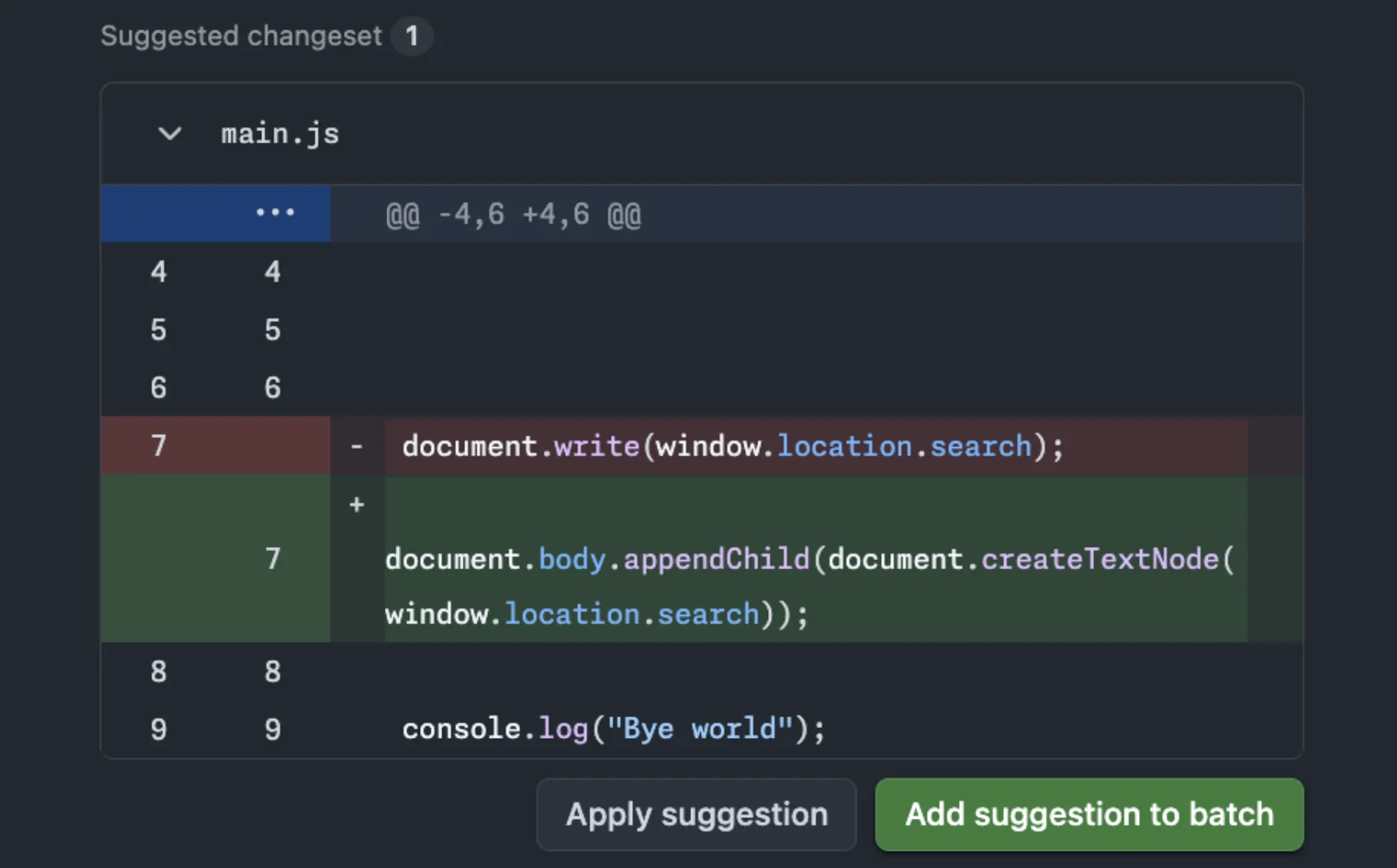

Logosoft’ta geçen ay bir müşterimiz için Copilot SDK ile issue triage agent’ı kurmuştuk. Bu agent GPT-5.1-Codex-Max kullanıyordu çünkü daha kapsamlı analiz yapmasını istiyorduk. 1 Nisan’da tabii ki patladı. Kod tarafında değişiklik şöyle basit:

// Eski ayar

"copilot.model": "gpt-5.1-codex-max"

// Yeni ayar

"copilot.model": "gpt-5.3-codex"Bu kadar mı? Çoğu durumda evet. Ama dikkat edin — GPT-5.3-Codex’in response formatı biraz farklı olabiliyor. Eğer yanıtı parse ediyorsanız, test edin. Ben bunu zor yoldan öğrendim. Agent’ımız JSON formatında yanıt bekliyordu, yeni model bazen markdown wrapper ekliyordu. Küçük bir şey ama CI’ı kırmaya yetti. Bu konuyla ilgili GitHub Issues Araması Değişti: Artık Anlamla Buluyor yazımıza da göz atmanızı tavsiye ederim. Daha fazla bilgi için GitHub Copilot Cloud Agent İçin Runner Kontrolü: Kurumsal Düzen yazımıza bakabilirsiniz.

Ha bu arada, eğer Copilot SDK ile ajan geliştirme konusu ilginizi çekiyorsa Copilot SDK: Ajanları Kendi Uygulamana Taşırken Ne Değişiyor? yazıma bakmanızı öneririm. Orada SDK’nın temellerini anlatmıştım.

Model Deprecation Döngüsüne Nasıl Hazırlıklı Olunur?

Bence, Bu deprecation olayı ilk değil, son da olmayacak (evet, doğru duydunuz). Hatta giderek hızlanıyor. 2024’te model ömrü ortalama 8-10 aydı. 2025’te 6 aya düştü. Şimdi 2026’da bazı modeller 4-5 ay sonra emekliye ayrılıyor. İlginç, değil mi? Bu hız artışı beni biraz tedirgin ediyor.

Neden? Çünkü enterprise ortamlarında her model değişikliği bir değişiklik yönetimi süreci demek. Change advisory board’lar, test döngüleri, regression testleri… Bir bankada model güncellemek, startup’ta model güncellemekle aynı şey değil. 2019’da kendi hosting şirketimde bir yazılım versiyonu değişikliği yapardım, 10 dakikada biterdi. Şimdi kurumsal bir müşteride aynı işlem — tamam abartmayayım ama — haftalar sürebiliyor. Bu konuyla ilgili C# 15’te Union Types: Eksik Parça Nihayet Geldi yazımıza da göz atmanızı tavsiye ederim.

Şimdi gelelim işin can alıcı noktasına.

Pratik Önerilerim

Yılların deneyiminden süzülmüş birkaç taktik:

- Model adını hardcode etmeyin. Environment variable veya config dosyasından okuyun. Bu şekilde tek bir yerde değiştirip tüm sistemi güncellersiniz.

- GitHub Changelog’u takip edin. RSS feed’e abone olun. Ciddi söylüyorum, çoğu sorun “haberimiz yoktu” cümlesinden kaynaklanıyor.

- Fallback mekanizması kurun. Birincil model çalışmazsa ikincil modele düşen bir yapı çok iş görüyor. Biz bunu bir telekomda uyguladık, sıfır downtime yaşadık geçişte.

- Her çeyrekte model policy review yapın. Enterprise admin’ler için bu artık zorunlu olmalı. — ciddi fark yaratıyor

Tuhaf ama, Bir de şunu ekleyeyim: Copilot’un kurumsal tarafında firewall ve kontrol mekanizmaları giderek olgunlaşıyor. Bu konuda Copilot Cloud Agent İçin Kurumsal Firewall: Kontrol Sizde yazıma göz atabilirsiniz — orada network tarafındaki kontrol noktalarını detaylıca anlattım.

Mini ve Max Ayrımının Kalkması Ne Anlama Geliyor?

Bu kısım benim en çok kafa yorduğum yer. Eskiden üç katmanlı bir yapı vardı: Daha fazla bilgi için Gemini API’de Maliyet ve Hız Dengesi: Flex ile Priority yazımıza bakabilirsiniz.

- Mini: Hızlı, hafif, basit kod tamamlamaları için.

- Standard: Genel amaçlı, dengeli.

- Max: Ağır işler, karmaşık refactoring, büyük context.

Şimdi hepsi tek model: GPT-5.3-Codex. Bu ya çok iyi bir şey ya da sessizce bir şeylerin kısılması anlamına geliyor. İyimser bakarsam — belki GPT-5.3 öyle bir noktaya geldi ki Mini’nın hızını ve Max’in derinliğini aynı anda sunabiliyor. Kötümser bakarsam — belki maliyet optimizasyonu yapıyorlar ve tiering’i kaldırmak daha kolay yönetiliyor.

Beklediğim kadar net bir cevap yok henüz. GitHub’ın blog yazısı bu konuda tamamen sessiz — “Use GPT-5.3-Codex” diyor, nokta. — Neden tek model? Performans farkı ne? Mini kullanıcıları latency artışı yaşayacak mı — Bu soruların hiçbirine cevap yok (inanın bana). Bu biraz hayal kırıklığı yarattı bende açıkçası.

Kullanım Metriklerini Takip Edin

Yanı, Model geçişinden sonra yapmanız gereken en önemli şeylerden biri: kullanım metriklerini izlemek. Developer’larınız yeni modele geçti mi? Productivity düştü mü arttı mı? Copilot’un önerilerini kabul etme oranı değişti mi?

İtiraf edeyim, GitHub son dönemde kullanım ölçümleri tarafında bayağı ilerleme kaydetti. Eğer Copilot CLI kullanımını kişi bazında takip etmek istiyorsanız, GitHub Copilot CLI Kullanımını Artık Kişi Bazında Görmek Mümkün yazımda bunu detaylıca anlattım.

2025 sonunda bir yazılım ekibinde model geçişi sonrası metrikleri izledik (ciddiyim). İlk hafta acceptance rate %15 düşmüştü — İkinci haftada eski seviyeye döndü. Üçüncü haftada eski seviyenin %8 üstüne çıktı. Yanı — sabır. İlk gün “bu model kötü” demeyin. Developer’lar alışıyor, model de context’i öğreniyor bir nevi.

Sıkça Sorulan Sorular

GPT-5.1-Codex modellerini hâlâ kullanabilir mıyım?

Hayır. Bakın, 1 Nisan 2026 itibarıyla bu modeller tüm Copilot deneyimlerinden kaldırıldı. Model selector’da artık görünmüyorlar. GPT-5.3-Codex’e geçmeniz gerekiyor.

Enterprise admin olarak ne yapmam gerekiyor?

Copilot Settings’teki model policy’lerinizi kontrol edin — GPT-5.3-Codex’in organizasyonunuz için aktif olduğundan emin olun. Aksi halde developer’larınız yeni modeli göremez ve Copilot’u kullanamaz hâle gelir.

GPT-5.3-Codex, Mini ve Max’in yerini tek başına alabilir mi?

GitHub’ın resmî önerisi bu yönde. Ancak Mini’nın düşük latency avantajını ve Max’in geniş context window’unu tek modelde ne kadar iyi sunduğu henüz net değil. İlk testlerimde genel performans tatmin edici görünüyor ama uzun vadeli karşılaştırma yapmak için erken.

Deprecated modelleri silmem gerekiyor mu?

Hayır, GitHub bunları otomatik olarak kaldırıyor. Sizin yapmanız gereken tek şey workflow’larınızda ve config dosyalarınızda model adını GPT-5.3-Codex olarak güncellemek.

Sonraki deprecation ne zaman olacak?

Bunu kesin olarak bilmek mümkün değil ama son trendlere bakarsak model ömrü 4-6 ay civarında seyrediyor. GitHub Changelog ve blog’u düzenli takip etmenizi şiddetle tavsiye ederim.

Kaynaklar ve İleri Okuma

GitHub Blog — GPT-5.1 Codex Deprecation Duyurusu

GitHub Docs — Copilot’ta Kullanılabilir AI Modelleri

GitHub Docs — Copilot Enterprise Model Policy Yönetimi

İçeriği paylaş:

📬 Bu yazıyı faydalı buldunuz mu?

Azure, DevOps ve bulut teknolojileri hakkında güncel içerikler için beni takip edin!

Emre Ç.

Tam geçiş sürecindeyken böyle bir yazı çok iyi oldu, ben de Copilot Chat’te bazı tuhaflıklar fark etmiştim son zamanlarda, sebebi buymuş demek. GPT-5.3-Codex geçişi ne kadar sorunsuz olur acaba, önceki nesil geçişlerde sıkıntı yaşayanlar olmuştu. Bu arada şu yazınız da güzeldi: Entra External ID’de Sosyal Giriş: Native Auth GA Oldu — https://www.askinkilic.com.tr/entra-external-idde-sosyal-giris-native-auth-ga-oldu/

Deniz R.

Codex geçişini duyunca hemen kontrol ettim, neyse ki henüz büyük bir sorun yaşamadım ama agent mode’u yoğun kullananlar için sancılı olabilir bu süreç. GPT-5.3’e geçişi ertelemeden yapmak mantıklı görünüyor. Bu arada OpenAI’ın stratejik adımlarını merak edenler için şu yazı da ilginç: https://www.askinkilic.com.tr/openai-neden-bir-medya-sirketi-satin-aldi-tbpn/

Koray M.

Biz henüz 5.1’e tam alışamadan 5.3 kapıda, biraz hızlı gitmiyor mu bu geçişler? Inline edits tarafında sorun yaşayanlar olursa buraya yazarsa iyi olur, merak ediyorum pratikte ne kadar pürüzsüz geçiyor.

3 comments