Geçen hafta bir müşteride tam da bu konuyu tartıştık. Finans tarafında çalışan ekip, “Copilot rahatlatıcı. Veri nereye gidiyor?” diye sorunca sohbet bir anda teknik olmaktan çıktı, güvene geldi. İşin aslı şu ki, AI araçlarında performans kadar veri politikası da kritik. Hatta bazen daha kritik.

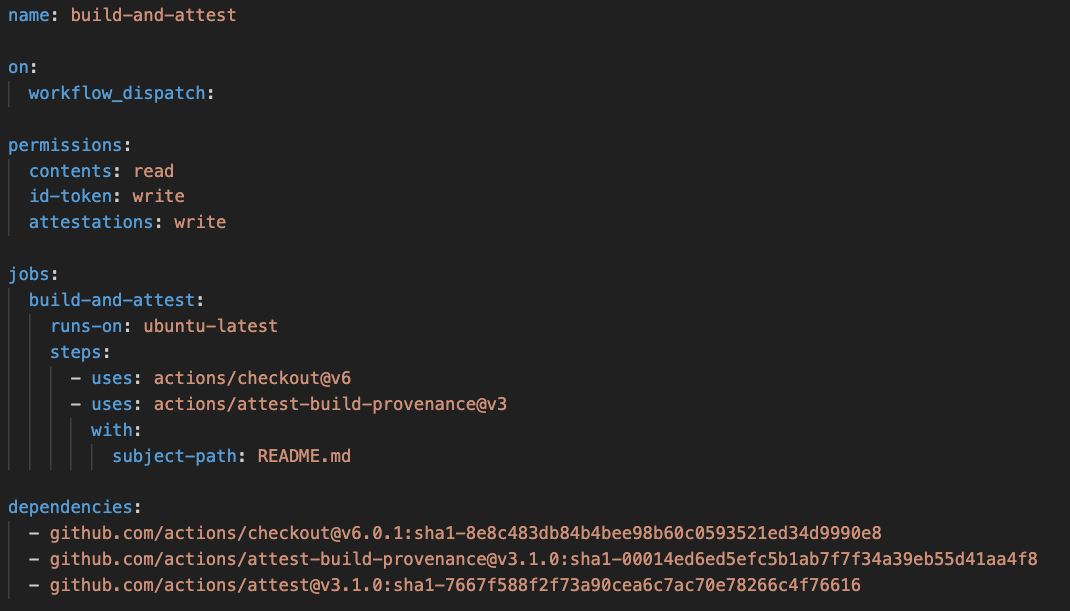

Şahsen, GitHub’ın Copilot için yaptığı son güncelleme de tam buraya dokunuyor. Kısaca söyleyeyim: Free, Pro. Pro+ kullanıcılarının etkileşim verileri, aksi seçilmezse model eğitimi ve iyileştirmesi için kullanılacak. Business ve Enterprise işe bu değişikliğin dışında kalıyor. Yani küçük ekiplerle büyük kurumsal yapılar arasında çizgi netleşmiş durumda. Bu ayrım bana 2019’da bir kamu projesinde yaşadığımız lisans/gizlilik tartışmasını hatırlattı; kağıt üstünde ufak görünen farklar pratikte bayağı büyük sonuç doğuruyor.

Copilot’ta asıl mesele sadece “kod yazdırmak” değil; hangi verinin hangi amaçla işlendiğini net anlamak. Güven yoksa hız da kısa sürüyor.

Bu güncelleme ne diyor, ne demiyor?

Şimdi gelelim işin özüne. GitHub burada “etkileşim verisi” dediği şeyleri topluca tanımlıyor: Copilot’a gönderdiğiniz girdiler, üretilen çıktılar, kabul ettiğiniz ya da değiştirdiğiniz kod parçaları, cursor çevresindeki context, yorumlar, dosya adları, repo yapısı ve geri bildirimler gibi detaylar… Bunlar modelin sizi daha iyi anlaması için kullanılacak.

Ben bunu çoğu zaman araba navigasyonuna benzetiyorum. Navigasyon sizi gideceğiniz yere götürmek için nerede olduğunuzu bilmek zorunda. Copilot da benzer şekilde kodun bağlamını görmek istiyor. Ama işte — dur bir saniye — her navigasyon sistemi aynı güven seviyesinde çalışmıyor. Kurumsal tarafta asıl soru şu: Bu veri sadece hizmeti çalıştırmak için mi kullanılıyor, yoksa modele de gidiyor mu? Yeni politika bu soruya açık cevap veriyor.

Garip gelecek ama, Ha bu arada önemli bir nüans var: Private repository içeriği “at rest” iken eğitimde kullanılmıyor denirken aslında aktif kullanım sırasında Copilot’un kodu işlemesi gerekiyor. Hizmet vermek için belli ölçüde işlem kaçınılmaz oluyor. Buradaki fark ince ama önemli. Bu ne anlama geliyor? Güvenlik mimarisi kurarken hep söylediğim şey şu olur: Veri akışını görmeden politika yazmayın.

Bir dakika — bununla bitmedi.

Etkilenmeyenler kimler?

Bir şey dikkatimi çekti: Copilot Business ve Copilot Enterprise kullanıcıları bu güncellemenin dışında tutuluyor. Enterprise-owned repository’ler de kapsam dışı. Açık konuşayım, bu kurgu beni şaşırtmadı; büyük kurumlarda uyum. Sözleşmesel yükümlülükler yüzünden böyle sınırlar olması gerekiyor zaten.

Yani, Logosoft’ta geçen yıl bir üretim firmasında yaptığımız değerlendirmede aynı tabloyu gördük. Geliştirici ekip hızlı öneri istiyordu ama hukuk ekibi veri kullanımını sorguluyordu. Sonunda çözüm çok klasik oldu ama etkiliydi: kişisel plan yerine kurumsal plan, merkezî kontrol ve net istisnalar… Bazen en şık çözüm değil, en az sürpriz çıkaran çözüm kazanıyor.

Neden böyle bir değişiklik yapılıyor?

GitHub’ın anlattığı gerekçe basit gibi görünüyor: gerçek dünya etkileşim verisiyle modeller daha iyi oluyor. Ve dürüst olayım, bunda yalan yok. Ben AZ-305 sınavına (belki yanılıyorum ama) hazırlanırken bile mimarı örneklerde “gerçek kullanım senaryosu” ile laboratuvar örneğinin ne kadar farklı olduğunu defalarca gördüm. Model eğitimi de biraz öyle; kitap bilgisi başka şeydir, sahadaki karmaşa bambaşka.

Şimdi gelelim işin can alıcı noktasına. Bu konuyla ilgili Graph API ile E-posta İçeriği Artık O Kadar Esnek Değil: Neler Değişiyor, Kimler Dikkat Etmeli? yazımıza da göz atmanızı tavsiye ederim.

Aslında, Microsoft tarafında çalışanların etkileşim verilerinden elde edilen iyileşmelerden bahsediliyor; kabul oranlarının bazı dillerde yükseldiği söyleniyor — itiraf edeyim, beklentimin üstündeydi —. Bu kulağa güzel — kendi adıma konuşayım — geliyor çünkü çok dilli ekiplerde önerilerin isabeti gerçekten fark yaratıyor. Mesela Türkçe yorumla yazılmış karmaşık iş mantığını İngilizce isimlendirilmiş sınıflarla eşleştirmek… kolay iş değil.

Gel gelelim madalyonun diğer yüzü de var: Model iyileşsin diye daha fazla veri toplamak her zaman herkese iyi gelmeyebilir. Bilhassa regülasyonlu sektörlerde “iyi niyetli ürün geliştirme” tek başına yetmez; audit izi, erişim sınırı ve saklama politikası da lazım olur.

| Kullanıcı tipi | Etkilenir mi? | Pratik yorumum |

|---|---|---|

| Copilot Free | Evet | Küçük projelerde fayda sağlar ama gizlilik ayarı okunmalı |

| Copilot Pro / Pro+ | Evet | Bireysel geliştirici için performans artışı cazip olabilir |

| Copilot Business | Hayır | Kurumlar için daha güvenli çizgi |

| Copilot Enterprise | Hayır | Daha sıkı yönetişim isteyen ekipler için uygun |

Sahada bunun karşılığı ne oluyor?

Küçük bir startup düşünün; iki backend geliştirici, bir frontendci ve sürekli yetişmesi gereken teslim tarihleri var. Böyle bir yerde Copilot’un biraz daha akıllı hâle gelmesi ciddi avantaj sağlar çünkü hız doğrudan para demek oluyor (evet, klişe. Doğru). Kullanıcı tarafında opt-out seçeneği açık olduğu sürece tercih yönetilebilir görünüyor.

Büyük enterprise tarafında işe tablo değişiyor. Bir bankada ya da telekom operatöründe çalışıyorsanız mesele sadece üretkenlik değil; veri sızıntısı ihtimali bile ayrı başlık açtırır. Bir arkadaşım 2024’te Londra’daki bir SaaS şirketinde benzer bir AI policy revizyonu yaptı; ilk hafta herkes heyecanlıydı. Üçüncü haftada legal ekibin soruları başlayınca hava biraz soğudu… beklediğim kadar değildi doğrusu. Bu konuyla ilgili Açık Kaynak Güvenlik Açıkları: 2025’te Neler Değişti, Ne Anlama Geliyor? yazımıza da göz atmanızı tavsiye ederim.

Kısa bir not düşeyim buraya. Bu konuyla ilgili github konusundaki yazımız da göz atmanızı tavsiye ederim.

Neyse uzatmayalım: enterprise dünyasında en değerli şey çoğu zaman hız değil kontrollü hızdır. Bir dakika, şunu da ekleyeyim:

kurumlar genelde “özellik iyi mi?” diye bakmaz,

“yarın denetimde başımıza iş açar mı?” diye bakar. İşte o yüzden Business/Enterprise — ki bu tartışılır — dışarıda bırakılmış olması bence yerinde olmuş. Kağıt üstünde süper görünse de pratikte aksi halde büyük gürültü çıkardı. Bu konuyla ilgili GitHub Actions’da Özel Runner İmajları: Kontrol Artık Sizde! yazımıza da göz atmanızı tavsiye ederim.

Açık rıza mı, varsayılan paylaşım mı?

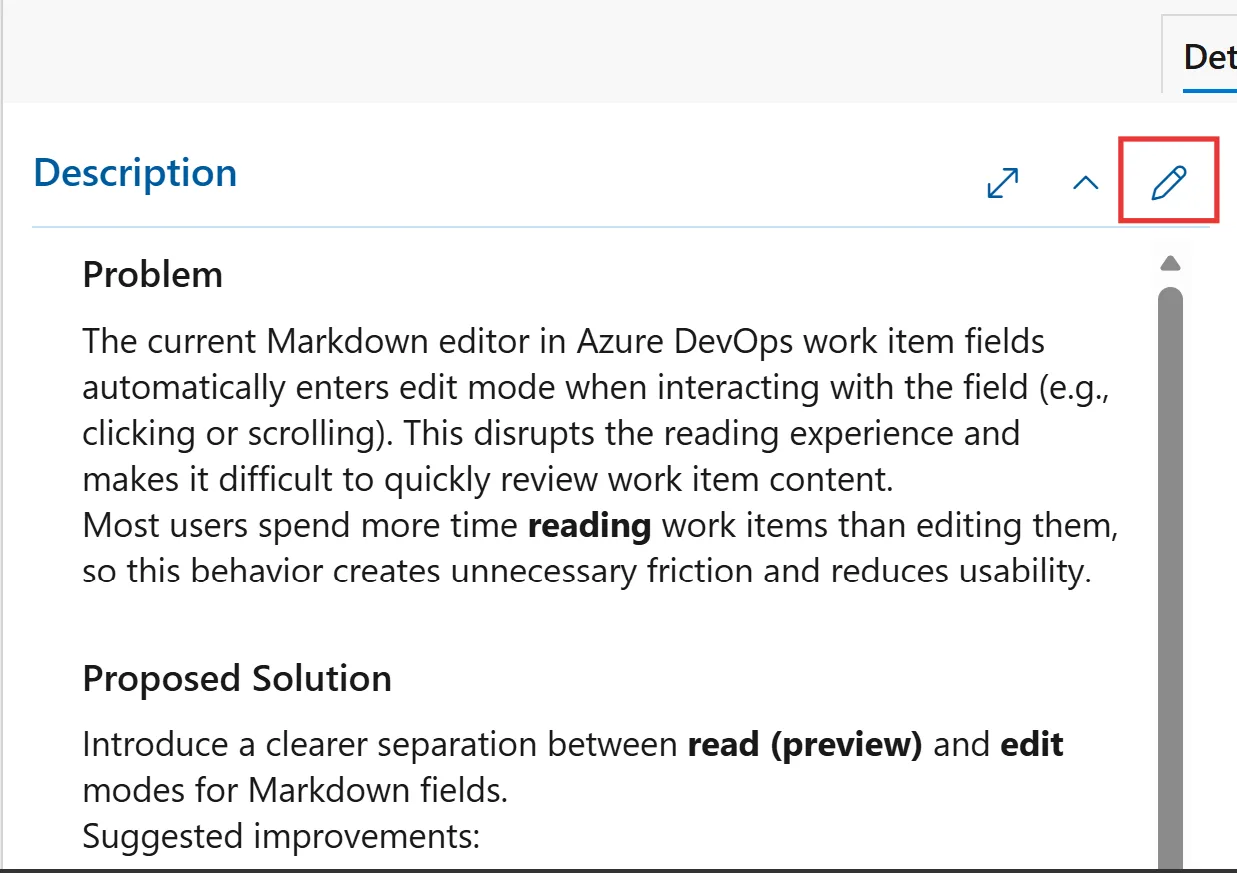

Açıkçası, Burası biraz can sıkıcı olabilir çünkü kullanıcı deneyimi açısından varsayılan davranış her zaman temiz algılanmaz. İnsanlar çoğu zaman ayar ekranına (söylemesi ayıp) girmez; yani karar sessizce verilmiş gibi hissedilir. O yüzden GitHub’ın opt-out mekanizmasını görünür tutması önemli ama yeterli mi? Tartışılır (şaşırtıcı ama gerçek)

Açık konuşayım ben her AI ürününde varsayılan ayarın şeffaf anlatılmasından yanayım (özellikle geliştirici kitlesine hitap ediyorsa). Çünkü geliştiriciler küçük puntoları okumasa bile logları okur… sonra gelir sana sorar zaten.

Peki biz bunu nasıl okumalıyız?

Aslında, Bence burada üç ayrı ders var.

İlki şu: AI araçlarını değerlendirirken sadece çıktı kalitesine bakmayın.

İkincisi:

veri politikasını büyük ihtimalle okuyun.

Üçüncüsü işe en önemlisi—kurumunuzun kullanım modeli bireysel planlarla çakışıyorsa işi büyütmeden önce netleştirin. Bu konuyla ilgili GitHub Credential Revocation API ile Sızıntılara Anında Fren: Yeni Destekler ve Gerçek Hayat Senaryoları yazımıza da göz atmanızı tavsiye ederim.

- Bireysel geliştiriciyseniz: Ayarlarınızı kontrol edin, opt-out ihtiyacınızı değerlendirin.

- Küçük ekipseniz: Kod gizliliği ile hız arasındaki dengeyi konuşun. (bence en önemlisi)

- Kurumsal taraftaysanız: Copilot Business/Enterprise seçeneklerini masaya koyun. (bence en önemlisi)

- Sektörünüz regülasyona tabiyse: Legal ve security ekibini baştan dahil edin.

Müşteri toplantılarında sık gördüğüm hata şu oluyor: ekip önce aracı seviyor, sonra güvenlik ekibi frene basıyor. Halbuki tersi olmalıydı — önce çerçeve çizilmeli sonra kullanım yaygınlaştırılmalıydı. Logosoft’ta Azure danışmanlığı verirken özellikle bunu vurguluyorum çünkü bulutta olduğu gibi AI’da da yanlış sırayla yapılan işler sonradan pahalıya patlıyor.

Copilot’un dayanıklı yani ne?

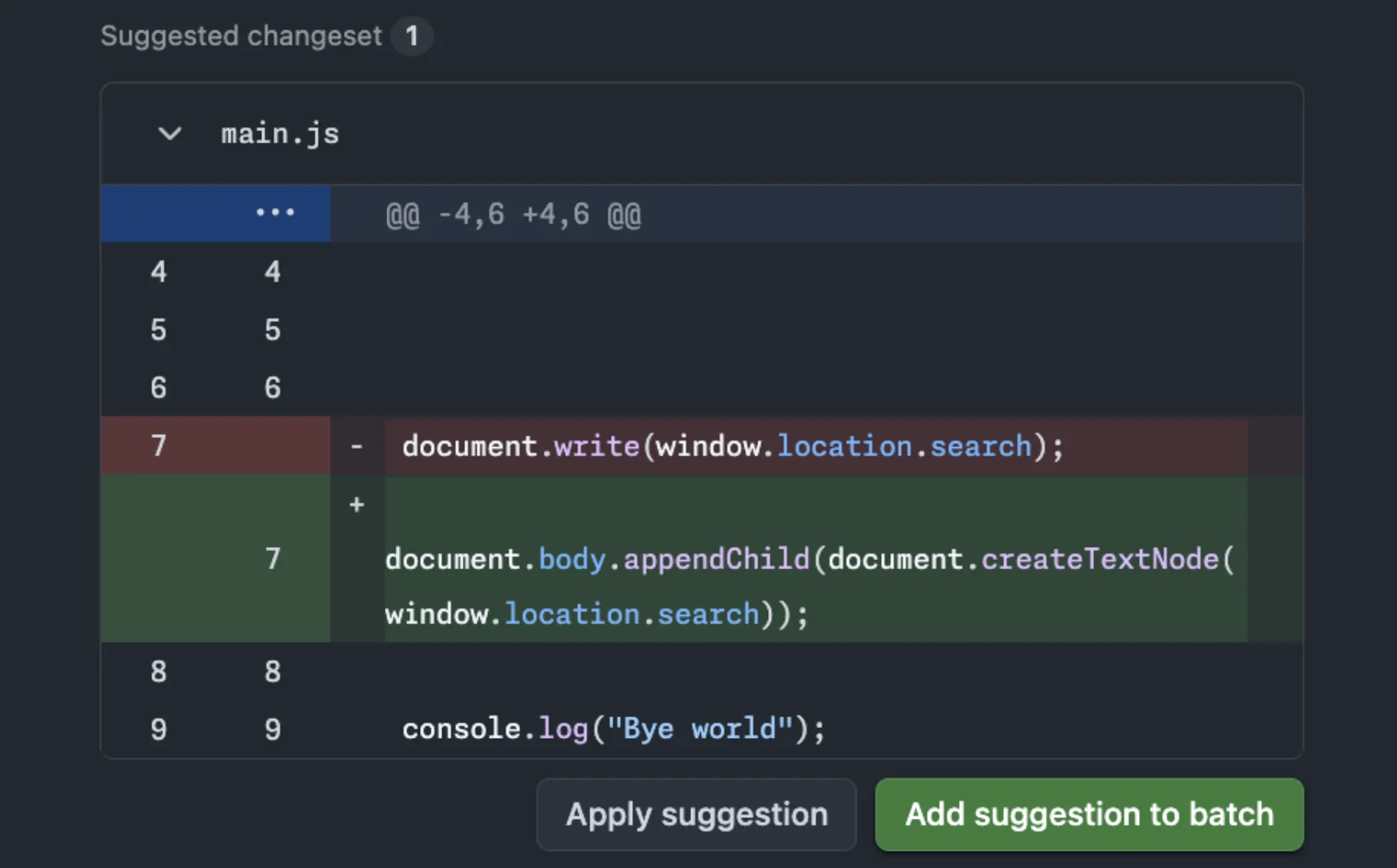

Copilot’un güçlü yani hâlâ bağlam yakalama kabiliyetiyle zamandan kazandırmasıdır. Mesela tekrar eden pattern’lerde baya işe yarıyor; test iskeleti çıkarmak, küçük refactor yapmak ya da yeni gelen arkadaşın repo yapısını anlamasına yardım etmek gibi alanlarda fena değil.

Ama zayıf tarafını da söyleyeyim: öneri kalitesi bazen aşırı özgüvenli olabiliyor! Hele karmaşık domain logic olan projelerde yanlış ama düzgün görünen kod üretebiliyor (en tehlikeli tür). O yüzden gözden geçirme alışkanlığını bırakmak yok…

// Basit yaklaşım

if (copilotSuggestion != null)

{

Review(copilotSuggestion);

Test(copilotSuggestion);

Decide();

}

else

{

KeepCoding();

}Bana göre asıl soru ne?

Tartışmayı “veri toplanıyor mu?” seviyesinde bırakınca eksik kalıyoruz.

Asıl soru şu:

Bu veri kimde kalacak,

hangi koşulla kullanılacak,

hangi müşteri segmenti bundan muaf olacak,

ve kullanıcı isterse gerçekten kolayca geri çekebilecek mi?

Copilot politikasındaki güncelleme bana biraz FinOps disiplinini hatırlatıyor aslında; maliyet yönetimi sadece faturayı kısmak değildir, hangi kaynak neden kullanılıyor önü anlamaktır. Aynısı veri yönetişimi için de geçerli olabilir artık yavaş yavaş…

Sıkça Sorulan Sorular

Copilot Free kullanıcıları bu değişiklikten etkileniyor mu?

Evet, etkileniyorlar. Opt-out yapılmadığı sürece interaction data model eğitimi için kullanılabiliyor.

Copilot Business veya Enterprise kullanıcıları kapsama giriyor mu?

Hayır, bu güncelleme onları kapsamıyor. Kurumsal planlar bu değişikliğin dışında tutulmuş durumda.

Daha önce veri paylaşımını kapattıysam tekrar açmam gerekir mi?

Hayır gerekmez sanırım; mevcut tercihiniz korunuyor deniyor.. Yani yeniden opt-in yapmadığınız sürece veriniz eğitimde kullanılmıyor.

Neleri topluyorlar?

Açık konuşayım, Kod girdileri/çıktıları, kabul edilen ya da düzenlenen öneriler, context bilgisi, dosya adları ve geri bildirimler gibi etkileşim sinyalleri toplanabiliyor.

Kurum olarak ne yapmalıyız?

Lisans tipinizi kontrol edin ve gerekiyorsa Business/Enterprise planlarını değerlendirin. Ayrıca security ile legal ekiplerini erken dahil etmek iyi fikir olur.

İçeriği paylaş:

📬 Bu yazıyı faydalı buldunuz mu?

Azure, DevOps ve bulut teknolojileri hakkında güncel içerikler için beni takip edin!

Yorum gönder