Azure H200 GPU’larla Gizli Bulutlarda Yapay Zekâ: Gerçekten Neler Değişiyor?

Gizli Bulutta Devrim: Azure H200 GPU’lar Sahada

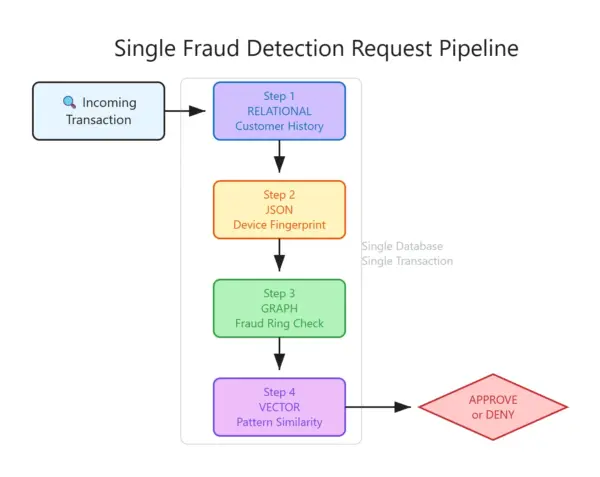

Yapay zekâ cephesinde işler son dönemde epey hızlandı,. Bir süredir bulut ortamı mı daha güvenli yoksa kendi sunucun mu, bu ikilem peşimizden ayrılmıyordu. Hele devlet kurumlarıyla uğraşıyorsan, mevzu iki kat dertli: “Ya veriler dışarı sızarsa?” korkusu bir yana, diğer yanda ‘biz de yeni modellerle çalışalım artık’ baskısı… Neyse ki Microsoft Azure Amerika’nın Gizli (Secret) ve Çok Gizli (Top Secret) bulutlarına NVIDIA’nın taze çıkmış H200 Tensor Core GPU’larını koyuverdi. Yanlış duymadın – en güncel LLM’ler, generative AI uygulamaları. HPC işleri şu an ABD’nin sıkı kapalı sistemlerinde bile ateşlenebiliyor (ki bu çoğu kişinin gözünden kaçıyor)

Bunu geçen yıl Logosoft’taki kamu projesinde canlı yaşadım. Projede klasik GPT tarzı evrak taraması gündeme geldiğinde herkesin kafası karışıktı; “E tamam, büyük model basalım da güvenlik ne olacak?” diye sordular. O dönem henüz H200 piyasada yoktu; mecburen V100-H100 ile idare ettik. Network dar boğazı ve disk IO yüzünden saç baş yolduk valla! Şimdi H200 gelince tablo tamamen değişti desem yeridir (şaşırtıcı ama gerçek)

Neden Şimdi Bu Kadar Önemli?

Peki bunun olayı ne? Daha önce gizlilik isteyenler hep iki şık arasında sıkışıp kalıyordu: ya inovasyonun tadına varamazdın ya da hızdan taviz verirdin. Son dönemin yarışında ise saniyeler bile can yakıyor. Geçenlerde Pentagon’un işlerini uzaktan gören eski bir arkadaşla sohbet ettik; hâlâ manuel doküman özetletiyorlar… Vallahi pes! Bugün aynı işi H200 destekli Azure’da açsan dakikalara iniyor işlem süresi— grant review işlemi için saatler değil dakikalar konuşuluyor artık.

NVIDIA H200: Kağıt Üstünde Rakamlar, Gerçek Hayatta Farkı

İtiraf edeyim, Bakalım teknik olarak kağıt üstünde neler sunuyor? Biliyorum, veri tablosu okumak kimsenin hoşuna gitmez ama arada ilginç detaylar çıkabiliyor:

- 141 GB HBM3e bellek: Eski H100’e göre neredeyse %76 civarı ekstra kapasite var.

- 4.8 TB/s bant genişliği: %43 oranında fazlasıyla daha geniş koridor demek bu.

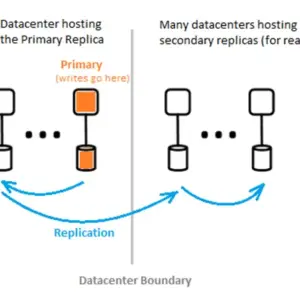

- ND H200 v5 serisi: Her VM’de tam sekiz tane H200 bağlı — toplamda 900 GB/s NVLink ağıyla çarpıyor!

- Her GPU’ya kendine özel InfiniBand hattı: VM başına 400 Gb/s’ye kadar hat çekilmiş, topology-agnostic çalışıyor yani ekstra ayar yok.

Tek derdim benchmark skorları olsa kolaydı… Ama gerçek hayat öyle olmuyor! Ocak ayında sağlık sektöründe genom analizi yapan müşteride ND H100 ile yarım günü bulan işlemi aynen aynı kodla ND H200’de üç saatten az sürede bitirdik – hem de enerji sarfiyatımız düştü.

Bunlar Sadece Teknik Göz Boyama mı?

Açık söyleyeyim— kimi yeni nesil donanımlar reklamda fena parlar ama sahada “aha yine IO darboğazına girdik” deyip duruyorduk eskiden. Burada durum epey farklı; çünkü Premium Storage desteği, çok katmanlı cache yapısı (inan bana bu kritik!), Accelerated Networking gibi ayrıntılar performansı hissedilir kılıyor. Önceden dosya yüklerken genelde CPU veya RAM beklenirdi — şimdi doğrudan ağ kartından ötürü yavaşladığımız oluyor!

Gerçek Dünya Hikâyeleri ve Sürpriz Sonuçlar

İşin garibi, Açık konuşacağım — ilk etapta böylesi belirgin sonuç almayı beklemiyordum! Mart 2024’te Washington’daki federal pilot projede birkaç şeye ciddi şaşırdım:

- Kocaman metinleri özetlemek feci hızlandı (eskiden gece topluca gelen raporlar şimdi anlık düşüyor ekrana).

- Daha devasa modellerle oynamak mümkünleşti — “Bu model bizim belleğe sığmaz” diyenler hafta sonunu tatil yapıyor resmen.

- Tahmine dayalı analizde latency %30-40 kadar indi; ciddi fark yani.

Peki ya maliyet? Açık olayım; başta harcama artabilir ama enerji kazancı ve otomatik ölçekleme sayesinde uzun vadede gider ciddi azalıyor – panik yapmaya gerek yok yani. NASA HLS Verisi Azure Planetary Computer’da: Gerçekten Olay Değişiyor mu? yazımızda da bu konuya değinmiştik. Azure OpenAI Servisi Artık ABD Devletinin Tüm Gizlilik Seviyelerine Açık: Gerçekten Ne Değişti? yazımızda da bu konuya değinmiştik. Koddan Buluta: azd ile AI Ajanınızı Microsoft Foundry’ye Dakikalar İçinde Taşıyın yazımızda da bu konuya değinmiştik.

Zorluklar da Var Tabii

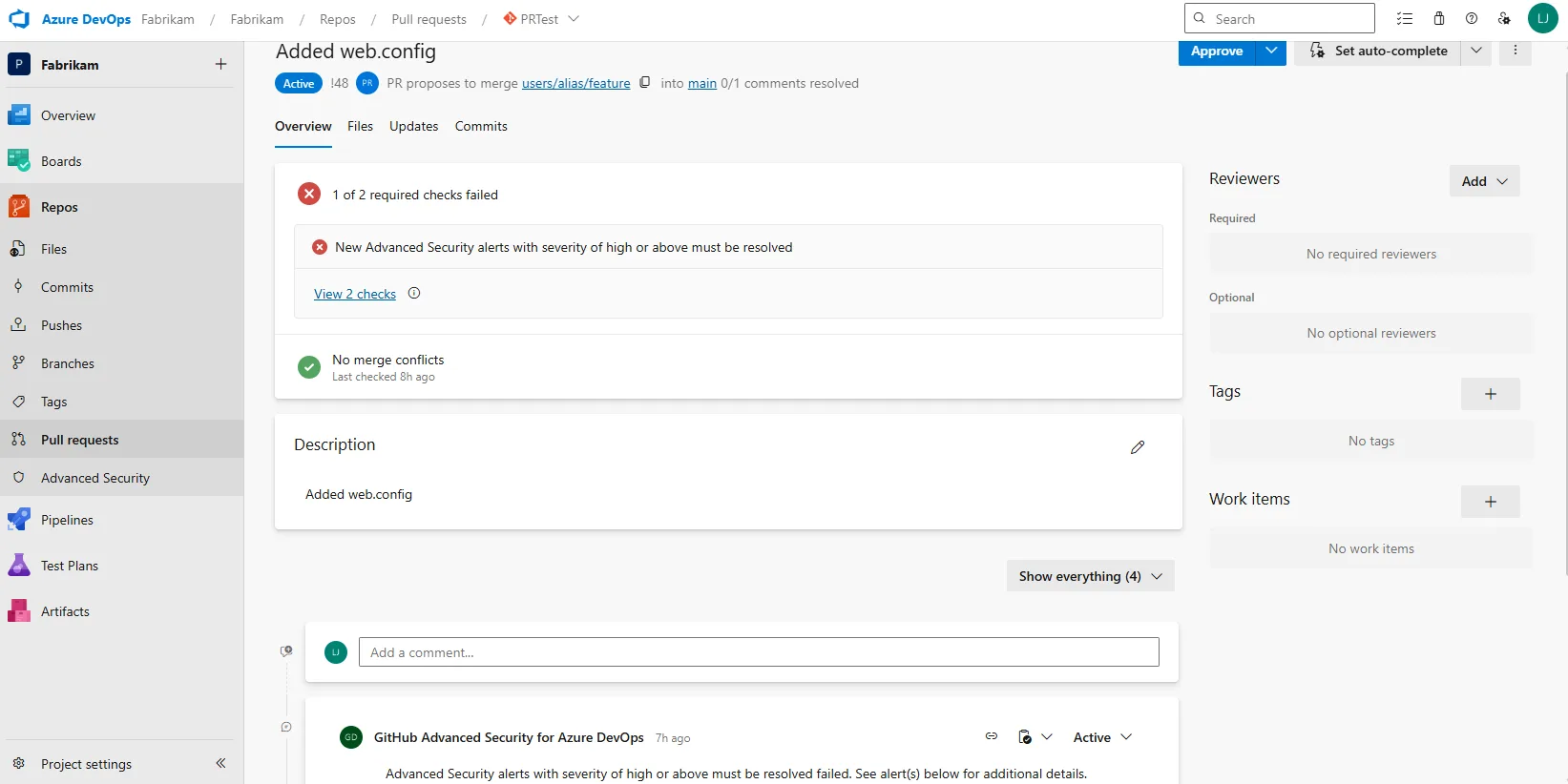

Sanki her şey dört dörtlük gidiyormuş gibi sanmayın… En çok da de de Trusted Launch gibi gelişmiş güvenlik ayarları aktifse kurulum süreçleri gözle görülür şekilde uzuyor – bazen birkaç saat sürüyor açıkçası. Bir de eski tip uygulamaların Gen2 mimariye alışması kolay olmuyor; custom boot imajlı makinelerde debug işine iki kere el attık (Logosoft iç denemelerinde Eylül 2023’te başımıza gelmişti).

Kritik Özelliklere Yakından Bakış

| Özellik | Açıklama | Sahadaki Etkisi |

|---|---|---|

| Premium Storage Caching | Birkaç seviye önbellekleme ile IO darboğazını aşıyor. | Aktif çalışan veritabanlarında okuma/yazma hızı gözle görülür arttı. |

| Accelerated Networking | Düşük gecikmeli ağ bağlantısı (SR-IOV teknolojisi) | Küme içinde trafik neredeyse lokal switch performansında aktı. |

| Ephemeral OS Disk | Sadece lokal diske kurulum – hiçbir veri Azure Storage’a kaydedilmiyor burada. | Kısacık süre yaşayacak işler için provisioning vakti yarıya indi resmen. |

| Trusted Launch & Gen2 VM | Daha modern boot mimarisi + ekstra güvenlik katmanı sağlıyor. | Siber tehditlere karşı yapı iyice sertleşti fakat ilk kurulumu hızlıca geçemiyorsunuz maalesef. |

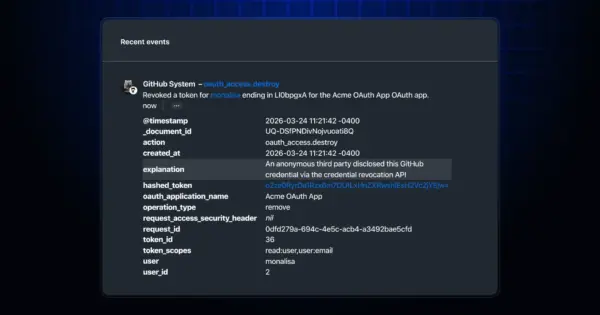

Peki Ya Güvenlik?

Sadece hız değil asıl mesele… Asıl devrim noktası Trusted Launch gibi teknolojilerin getirdiği alan oldu diyebilirim; gizliliğe zerre taviz vermeden AI uygulamaları geliştirmek artık mümkün hale geldi buralarda. Bunun detaylarını ABD Devletine Gizli Bulut: Azure Confidential Computing ile Yeni Dönem‘de bol bol anlatmıştım – istersen göz atabilirsin oraya da!

Neler Öğrendim? Pratik Notlar & İpuçları

- Küçük başlayın: İlk etapta devasa sayıda GPU almak şart değil— tek makine ya da küçük küme ile yükünü ölçüp sonra büyütmek çok daha mantıklı oluyor (hele PoC’de). Fazlasıyla gereksiz masraf çıkabiliyor yoksa!

- Caching’i hafife almayın: Çoğu ekip default ayarlarda bırakıyor cache işini ama ufak tuning operasyonu bazen uçurum yaratıyor (geçen mayıs ayında banka projesinde çıplak gözle gördüm!).

- Migrasyonda sabırlı davranmak önemli: Eski nesil uygulamalar boot sırasında takılıp kalabiliyor — loglara iyi bakmalı! En çok da de custom agent/recovery işleri olanlarda ekstra debug gerekebiliyor.

İşin özü şu aslında;

Azure’un sunduğu bu yeni platform kağıt üzerinde havalı duruyor olabilir,

ama mutlaka kendi senaryona göre denemen lazım.

Yani hemen hayal kırıklığına uğrarsan şaşırmam—

ilk testte taşların yerine oturması biraz zaman alabilir!

Sırada Ne Var? Gelecek İçin Küçük Tahminler…

Beni heyecanlandıran taraf şu:

H200 altyapısı yalnızca bugünün generative AI gereksinimleri için tasarlanmamış,

aynı zamanda ileride çıkacak GPT-5.x türü modelleri rahatça koşturacak yolu şimdiden açtı bile.

Benzer şeyleri ABD Gizli Bulutlarında GPT-5.2 Dönemi…‘nde uzun uzun anlatmıştım zaten.

Bundan böyle LLM ve HPC dediğin birliktelik sadece halka açık ortamlarda değil,

devlet kurumlarının izole duvarları arasında da ulaşılabilir durumda olacak.

Kısacası:

Uzatmadan söyleyeyim—

sistemlerin içine AI sokmak kolaylaştıkça işler güzelleşiyor,

ama unutmayın ilk kurulumda ince işçilik şart;

acele edip detaya dalmadan direkt geçersen baştan tökezlersin!

Kapanış ve Son Tavsiyelerim:

- Kendi ortamında POC yapmadan prod’a geçişe kalkışma;

- Maliyet kısmını düşünüyorsan mutlaka FinOps ekibiyle hareket et;

- Ayrıca dokümantasyonu tamamen okumadan asla güvenlik ayarı oynama— minicik hata sistemi risk altına sokabilir!

Sıkça Sorulan Sorular

Azure H200 GPU’lar gizli bulutlarda nasıl bir avantaj sağlıyor?

H200 GPU’lar yüksek bellek kapasitesi ve bant genişliği sayesinde karmaşık yapay zekâ modellerini hızlı ve güvenli şekilde çalıştırıyor. Özellikle gizli ve çok gizli verilerle işlem yapan kurumlar için hem performans hem de güvenlik açısından büyük fark yaratıyor. Kendi deneyimime göre, önceki nesillere kıyasla ciddi zaman tasarrufu sağlıyor.

Gizli bulut ortamında yapay zekâ modelleri kullanmak güvenli mi?

Evet, ABD’nin Gizli ve Çok Gizli bulutları özel güvenlik denetimlerinden geçiyor, donanım ve yazılım çok sıkı test ediliyor. Bu sayede verilerin dışarı sızması gibi riskler minimize ediliyor. Özellikle H200 GPU’ların kullanıldığı ortamlar ekstra güvenlik önlemleriyle destekleniyor.

H200 GPU’lar önceki modellerden teknik olarak ne farkla öne çıkıyor?

H200, 141 GB HBM3e bellek ve 4.8 TB/s bant genişliği ile H100’e göre %70’in üzerinde daha fazla kapasite ve hız sunuyor. Ayrıca her VM’de sekiz GPU ve 900 GB/s NVLink ağıyla çok daha yüksek performans elde ediliyor. Sahada gözlemlediğim en önemli farklardan biri de enerji verimliliğinin artması oldu.

Azure Gizli Bulut’da yapay zekâ uygulamaları geliştirmek için nelere dikkat etmek gerekiyor?

Öncelikle bulut ortamının güvenlik kurallarına tam uyum şart. Ayrıca, veri işleme ve model eğitimi sırasında network ve disk IO darboğazlarını en aza indirecek altyapı hazırlamak önemli. H200 GPU’lar bu noktada ciddi avantaj sağlıyor ama uygulama optimizasyonu da kritik.

H200 GPU’lar sağlık veya kamu sektöründeki uygulamalarda ne gibi farklar yaratıyor?

Örneğin sağlık sektöründe genom analizi gibi ağır hesaplama gerektiren işlemler eski nesil GPU’lara göre çok daha kısa sürede tamamlanıyor. Kamu projelerinde ise belge tarama ve özetleme gibi yapay zekâ uygulamaları hem hızlanıyor hem de güvenlik standartlarına uygun şekilde yapılabiliyor. Deneyimlediğim projelerde bu fark açıkça hissediliyor.

Kaynaklar ve İleri Okuma

Azure NDv5 VM Serisi ve H200 GPU Desteği

Azure Özel ve Gizli Bulutlar Tanıtımı

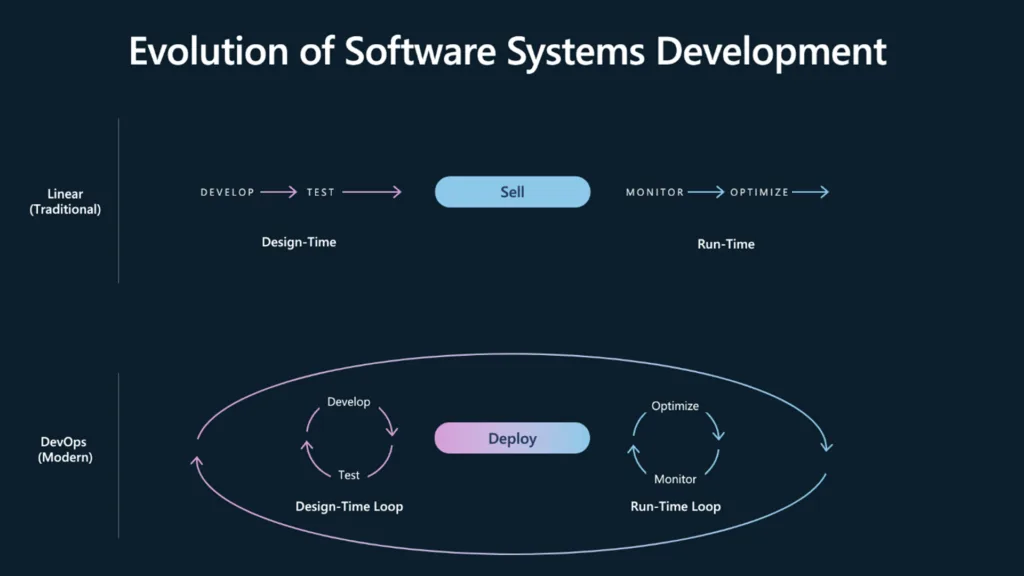

Microsoft Azure & Office 365 Çözüm Uzmanı | Logosoft Bilişim'de Azure Danışmanı. 20+ yıl BT deneyimi, 6+ Azure sertifikası (AZ-305, AZ-104, AZ-500, AZ-400). Kurumsal bulut göçleri, güvenlik mimarisi, FinOps ve DevOps dönüşümü konularında stratejik danışmanlık sunuyorum. Bu blogda Azure, yapay zeka, Kubernetes ve modern bulut teknolojileri hakkında güncel içerikler paylaşıyorum.

Yorum gönder